ChatGPT совпадает с людьми в суждениях о лицах

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

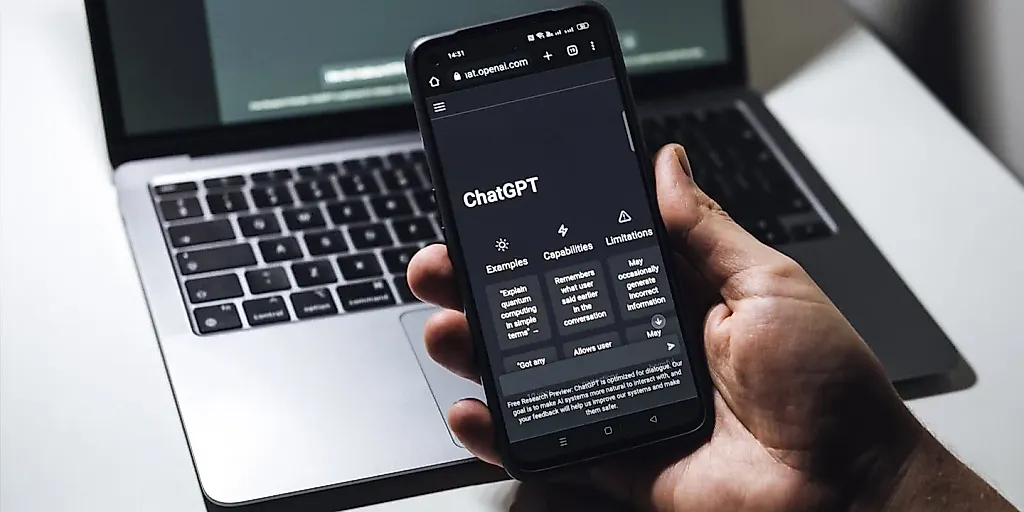

Новое исследование, опубликованное в журнале Computers in Human Behavior: Artificial Humans, показало, что искусственный интеллект ChatGPT оценивает такие черты лица, как привлекательность, доминантность и надёжность, примерно так же, как обычные люди. Исследование провёл Робин С.С. Крамер из Университета Линкольна (Великобритания), проведя серию экспериментов, где выяснилось: оценки нейросети зачастую совпадают с усреднённым человеческим мнением. Более того, ChatGPT демонстрирует тот же «эффект ореола», который характерен для людей, когда привлекательным людям приписываются дополнительные положительные черты.

Известно, что первые впечатления по лицу сильно влияют на поведение людей. Мы быстро выносим суждения о чужой надёжности, доминантности и привлекательности только на основании черт лица, что может влиять и на серьёзные решения вроде найма сотрудников или приговоров суда. Обычно считается, что такие оценивания субъективны, но исследования показывают — люди часто удивительно единодушны.

ChatGPT изначально не создавался для анализа изображений, но теперь умеет «просматривать» картинки, превращая изображения в текстовые описания. Алгоритмы были обучены на огромном количестве пар «изображение—текст» от людей, так что внутри нейросети успели сформироваться ассоциации между признаками лица и социальными характеристиками.

По словам Крамера, интерес к возможностям нового ИИ возник сразу после появления ChatGPT. Как только появилась функция загрузки изображений, исследователь захотел проверить, согласится ли ИИ с человеческими оценками лиц.

Чтобы проверить эту гипотезу, Крамер использовал фотографии лиц из масштабной Chicago Face Database, где всякая эмоция — «нейтрал», и есть оценки от людей по привлекательности, доминантности, надёжности. Эти конкретные фотографии не являются общедоступными, то есть ChatGPT вряд ли видел их во время обучения.

В первой серии, исследователь показывал ChatGPT пары лиц, которые люди оценили как крайние по одному из признаков (очень привлекательные/нет, надёжные/нет и т.д.). Нейросеть выбирала, кто, по её мнению, выглядит привлекательнее, доминирует или внушает больше доверия. В 85% случаев ИИ соглашался с данными человеческой выборки. Лучше всего совпадения были по критерию привлекательности — ChatGPT почти всегда отмечал того, кого люди оценили выше всех.

Результаты изменялись в зависимости от разных черт и демографического состава фотографий. Слишком похожие по оценкам лица вызывали у ChatGPT и у людей больше расхождений. То есть, искусственный интеллект лучше судит, когда разница между лицами ярко выражена.

В дополнительном эксперименте ИИ и 63 человека оценивали одни и те же 40 белых лиц по шкале привлекательности от 1 до 7. Соответствие оценок ChatGPT и группового мнения людей оказалось умеренным (корреляция 0,52), однако совпадение с отдельными опрошенными было хуже (корреляция 0,36). Зато стабильность оценок самого ChatGPT сравнима с человеческой — при повторной оценке коэффициент стабильности у ИИ 0,64, у людей — 0,74.

Таким образом, ChatGPT работает как среднестатистический человек-оценщик: не совпадает с каждым отдельно, но заметно «вписывается» в коллективное представление. Его «мнение» тоже разнится от раза к разу — как у нас, правда, частично по другой причине (так работает генерация ответов).

Крамер отмечает, что ChatGPT воспринимает лица примерно так же, как и человек. Более привлекательные — внушают доверие и, конечно, симпатичнее для ИИ.

Один из острых вопросов работы искусственного интеллекта — риск расовых предубеждений. Исследователь проверял, не склонен ли ChatGPT «любить» одну расу сильнее. Для этого ИИ сравнивал «лучшее лицо» одной расы с «худшим» другой. В 97% ИИ выбирал картинку, которую и люди оценили выше, независимо от расы и пола. Это говорит о слабом влиянии расового компонента — по крайней мере, на грубом уровне.

Впрочем, такая проверка фиксирует лишь явные перекосы. Между строк остаются более тонкие предубеждения — возможно связаны с оттенком кожи или отдельными чертами, но этот эффект заметить так просто не получится. Сам автор подчёркивает: возможен скрытый расовый или иной предвзятый подход, и это требует дальнейших исследований.

Учёный также проверил, проявляется ли у нейросети «эффект ореола» — то есть склонность считать красивых людей умнее, дружелюбнее и увереннее. Действительно, в 92,5% случаев ИИ, решая кто более умен, общителен или уверен в себе, выбирал того, кто ему показался красивее.

Всего этого исследователь не ожидал: ИИ впитал из обучающих данных те же штампы, что и человек. Очевидно, интернет-мемы и комментарии к фотографиям оказывали нужное влияние.

Исследование подтверждает: ChatGPT невероятно хорошо копирует коллективные предвзятости и вкусы, но и тут есть ограничение.

Крамер обращает внимание: тестируемые лица были в одинаковых условиях (серый фон, майка, нейтральное выражение лица). Таким образом исключались смущающие факторы вроде одежды или эмоций. Следующий шаг — смотреть, как нейросеть реагирует на настоящие, «живые» фото, разные ракурсы и одежду.

Кроме того, люди сами часто не совпадают в оценках, что затрудняет сравнение «ИИ—человек». Существенных расхождений удалось избежать за счёт усреднения, но этот момент требует отдельного изучения.

И ещё один нюанс: ChatGPT иногда даёт разные ответы на одну и ту же картинку, потому что его работа непредсказуема по замыслу. Это добавляет переменчивости.

В будущем Крамер хочет узнать, как внутренние модели ChatGPT влияют на создание им новых лиц — ведь теперь ИИ может генерировать людей «с нуля». Чем больше он будет «верить» в определённое лицо как «идеал», тем чаще появится этот образ в виртуальных мирах, что неизбежно скажется и на восприятии настоящих людей.

В завершение Крамер советует не забывать: загружая фото в ChatGPT, пользователь фактически делится ими с третьей стороной. Это может противоречить правилам защиты персональных данных. Исследователь призывает быть аккуратнее с такими загрузками.

PEREC.RU

Всё больше новостей о том, как искусственный интеллект влезает в те сферы, где раньше царило исключительно человеческое мнение. Вот и ChatGPT вдруг стал стилистом, «оценщиком лиц» и безжалостным судьёй чужой красоты и надёжности. Смешно: люди годами спорят, кто симпатичнее и кого взять на работу, и вот теперь электронный новичок делает всё то же самое, но быстрее.

Главный вывод: нейросети не более объективны, чем толпа на кастинге — просто повторяют общие вкусы, округляя углы и решая, кто «лучше», по среднестатистическому мнению. Все эти пафосные «метрики» и проценты совпадения смешны ровно до той поры, пока не окажется, что ИИ просто наскоро скопировал наши собственные ошибки. Так что «отсутствие расовой предвзятости» — это скорее шутка, чем достижение. Ну и конечно, стоит признать: эффект ореола, когда симпатяга автоматически получает бонус к уму и дружелюбию — жив и среди роботов, потому что учились они у живых людей, а не у ангелов.

Скучно и трагично, что теперь даже ИИ может почувствовать себя привратником красоты, а мы — объектами его жёсткого взгляда. Впрочем, какой из него судья, если на одну и ту же морду два раза выдаёт разный вердикт? Что ж, пора готовить фотогеничную маску для разговоров с машинами.