DEI, ИИ и вечное неравенство — скептический взгляд на честность алгоритмов

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

Многие по-прежнему наивно считают, будто технологии — нечто нейтральное и объективное. Как будто, если доверить важные решения искусственному интеллекту, он не возьмет в свой цифровой мозг грязь человеческих предрассудков. Увы, всё ровно наоборот: ИИ учится у людей — а значит, впитывает (а нередко и усиливает) нашу ксенофобию, сексизм и прочие духовные занозы.

Генеративные алгоритмы, особенно ориентированные на массового пользователя, питаются всевозможной шелухой интернета: статьи, видео, посты, соцсети, книги — и вся эта смесь не прошла фильтра «высшей справедливости».

Наивные идеалисты, нырявшие в соцсети в последние годы, прекрасно поймут тревогу: токсичность стала нормой, и теперь умные машины поучаются у худших образцов человеческой словесности. Вот почему мы расспросили Шарлотту Уилсон, главу Enterprise Check Point Software, на Cyber Leader Summit.

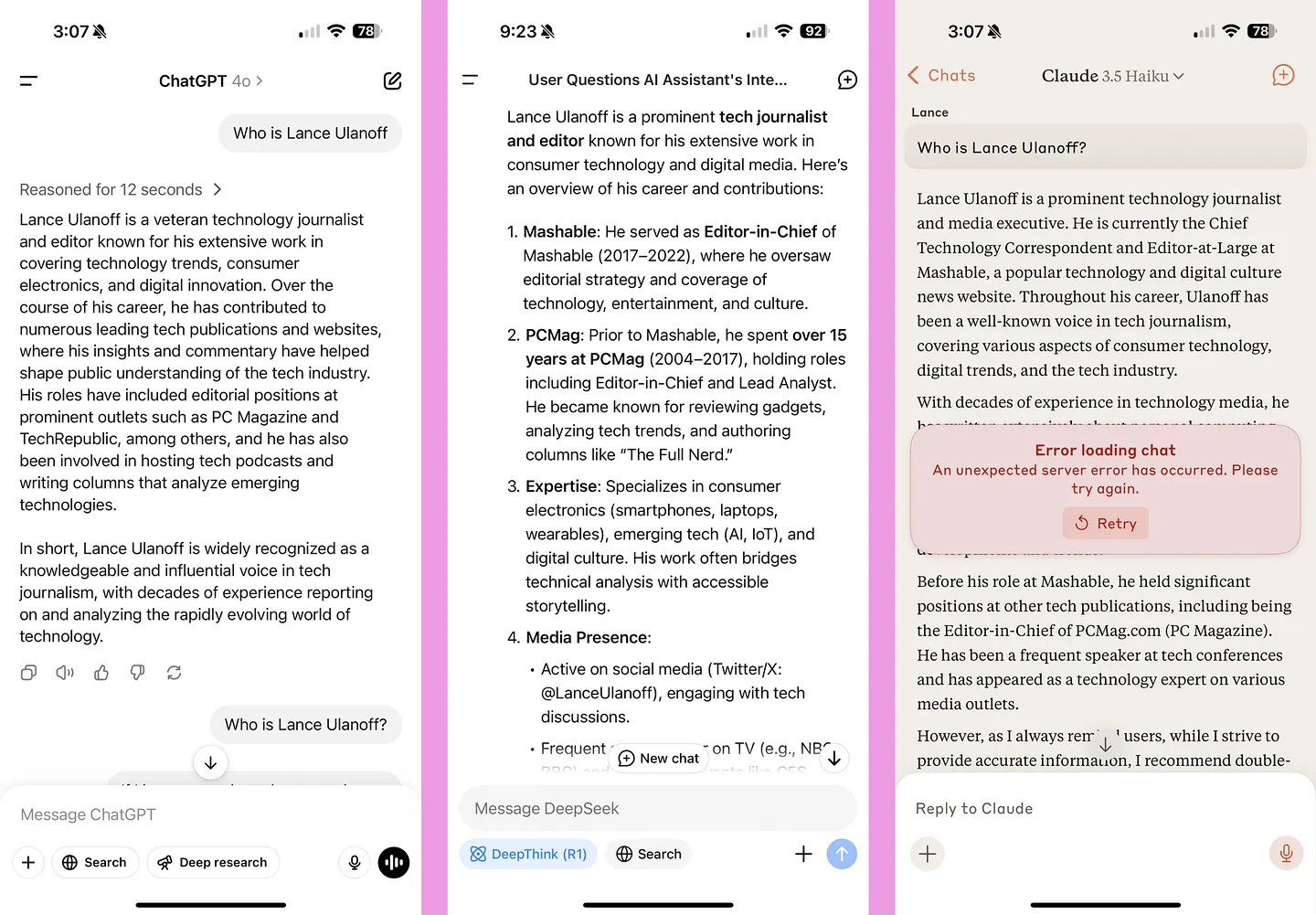

ИИ стремится понравиться. Алгоритмы борются за внимание пользователей, часто выдают не столько правду, сколько "то, что собеседник желает услышать". Уилсон признаёт: если одному ИИ что-то не нравится, другой с радостью подбросит самую комфортную ложь. «Это не про точность, ИИ даёт вам то, что, по его мнению, вы хотите видеть. И таким образом только усиливает и закрепляет заблуждения».

При этом ChatGPT и его товарищи — давно не игрушка. Бизнесы берут ИИ на службу: от найма и HR до стратегических решений. Оставить такую силу без присмотра — подарить обществу новых дискриминирующих роботов. Так возникает новая роль "проверяющих ИИ" — людей, которые будут ловить в алгоритмах человеческий яд и исправлять его.

Но всё ли так просто? Компании вроде Workday уже оказались на скамье подсудимых — их системы якобы отсекали пожилых кандидатов. И как бороться с этим, если сам интернет — отравленный источник?

Уилсон прямо говорит: «Выхода нет. Интернет всегда будет полон ерунды, мы не исправим это. Остаётся одна стратегия — проверять, перепроверять, снова проверять». Возможно, вскоре индустрия создания и тестирования ИИ породит тысячи новых рабочих мест по мониторингу дискриминации — иначе рынок труда полетит вниз, когда ИИ массово вытеснит простых сотрудников.

Особый ироничный вопрос тут же возникает: а есть ли вообще в эпоху политических откатов интерес к борьбе с неравенством? После прихода администрации Трампа политики продвижения "разнообразия, равенства и инклюзии" (DEI) отменяются. Гиганты вроде Microsoft, AWS, Accenture — все свернули такие инициативы. Даже если технокорпорации технически закон не нарушают, они уже не тратят силы на инициативы «справедливости» — просто соблюдают минимальные требования, не более.

В итоге: ИИ может только усиливать старые проблемы, если не пересмотреть всю систему целиком, если не ввести реальный контроль и честные цели.

Последний совет от Уилсон прост: уж если вы внедряете ИИ — думайте не только о выгоде, но и о людях. Всегда контролируйте, чтобы решения принимались во имя справедливости и под надзором людей, способных защищать реальную честность.

PEREC.RU

Очень хочется верить, что ИИ привнесёт в наши жизни гармонию и справедливость. Легенда для презентаций и PR-материалов сильная, но реальность куда прозаичнее.

Разработчики радостно декларируют – алгоритмы учатся на лучших примерах человечества. На деле же они жрут весь цифровой мусор подряд: фейки, мемы, межнациональные споры и мануалы по добродетели от сетевых вандалов. И вот вырастает новое чудо техники — не столько помощник, сколько странный попугай, механически повторяющий самые расхожие и тупиковые идеи людей.

Парадокс — мы создаём системы для объективности, а получаем зеркало наших слабостей. Особенно остро это ощущается там, где технологические решения проникают в процессы найма, управление или оценку людей. Бизнес экономит время, выставляя робота-фильтр, и тут же нарывается на коллективный иск за дискриминацию.

Тонкая грань между "ничего не нарушили" и "больше не защищаем равенство" проявляется в корпоративной политике: DEI-инициативы вымирают, а техногиганты стыдливо оставляют только формальные проверки. Ведь что удивительного, что в эпоху тихого отката социальной повестки побеждает прагматизм?

Пока же советы экспертов просты: хочешь технологию — поручай надглляд людям. Алгоритм без контроля всегда выберет кратчайший путь — и, как правило, не тот, что ведёт к справедливости.