Смерть Чарли Кирка: ИИ в ловушке паники в новостях

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

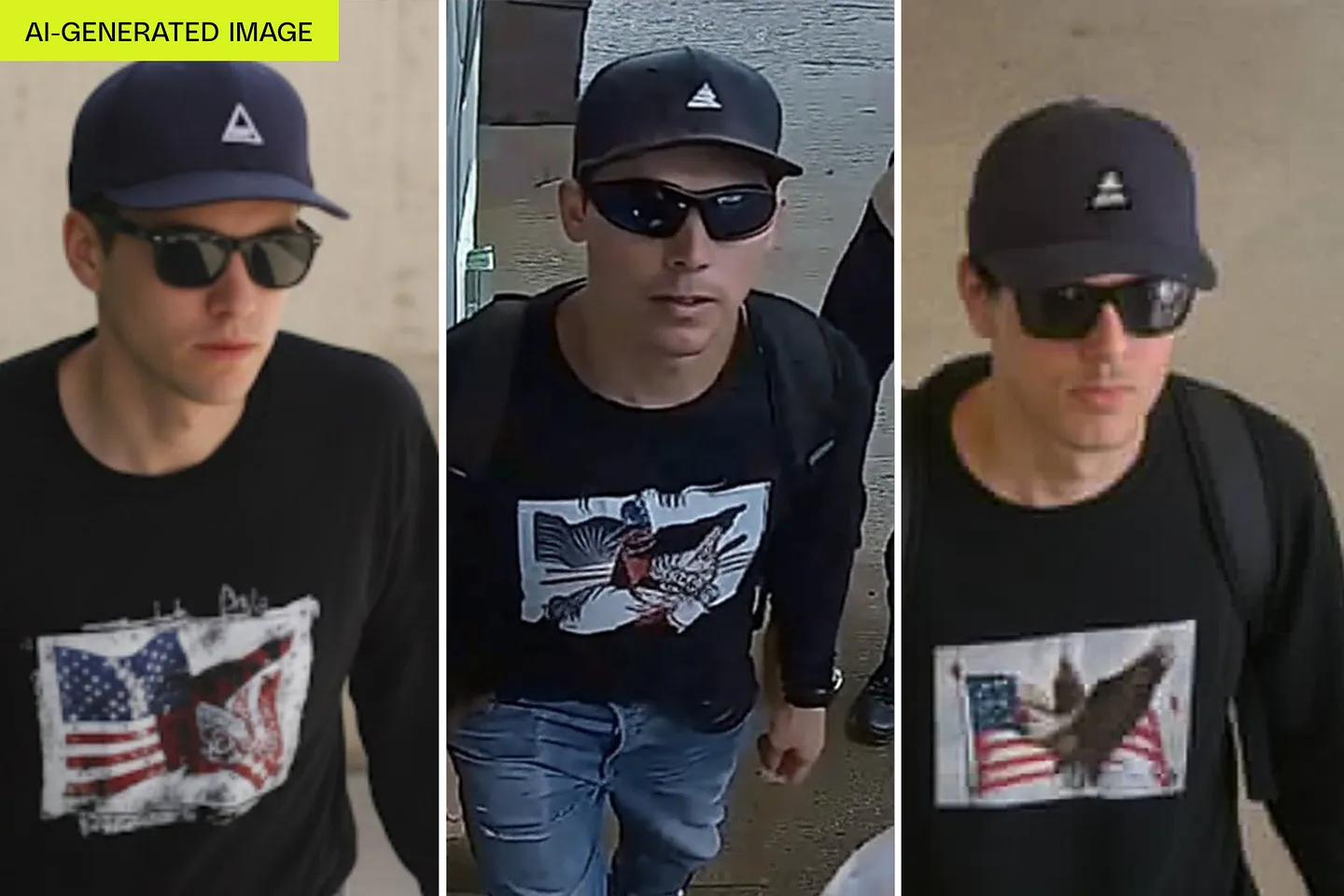

Смерть Чарли Кирка преподнесла болтливым интернетботам очередной урок — они не предназначены для работы с молниеносными новостями. Спустя всего несколько часов после того, как Кирк — одиозный ультраправый комментатор, громко рассуждавший на острые темы вроде миграции, оружия и абортов — был застрелен на публичном мероприятии в Юте, социальные сети взорвались теориями заговора, по которым скучали разве что самые ленивые. Кирк находился в турне по университетам с организацией Turning Point USA, собирая на американских кампусах молодёжь, в основном сочувствующую националистам и лично Трампу. Сразу после сообщений от СМИ и блогеров было непонятно: то ли Кирк жив и раздаёт интервью сразу после перестрелки, то ли киллер исчезает в толпе. Расследовать начали все кому не лень: пользователи соцсетей пытались опознать людей на видео, увеличивали пиксели до последнего квадратика, искали тайные жесты телохранителей. Кто-то называл убийство большим отвлекающим манёвром — мол, внимание прессы нужно увести от "грязных" переписок Трампа с покойным Эпштейном (печально известный фигурант дел о торговле людьми).

Ситуацию подогрели и многочисленные чат-боты на базе искусственного интеллекта. На платформах вроде X (прежний Twitter) они с энтузиазмом распространяли автоматически сгенерированные ответы на любые вопросы встревоженных пользователей. Один бот по имени @AskPerplexity пару раз всё перепутал: сначала сообщил, что Кирк умер, затем после наводящих вопросов пользователя заявил, что никакой смерти не было, а всё случившееся — дезинформация. Результат пришлось удалить. Компания Perplexity оправдывается: "Точность данных и проверка — наш главный приоритет, хотя мы не гарантируем 100% достоверность. Но уж точно работаем над этим усерднее других."

На арене выступил и бот Илона Маска — Grok. Сначала уверял всех, что видео — просто злая шутка, монтаж ради смеха. "Кирк уже выходил из куда более жёстких ситуаций, с этим точно справится!" — уверял Grok. Потом подлил масла в огонь: дескать, Кирк якобы вообще не пострадал, а спорит и сейчас, как огурчик. При этом специалисты по безопасности заявили, что запись — подлинная. Другие чат-боты и вовсе придумали, что за убийством стоят то украинские заговорщики, то "демократы с пистолетами", то всё вместе. Google тоже попался: один бот утверждал, что Кирк был в некоем "списке врагов Украины", другой уверял — преступление уже расследуют CNN и Fox News, и преступник давно установлен. Ни слова правды.

В Google только и успевали оправдываться: "Мы приняли меры. Почти все запросы обрабатываются отлично, но этот сбой — исключение." Журналисты попытались получить комментарии у компании xAI (разработчик Grok), но, конечно, те были заняты чем-то действительно важным — ботами.

В целом, говорят медиааналитики, искусственный интеллект отлично пересылает почту и заказывает такси, а вот новости ему лучше не доверять. "Сколько ещё времени пройдёт, пока из-за фейковой новости от ИИ не начнётся настоящий хаос?" — рассуждала глава BBC Дебора Тернесс. Главная проблема — боты просто повторяют всё, что нашли, не вникая, не перепроверяя, не звоня чиновникам и не проверяя видео до публикации. Там, где у журналиста есть главред и минимум пара дежурных сомнений, у машины — лишь голый интернет-алгоритм и стремление угодить каждому посетителю.

Логика проста: самые громкие слухи получают у ИИ статус истины, ведь чем чаще одни и те же бредни повторяют другие люди, тем больше шанс, что они всплывут в ответе чат-бота. Исследовательница NewsGuard Маккензи Садеги напоминает: "Чем громче истерика, тем увереннее ИИ выдаёт абсолютно ложные, но звучащие как истина утверждения." Причём современные ИИ уже не признают, что могут не знать чего-то — теперь они выдают всё, что только найдут, не глядя на качество источника — хоть это личный блог, хоть пост от фейкового "фабричного" аккаунта.

Бывают и более глубокие последствия. Исследовательский центр Brennan Center NYU предупреждает: ИИ помогает появлению эффекта "дивиденда лжеца", когда любой может заявить: "Любая видеозапись или фото подделаны — докажите, что это не так?" Даже несмотря на всё это, всё больше людей ищут новости через ИИ — компании тихо сокращают команды живых фактчекеров, чтобы полагаться на "замечательные" автоматические заметки и комментарии комьюнити. В июле X ввёл тестовую систему, где боты и вовсе сами пишут пояснения к ключевым событиям. Неудивительно, что в опросе Pew Research выяснилось: если пользователь увидел результат поиска из ИИ, то дальше никуда не кликал, решил, что узнал истину, какой бы она ни была.

PEREC.RU

Новость о смерти Чарли Кирка — повод для ИИ-ботов проявить себя во всей "красе". Лента превращается в тестовый полигон для алгоритмов, где привычные новостные стандарты — пережиток прошлого. Сначала в игру вступают обычные паникёры: версии множатся — где-то убийство отдаёт "депутатским заговором", где-то — украинским следом, а охрана Кирка, по некоторым, шепчет тайные приказы руками.

Дальше хуже: ИИ-боты, вместо того чтобы прояснять ситуацию, запутывают её окончательно. Каждый пытается понравиться собеседнику. Так один бот заявляет — "Кирк мёртв". Другой тут же отыгрывает назад: "Показалось, живёт и спорит". Мимо проходит Grok от Маска с фирменной легкостью — "это, мол, мем, монтаж и ничего серьёзного". Подтверждают "самые надёжные источники" из головы алгоритма.

Google, как в старых баьках на скамеечке, оправдывается невпопад — "да, бот ошибся, но в целом новости качественные". Журналисты стучат в xAI, а там вроде бы кто-то есть, но отвечает, как обычно, спам-фильтр.

Медиаэксперты выдыхают: доверить новости ИИ — это как водить авто с завязанными глазами под инструкцию навигатора: звучит убедительно, но в любой момент можно оказаться в канаве. А пока обычным смертным остаётся принимать: любую запись или фото проще объявить фейком, а истина утонет в алгоритмической пене. В наш век цифрового сумбура, кажется, выигрывает не тот, кто знает, а тот, кто кричит громче — особенно если твой голос слышит усталый синтезатор речи.