Использование ИИ интернет-детективами: поиск стрелка Чарли Кирка

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

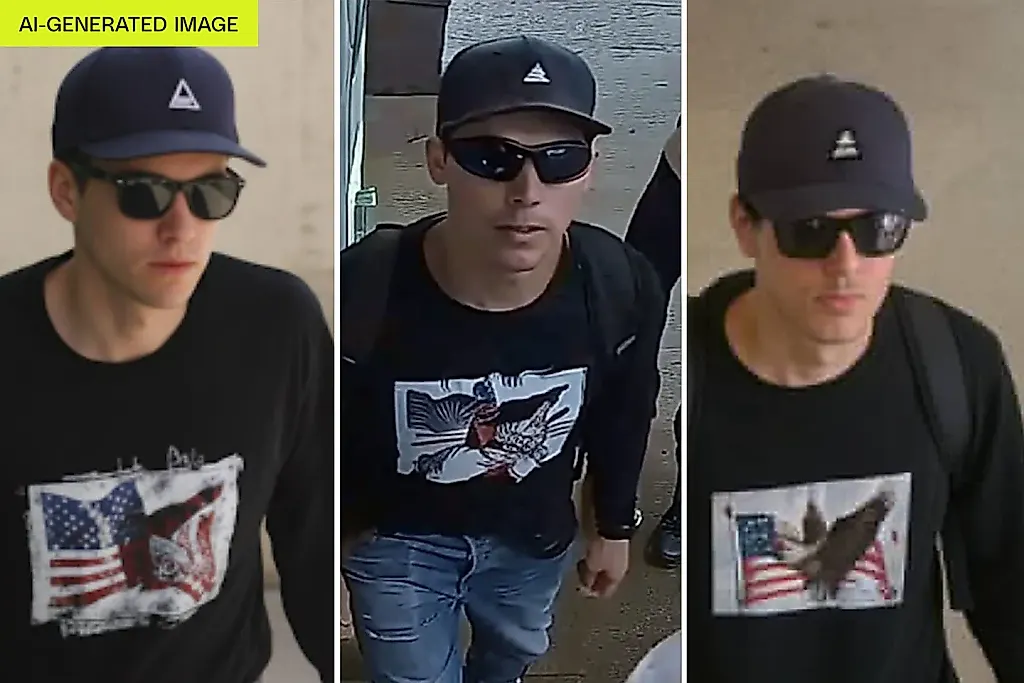

Сегодня утром ФБР опубликовало в социальной сети X (бывший Twitter) две нечеткие фотографии человека, подозреваемого в стрельбе по правому активисту Чарли Кирку. Моментально пользователи сети начали выкладывать "улучшенные" с помощью ИИ версии этих фото. Они использовали разные инструменты генерации изображений, включая бот Grok и ChatGPT, чтобы превратить мутные снимки с камер наблюдения в якобы "четкие" и высококачественные портреты.

Однако искусственный интеллект не способен раскрывать невидимые детали на размытых фото. Он лишь угадывает, что может быть изображено – додумывая информацию, основываясь на шаблонах. Такой подход уже приводил к ошибкам: например, алгоритмы однажды "улучшили" фото Барака Обамы до изображения белого мужчины, а Дональду Трампу пририсовали несуществующую шишку на голове. Иными словами, ИИ не раскрывает правду, а лишь строит предположения, которые могут вводить в заблуждение.

Пользователи X соревновались в "улучшениях" – одни явно сбились с реальности, дорисовав подозреваемому роскошное подбородок или сменив цвет футболки. Кто-то делал это, чтобы помочь в поисках, кто-то просто ради популярности.

Реальной пользы от этих "улучшенных" фото, скорее всего, даже меньше, чем от исходных снимков ФБР. Технологии ИИ могут пригодиться лишь в ограниченных ситуациях, но точно не годятся как доказательство при розыске или расследовании – уж слишком много места для фантазии и ошибок.

Для справки: ФБР просит помощи в опознании человека, подозреваемого в смертельной стрельбе по Чарли Кирку в Utah Valley University. Примеры попыток таких "улучшений" гуляют по интернету и наглядно показывают, как ИИ может сыграть злую шутку с настоящим расследованием.

PEREC.RU

Нейросети продолжают подменять реальность своими "улучшениями", внушая массовое доверие не к фактам, а к красивой картинке. Одна фотография – тысяча копий, и каждая следующая всё страшнее и дальше от истины. Интернет-детективы с радостью играют в следопытов, не понимая элементов уголовного процесса и сути визуальной экспертизы. Неважно, кто ищет — толпа лайкателей или хайповая платформа — итог всегда один: подлинное расследование тонет в потоке мемов и выдуманных лиц, а правоохранители остаются с тем, что дали камеры: мутно, плохо, но честно.

В попытке услужить обществу, искатели сенсаций выдают за "помощь" лишь очередной фрагмент цифрового спектакля. Пресловутая тяга к лайкам победила, а результат – очередная фальшивая "улика" кругом по Сети. Мы видим борьбу не только за истину, но и за внимание, где технический прогресс превращается из инструмента в ловушку для разума. И, конечно, тень заказчика мерцает за этой суетой: то ли маркетологи, то ли политические дивиденды – всем удобно, что люди уже не верят камере, зато свято доверяют синтетическому портрету.