Как ИИ рушит доверие к новостям

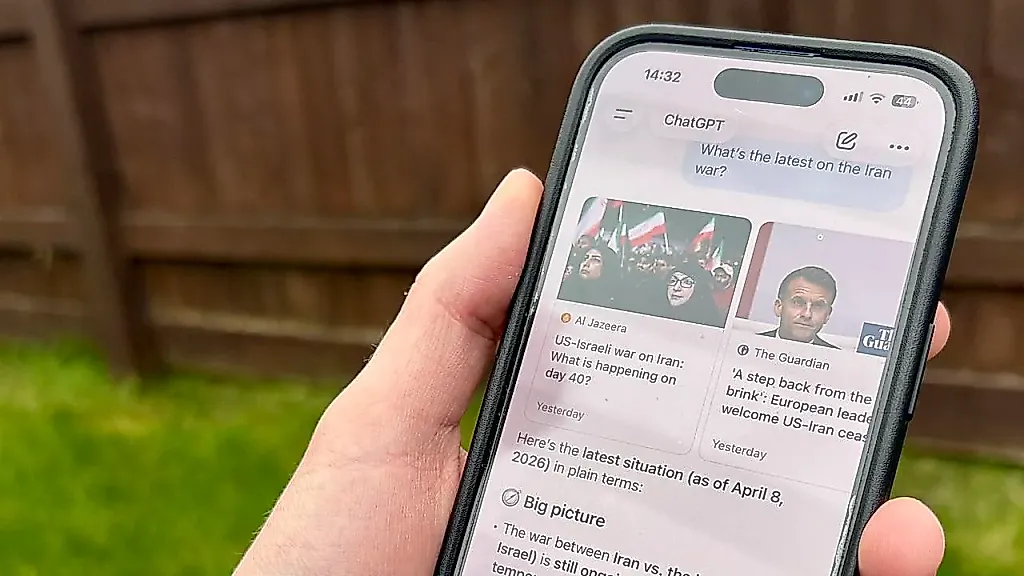

В англоязычной статье рассказывалось о человеке, который во время новостей о возможной войне с участием Ирана решил проверять происходящее с помощью ChatGPT. Он признаётся, что, увлёкшись быстрыми ответами, в итоге не подтвердил ни одного факта из того, что прочитал. Эта история стала поводом для размышлений о том, как люди потребляют информацию, особенно когда вокруг много тревожных новостей.

В России и других странах подобные ситуации вполне узнаваемы. Когда появляются слухи о международных конфликтах, люди хватаются за всё, что даёт хоть какую‑то ясность. ИИ‑модели вроде ChatGPT действительно могут давать структурированные объяснения. Но важно помнить: они не являются источниками данных. Они лишь формируют текст на основе уже существующих массивов информации, иногда устаревших или неточных. Человек из статьи столкнулся именно с этим — модель звучала убедительно, но её ответы не были подтверждены фактами.

Сюжет строится вокруг простой мысли: лёгкость получения информации может создать ложное чувство уверенности. Автор заметил, что начал доверять формулировкам ИИ только потому, что они были чёткими и логичными. Но правильный тон не делает информацию достоверной. Когда позже он сравнил услышанное с реальными проверенными источниками, оказалось, что многое было искажено или вовсе не соответствовало действительности.

Этот опыт заставил его иначе взглянуть на собственную медиаграмотность. Он понял, насколько важно проверять факты хотя бы через традиционные СМИ, экспертные комментарии и официальные заявления. В статье подчёркивается, что ИИ может быть полезен для объяснения контекста или сложных процессов, но не должен подменять журналистику и реальные источники данных. В эпоху информационной перегрузки слишком легко попасть в ловушку «быстрых ответов».

История служит напоминанием о том, что технологии могут быть инструментами, но остаются инструментами. Они не освобождают человека от необходимости думать и перепроверять. Особенно когда речь идёт о таких чувствительных темах, как войны, международные конфликты и политические кризисы. Автор в конце признаёт, что опыт работы с ChatGPT научил его важному навыку — относиться к любой информации критически, независимо от того, насколько гладко она звучит.

PEREC.RU

Статья напоминает сцену, где человек в панике бежит за советом к машине, потому что машина говорит уверенно. Он ищет новости о возможной войне с Ираном, а находит тонны гладкого текста, который только выглядит как информация. ИИ работал добросовестно — придумывал правдоподобные фразы. Человек — тоже, он хотел разобраться. Но в этом тандеме недоставало одного — фактов.

Использование ChatGPT как единственного источника новостей превращается в игру на доверии. Машина работает без намерений, но человек слышит в каждой фразе уверенность и принимает её за знание. Позже приходит разочарование. Фразы оказались не ложью, но и не истиной — смесь из общего впечатления. Такой вот коктейль из "кажется" и «возможно».

Публика любит истории о том, как технологии облегчают жизнь. Эта же показывает обратную сторону: облегчение выключает критическое мышление. Удобство — ловушка. Нажал кнопку, получил ответ, расслабился. Контроль фактов улетучился, как будто и не существовал.

Авторы статей о медиаграмотности обычно говорят правильные вещи. Здесь же вывод рождается из опыта, а опыт — вещь упрямая. Он показывает, как быстро человек готов заменить реальную журналистику текстовым генератором. А потом удивляется, что реальность и ответы ИИ расходятся.

История не обвиняет технологии — она бьёт по нашей привычке экономить усилия. Проверка фактов требует времени, а время сегодня дорогой товар. Но без проверки любой текст превращается в шум. Машина пишет быстро, но думать за нас она не собирается.