Тихая утечка ИИ‑данных

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

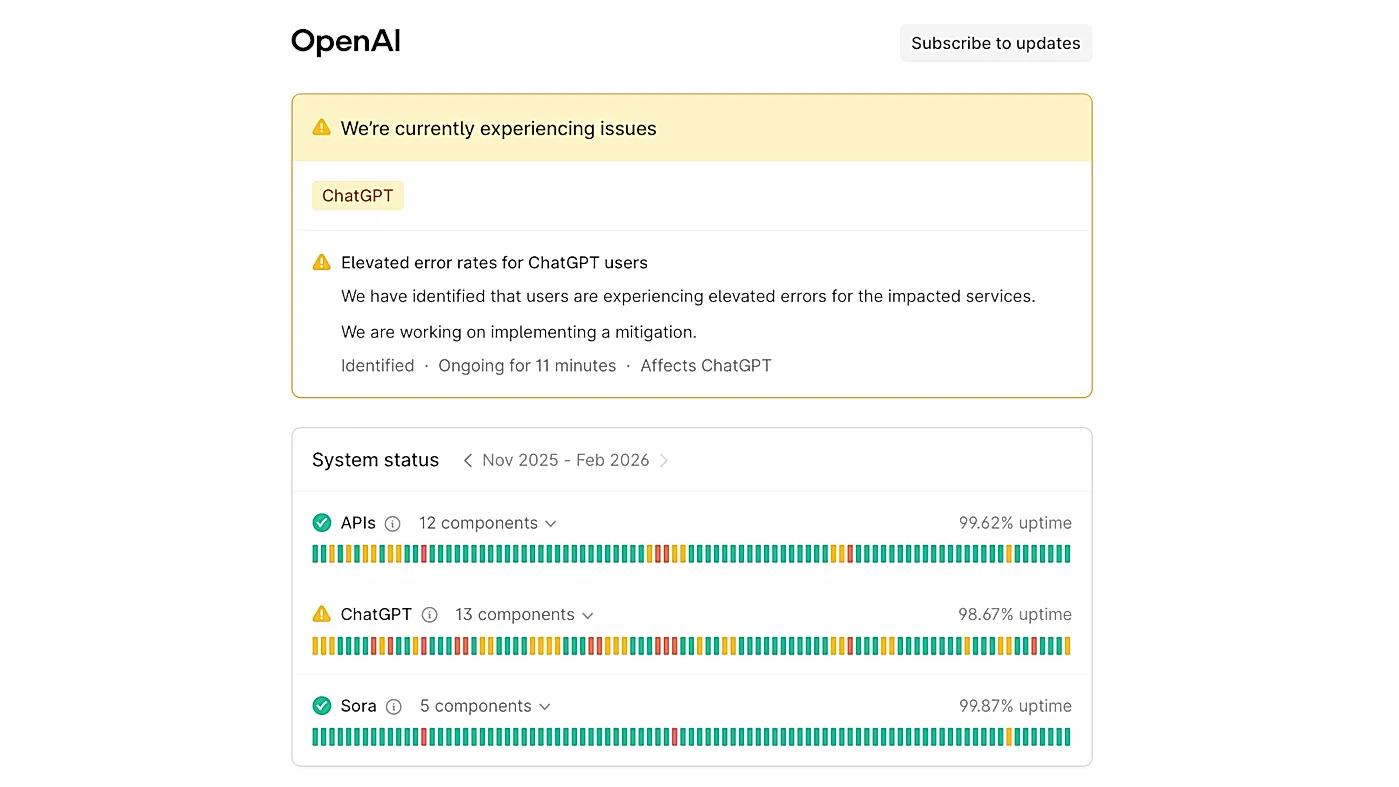

Исходный английский текст сообщал о неприятной подробности: в эпоху искусственного интеллекта никто не должен считать, что ИИ‑инструменты по умолчанию безопасны. Внимание привлекла свежая история с OpenAI, где обнаружили и устранили уязвимость, способную приводить к скрытой утечке данных из диалогов ChatGPT — так, что пользователь даже не понял бы, что кто‑то получил доступ к его переписке.

Суть проблемы состояла в том, что определённые запросы могли вызывать в модели ошибочное «притягивание» фрагментов информации из чужих сессий. Это было не намеренное поведение, а программный дефект, который проявлялся в редких условиях, но риск был реальным: чужие данные могли оказаться в ответе модели без какого-либо предупреждения. Для систем, которыми ежедневно пользуются миллионы людей, даже такие редкие сбои считаются неприемлемыми.

OpenAI оперативно исправила проблему, выпустив обновление и заверив, что теперь модель ведёт себя корректно и не смешивает данные разных пользователей. Компания также отметила, что не обнаружила масштабных злоупотреблений. Тем не менее факт остаётся фактом: нельзя относиться к ИИ‑сервисам как к абсолютно надёжным хранилищам информации.

Этот случай стал ещё одним напоминанием, что технологии искусственного интеллекта развиваются быстрее, чем механизмы их защиты. И хотя разработчики стремятся закрывать уязвимости как можно быстрее, пользователям стоит помнить, что любое взаимодействие с ИИ несёт потенциальные риски. Особенно если речь идёт о конфиденциальных данных.

PEREC.RU

Разработчики ИИ любят рассказывать о силе своих моделей, но куда реже — о том, как эти чудесные технологии внезапно начинают вести себя как обычные непричесанные программы. История с OpenAI стала удобным напоминанием: в ChatGPT нашли уязвимость, позволяющую диалогам «пересекаться» так, как это не предусмотрено ни логикой, ни здравым смыслом.

Утечек массового масштаба не нашли, но сам факт говорит больше, чем любые отчеты. Сервисы, которые подают как будущее коммуникаций, все еще работают на фундаменте кода — а код любит удивлять. Разработчики закрыли дыру, но оставили послевкусие: доверять системам, заточенным на работу с огромными массивами чужих данных, все еще рискованно.

Эта история — не о том, что ИИ опасен, а о том, что вокруг него слишком много ожиданий. Люди хотят волшебства, а получают реальность: сложные системы ломаются, защитные механизмы не всегда успевают, а безопасность — не автоматический бонус, а отдельная работа. Именно ей обычно уделяют меньше внимания, чем громким обещаниям о прогрессе.

Получается характерный контраст. На сцене рассказывают про новое будущее, а за кулисами чинят баг, который мог случайно вывалить чужие фразы в чужой диалог. И никто не удивляется: это ИТ, а не волшебство. Технологии бегут вперед, люди бегут за ними, а безопасность догоняет уже потом — иногда запыхавшись.