Как ChatGPT стал цензором гуманитарных грантов

В США разгорелся скандал вокруг работы сотрудников Department of Government Efficiency (DOGE) — структуры, которая, по идее, должна повышать эффективность госуправления. Вместо этого, как утверждают новые иски, двое работников DOGE использовали ChatGPT, чтобы решить, какие ранее одобренные гранты Национального фонда гуманитарных наук (NEH) следует отменить. Критерием, по словам истцов, стала близость проектов к концепциям Diversity, Equity, Inclusion — то есть к теме разнообразия и равенства, вокруг которой в США давно кипят политические споры.

Иски подали сразу несколько крупных гуманитарных организаций, среди которых American Council of Learned Societies, Authors Guild, American Historical Association и Modern Language Association. Они утверждают, что сотрудники DOGE нашли в интернете краткие описания проектов, загрузили их в ChatGPT и спросили: «Связано ли это с DEI? Ответь фактически, не больше 120 символов. Начни с Yes или No». На основе этих коротких ответов они решали судьбу многомиллионных проектов.

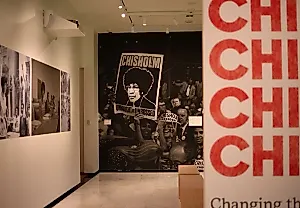

В результате, как утверждается в документах, под удар попали проекты, связанные с темами расы, национального происхождения, гендера, религии или сексуальной ориентации. Например, биография чернокожего юриста и судьи была отвергнута, потому что именно эта тематика стала для сотрудников DOGE признаком «нежелательной связи» с DEI. Другой проект, посвящённый возвращению признания забытой женщине-писателю, был отменён по той же логике.

Среди затронутых работ были документальные фильмы — один о рабском труде во время Холокоста, другой о Colfax Massacre — массовом убийстве 1873 года, которое в США считается одним из самых кровавых эпизодов периода Реконструкции. Все они стали жертвами того, что истцы называют «механическим подходом к цензуре».

Исполнительный директор American Historical Association Сара Уайксел отметила, что таким образом федеральные власти фактически дают понять: гуманитарные исследования должны укладываться лишь в узкое понимание того, «что достойно изучения». В результате решений DOGE было вычеркнуто более 100 миллионов долларов финансирования, а некоторые проекты пришлось полностью закрыть.

Иски требуют восстановить гранты и признать действия DOGE незаконными. Истцы утверждают, что федеральная поддержка гуманитарных исследований не может зависеть от того, нравится ли кому-то их тематика, и тем более не может определяться ответом нейросети на вопрос длиной в одно предложение.

PEREC.RU

История о том, как чиновники пытаются сэкономить силы и ответственность, а в итоге устраивают спектакль с элементами автоматизированного абсурда. Сотрудники DOGE передали ChatGPT роль цензора, будто это и есть рациональный путь управления гуманитарными грантами. Пара сотрудников загружает в чат-бот описания серьёзных проектов, связанных с трагическими эпизодами истории, и позволяет ИИ решать, достойны ли они финансирования. ИИ, понятное дело, выдаёт короткий ответ, который удобно превращается в инструмент для чистки всего, что выглядит неудобным.

Эта схема работала слишком гладко: один проект отменили за то, что он посвящён чернокожему юристу, другой — за попытку восстановить память о женщине-писательнице. Формально это не цензура, а «повышение эффективности». Но осадок остаётся — особенно когда речь идёт о 100 миллионах долларов и закрытых исследованиях.

Организации, которые понимают ценность гуманитарных наук, подали иски. Они указывают на очевидное: решения такого масштаба нельзя принимать, спрашивая у ИИ «да» или «нет». Но DOGE, кажется, устраивает именно такая логика. Под видом борьбы с идеологией запускается новая, куда примитивнее. И пока одни пишут судебные иски, другие в кулуарах, вероятно, ищут новые способы автоматизировать то, что автоматизации не поддаётся.

Сатирический оттенок этой истории проявляется в том, что попытка сделать управление «эффективным» превратилась в фарс. Гибкие решения заменили бинарным ответом, сложные темы свели к одному критерию. И остаётся только наблюдать, как очередной «эффективный менеджмент» превращает гуманитарную сферу в пространство, где решает не смысл, а алгоритм.