Война фейков

В сети еще не улеглась пыль после ударов США и Израиля по Ирану, где была разрушена школа Shajareh Tayyebeh и погибли до 168 человек, как интернет уже начал бурлить новой волной фейков. Пользователи выкладывали ролики из авиасимуляторов, выдавая их за реальные военные операции, подсовывали старые кадры ракетных атак и фотографии кораблей вне контекста — всё ради создания истории о якобы грандиозном иранском ответе. Множились видео, обработанные нейросетями.

По словам экспертов, такие публикации быстро собрали сотни миллионов просмотров всего за несколько дней. Масштаб проблемы заставил соцсеть X обновить правила: теперь тех, кто публикует AI-контент про вооружённые конфликты без пометки, будут исключать из программы выплат авторам.

Даже поисковые запросы уже не гарантируют правду. Вирусную дезинформацию выпускает армия ботов и «фермеров вовлечённости», которые стремятся выдать себя за самые заметные аккаунты. Одни хотят влиять на политику, другие — просто заработать. А пользователи, привыкшие к мгновенным новостям и подверженные эффекту подтверждения, снова и снова попадаются.

Свежие фейки касаются в основном преувеличений успехов иранских ответных ударов. Расследование Wired собрало сотни вводящих в заблуждение постов на X: кадры, изменённые AI, фальшивые утверждения о масштабе атак, старые видео, выдаваемые за новые. Один пост с 4 миллионами просмотров показывал «ракеты над Дубаем», но это было видео удара по Тель-Авиву в 2024 году. Другой — с 375 тысячами просмотров — демонстрировал «разрушенное убежище» Али Хоссейни Хаменеи, хотя изображение было полностью фиктивным.

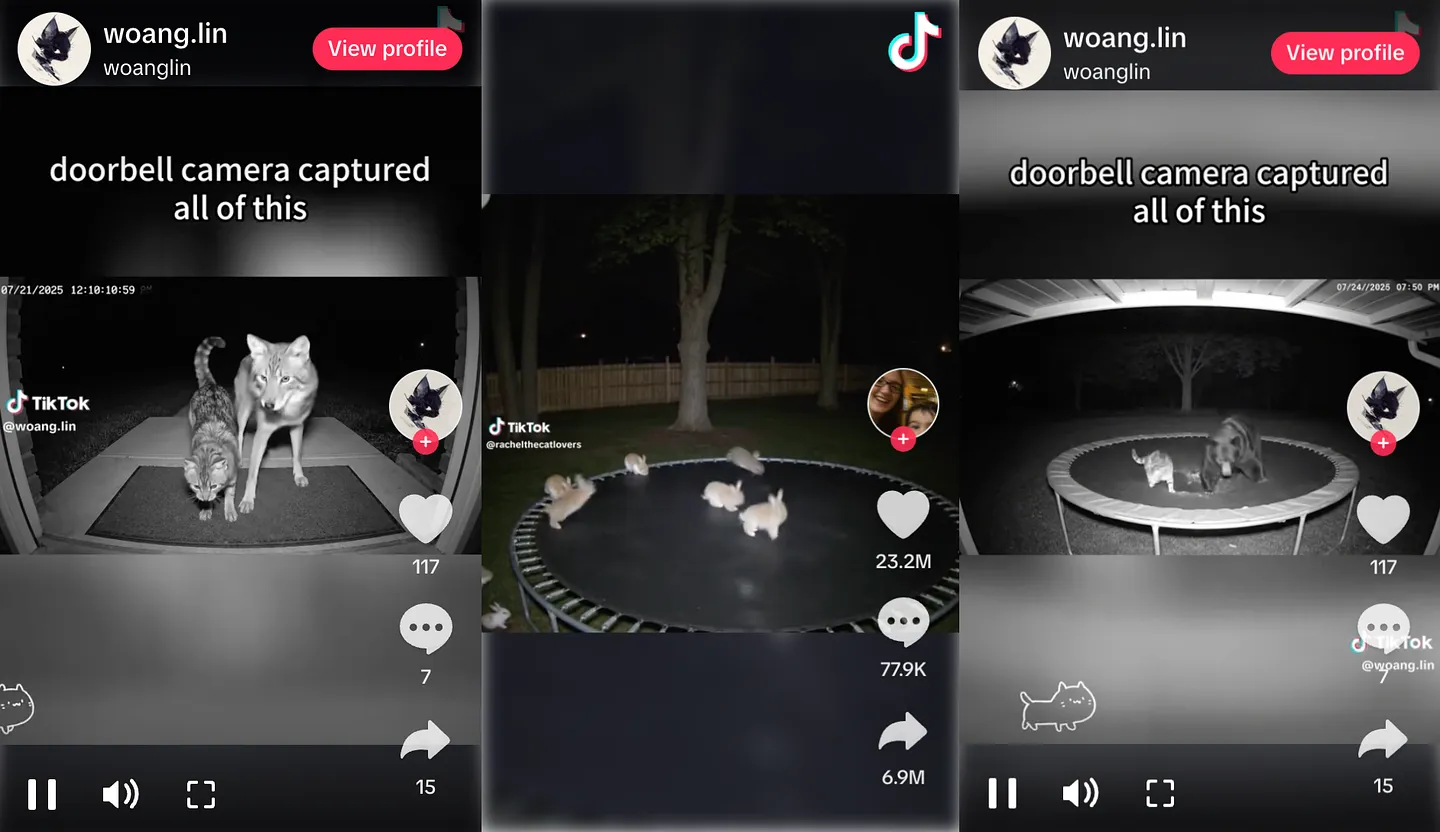

Многие из таких постов публиковали премиальные аккаунты с «синими галочками», в том числе иранские госмедиа. Как и в прошлых конфликтах, пользователи пытались выдать кадры из игр за реальные — например, «падение» F-35, взятое из авиасимуляторов. Частью этого контента делились в TikTok, а часть — аккаунты, связанные с российскими влиянием, отмечало BBC.

BBC также нашло полностью сгенерированные AI-видео, собравшие почти 100 миллионов просмотров. NewsGuard сообщил о пользователях, которые распространяют фейки о «точечных ударах» США и Израиля, используя старые или вырванные из контекста кадры разрухи.

София Рубинсон из NewsGuard отмечает, что дезинформация распространяется по цепочке: анонимные аккаунты публикуют фальшивки, а крупные страницы подхватывают их. Так произошло с фото «тонущего авианосца USS Abraham Lincoln». На деле это был архивный кадр намеренного затопления USS Oriskany 20-летней давности. Фейк распространили и «новостные» страницы, и кенийский депутат Питер Саласья — его пост набрал свыше 6 миллионов просмотров.

Другой популярный фейк — видео «атаки на ядерную станцию Димона». На деле это footage из Украины 2017 года. Подобные посты собрали как минимум 21,9 миллиона просмотров.

Фейки касаются и угроз «спящих ячеек» в США — по соцсетям гуляет некая «утечка» списка городов, созданная в обычном заметочнике телефона.

Эксперты предупреждают: сочетание массового распространения генеративного AI и расслабленной модерации соцсетей делает кризис дезинформации тяжёлым и опасным. Особенно это проявилось в последние месяцы. Люди больше не готовы ждать подтверждённых кадров и хватаются за любой «визуал», попадающийся первым.

Этот вакуум между реальными событиями и официальными материалами становится идеальной средой для фейков. Он усиливает конспирологию и убеждает пользователей, что «официальные СМИ что-то скрывают». Военные конфликты особенно уязвимы: люди, находящиеся далеко, легче верят эмоциональным или ложным кадрам.

Соцсети превратились для многих в единственный источник новостей, а инструменты проверки фактов, включая Google, стали менее надёжными. Пользователи даже спрашивают ИИ-чатботы — например, Grok — но те часто ошибаются. BBC обнаружило, что Grok подтвердил несколько поддельных AI-кадров об «иранских операциях».

Отчёт NewsGuard показал, что даже Google Search Summaries могут выдавать ложные описания: например, при поиске по кадру «атаки на ЦРУ в Дубае» Google подтвердил историю, хотя видео было пожаром в Шардже 2015 года.

Эксперты по безопасности предупреждают: такие «угрозы AI-информации» несут риски для общества, национальной безопасности и демократии.

Тем временем журналисты и граждане в Иране пытаются бороться с почти полным отключением интернета. И хотя властям удалось частично заблокировать связь, злоумышленники всё равно проникают в сеть и продолжают распространять фейки.

PEREC.RU

Цепочка фейков вокруг конфликта США и Ирана разворачивается предсказуемо. Сначала появляются удары, затем тишина — и сразу же её заполняют те, кто давно ждал своего часа. Они действуют быстро, будто заранее готовили папку «экстренные фейки».

Публикуют всё: видеоигры, архивы, нейросеточные фантазии. Потом подключаются премиальные аккаунты, которые должны бы быть серьёзнее. Но нет — синие галочки не мешают им разгонять выдумки. Эти аккаунты делают вид, что служат информированию, хотя работают на трафик, деньги и политические интересы.

Соцсети дают почву. Платформы расслабляют модерацию, продают подписки, создают иллюзию достоверности. Пользователи, привыкшие к новостям «здесь и сейчас», хватаются за любую картинку, особенно когда настоящих данных ещё нет. Они уверены, что мир обязан работать по их расписанию.

ИИ лишь усиливает хаос. Инструменты, которые должны были проверять факты, становятся участниками дезинформации. Чатботы подтверждают фейки. Поисковые системы создают версии событий, которых никогда не было. Алгоритмы — слишком послушные и слишком самоуверенные.

Результат — ощущение, что реальность больше не зависит от фактов. Она зависит от того, кто первым выложил картинку. А люди в Иране, которые пытаются преодолеть интернет-блокировку, оказываются тише всех. Их голоса заглушают те, кто генерирует ложь пачками.

В этой истории каждый действует по интересам: кто-то ради влияния, кто-то ради прибыли. И никто не спешит спрашивать, что стоит за цифрами просмотров. Потому что в эпоху визуального шума истина — самый слабый игрок.