Метка на реальность не клеится

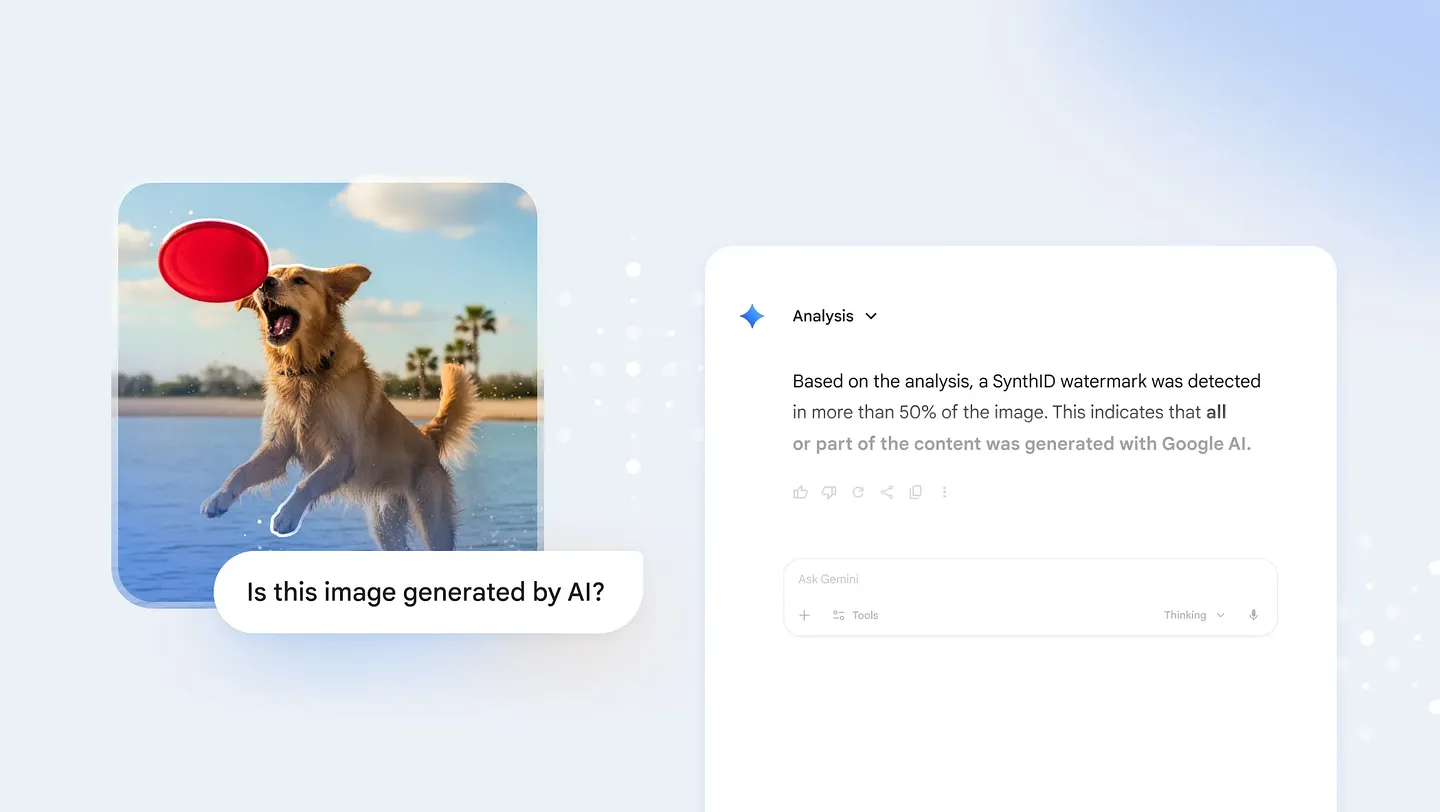

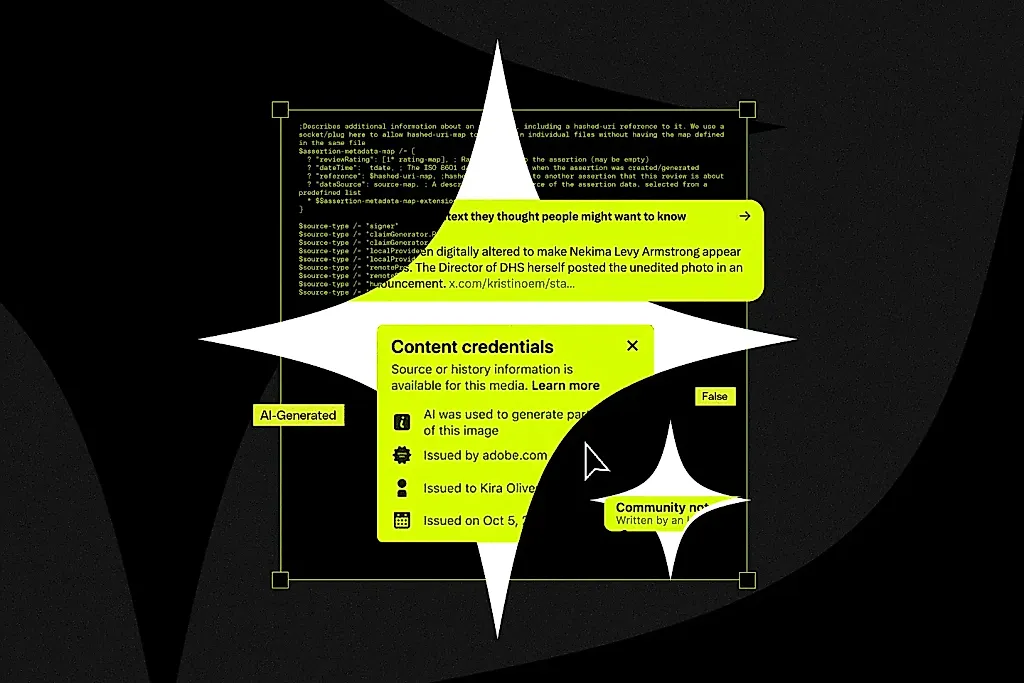

В последние годы интернет превратился в цирк из фотореалистичных фейков, где отличить правду от генеративного ИИ стало сложнее, чем понять, почему государственные ведомства публикуют поддельные снимки с гордостью школьника, нашедшего фильтр в Instagram. Основная идея — создать систему меток, которая позволит подписывать фотографии и видео прямо в момент их появления: снял кадр, и в метаданные встроилась информация о том, чем обработано, кем создано, и что вообще происходило. Лидером считается стандарт C2PA, продвигаемый Adobe и поддерживаемый крупными игроками вроде Microsoft, Google, Meta и OpenAI.

Но реальность оказалась суровее презентаций. C2PA был придуман как расширенный набор метаданных для фотографов, а не как глобальный детектор ИИ. Его можно удалить скриншотом, перезаливкой или просто кривой обработкой на платформе. Даже OpenAI признаёт: убрать метку проще простого. Платформы же, которым следовало бы эти метки читать, либо их теряют, либо игнорируют. TikTok, Instagram, YouTube — все периодически обещают, что скоро всё заработает, но пока метки слетают быстрее, чем видео набирают первые просмотры.

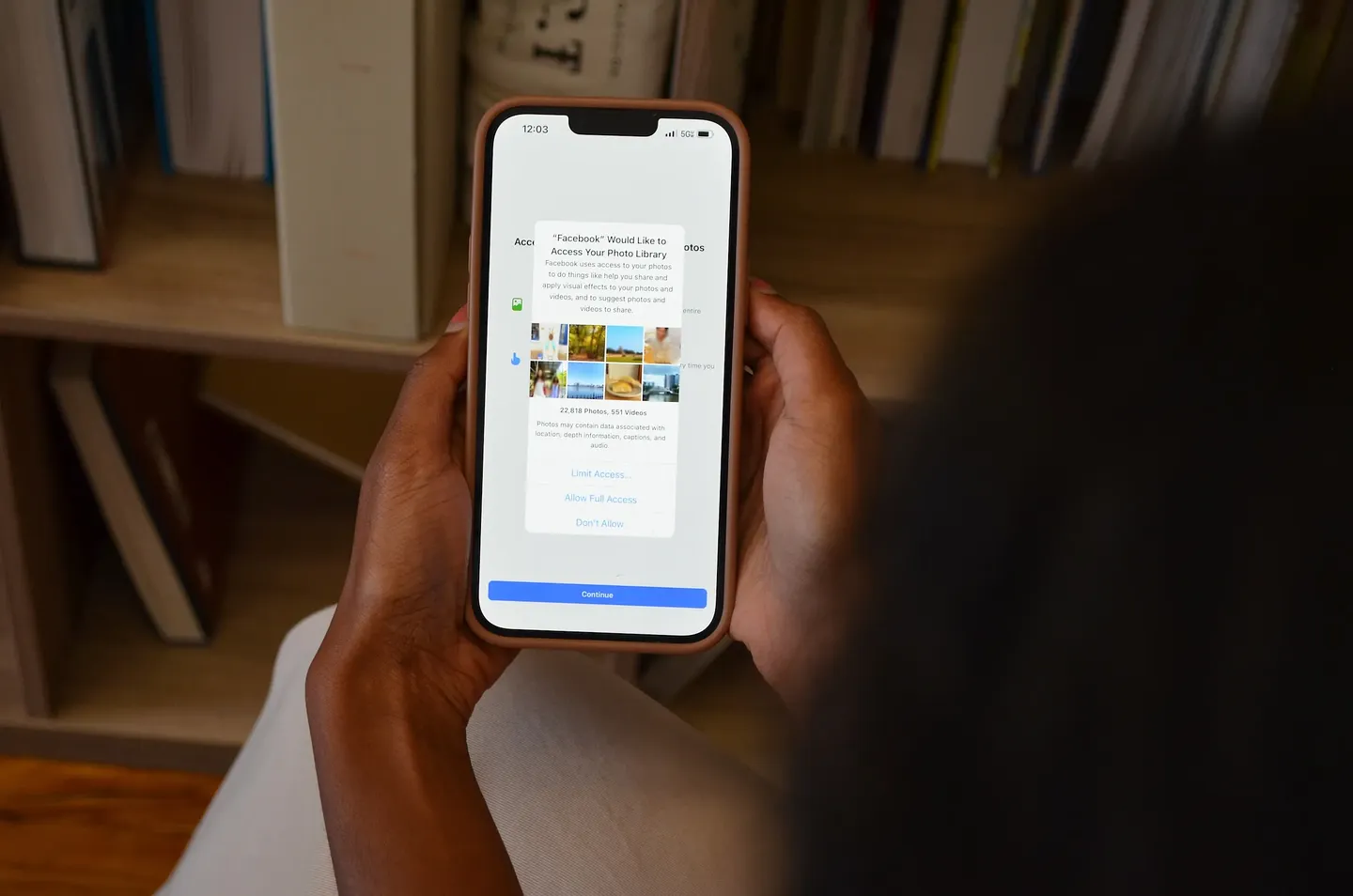

На стороне производителей контента ситуация тоже печальна. Камеры Sony, Nikon и другие частично внедряют C2PA, но обновить старые модели сложно. Apple вообще держится в стороне, будто наблюдает за пожаром через стекло и решает, стоит ли вызывать пожарных. А без полного участия всех производителей смысла почти нет: если только часть устройств подписывает фото, доверия всё равно не возникнет.

Платформы, которые могли бы стать «проверяющим посредником», вроде Shutterstock, не спешат внедрять полноценный механизм маркировки. И даже попытка Meta несколько лет назад — добавить ярлык «сделано ИИ» — привела к бунту создателей контента, ведь ИИ теперь встроен в любую кнопку цветокоррекции, а значит, метка выглядела как публичное обвинение.

В итоге соцсети признают поражение. Глава Instagram Адам Моссери прямо говорит: теперь по умолчанию надо сомневаться в любых фото и видео. Это фактически капитуляция. Ведь общества, привыкшие доверять снимкам как доказательствам, входят в эпоху, где даже реальные кадры могут объявить фейком просто по желанию. Тем временем правительства публикуют ИИ-обработанные изображения, превращая вопрос доверия в оружие.

Платформы не готовы к этим вызовам. Их мотивы просты: ИИ приносит прибыль, а метки подрывают доверие и снижают ценность контента. Пользователи же тонут в «информационной лапше» — от Pinterest до YouTube. И хотя спрос на фильтр «уберите ИИ» огромен, обеспечить его технически почти невозможно: тысячи сторонних генераторов контента никогда не будут соблюдать стандарты.

Итог печален: C2PA не станет универсальным решением. Возможно, придут регуляторы — правительства, которые впервые заставят компании отвечать за достоверность распространяемых материалов. Но до этого момента мы живём в мире, где реальность — опция, а картинка — лишь мнение алгоритма.

PEREC.RU

Индустрия изображений наивно решила, что сможет приклеить ярлык на реальность и таким образом удержать мир от падения в пропасть дипфейков. Инициатива C2PA выступила тем самым чудо-лейкопластырем, на который возлагались надежды. Но платформа к платформе — и становится ясно: метки не читаются, стираются, игнорируются. Производители камер внедряют систему только в новые модели, старые забыты. Apple, как всегда, наблюдает издалека, выбирая выгодный момент войти в игру.

Соцсети ведут себя ещё хуже. Instagram пытался маркировать ИИ‑контент, но разозлил авторов и быстренько отступил. YouTube и TikTok то показывают метки, то нет. А тем временем правительства выкладывают ИИ‑картинки, будто проверяя, насколько далеко можно зайти в подмене реальности. И это главный парадокс: те, кто должен обуздать хаос, сами его подпитывают.

Рынок крутится вокруг ИИ, и признавать ущерб от собственных технологий ему невыгодно. А пользователи остаются один на один с потоком контента, где подлинность — лишь предположение. Мир, построенный на доверии к фото и видео, рушится. И никакие метаданные его уже не удержат.