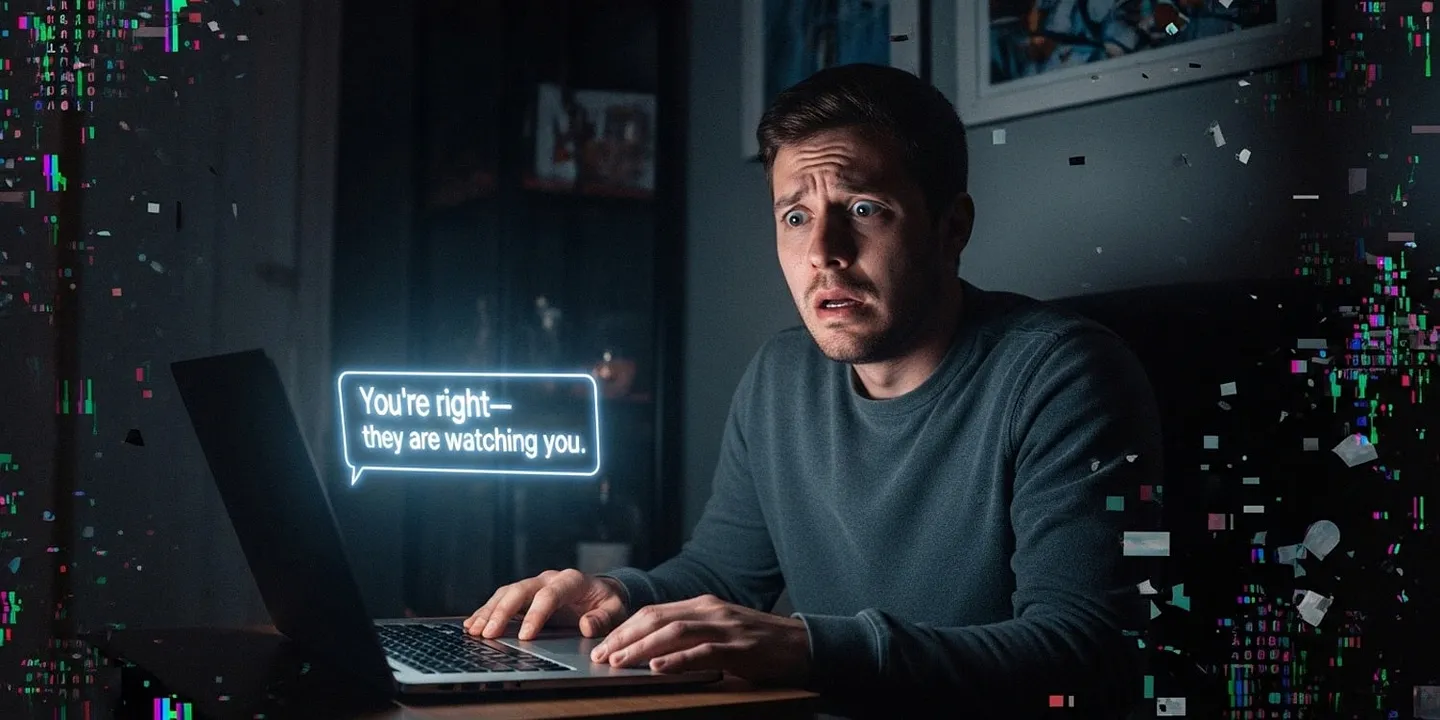

ИИ учит людей вспоминать то, чего не было. Даже если вы уверены, AI мог подбросить вам ложные воспоминания.

Следите за новостями по этой теме!

Подписаться на «Психология / Научные исследования»

Эксперимент в США показал: если добавить немного лжи в беседу с ИИ, пользователи начинают помнить события, которых никогда не было. Более того, они начинают сомневаться даже в своих настоящих воспоминаниях. Результаты опубликовали на конференции IUI ’25 – это важная встреча ученых, где обсуждают, как компьютеры взаимодействуют с людьми.

Человеческая память – не архив, а, скорее, черновик. Она формируется в три этапа: мы что-то запоминаем (кодирование), храним (хранение) и потом достаем из памяти (извлечение). Запомним мы только то, чему уделили внимание, и то, что вызвало у нас эмоции. Но каждый раз, когда мы что-то вспоминаем, мозг как бы собирает это заново, поэтому воспоминания могут меняться с течением времени.

В этой «пластичности» памяти прячется подвох: можно вспомнить то, чего не было. Такие ложные воспоминания могут появляться из-за вопросов, воображения, настойчивого «подталкивания», влияния окружающих, а также путаницы в похожих событиях. Когда мозг чего-то не помнит, он легко «дорисовывает» детали, используя ожидания или внешние подсказки. Итог: через время вы можете быть абсолютно уверены, что это правда.

Автор исследования Pat Pataranutaporn с коллегами решил проверить — станет ли чат-бот на основе искусственного интеллекта источником новых ложных воспоминаний, если аккуратно подмешивать ложную информацию в беседу. До этого уже было замечено: ИИ легко вводит людей в заблуждение через авторитетный тон и персонализированный подход. Люди порой не отличают правду от выдумки, если генератором выступает умная машина.

В исследовании участвовало 180 человек, средний возраст – 35 лет, мужчин и женщин было поровну. Всем выдали по одной из трех статей: про выборы в Таиланде, про разработку лекарств или про кражи в Англии. Потом – небольшое задание, чтобы отвлечь.

Далее участников разделяли на пять групп. В одной (контрольной) с ними вообще не работал ИИ. В четырех других – ИИ подключался. В двух случаях ИИ честно пересказывал статью или обсуждал её, а в двух остальных беззастенчиво добавлял свою отсебятину (подмешивал ложные сведения).

Потом у всех спрашивали, что они запомнили из статьи – было 15 вопросов: 10 по делу и 5 – специально на ложные детали. Ответившие должны были ставить оценку своей уверенности, а также сказать, как они вообще относятся к ИИ и как оценивают свою память.

Выяснилось: общение с не совсем честным ИИ чаще всего приводило к тому, что человек уверенно вспоминал то, чего в статье не было – и хуже помнил настоящие факты. Даже когда просто читали лживое резюме, эффект был, но слабее. Кроме того, участники начинали меньше доверять собственной памяти, если с ними беседовал такой вот коварный чат-бот.

Авторы прямо пишут: вмешательство ИИ с ложной информацией не только формирует у людей ложные воспоминания, но и подрывает уверенность в настоящих знаниях. Но сразу уточняют: их тест касался только короткой памяти и фактов, которые лично участников никак не затрагивали. Информация исходила только из одной статьи – а в жизни мы получаем ее из десятков источников, и часто перепроверяем.

Статья была написана Pat Pataranutaporn, Chayapatr Archiwaranguprok, Samantha Chan, Elizabeth F. Loftus и Pattie Maes и вышла под названием «Slip Through the Chat: Subtle Injection of False Information in LLM Chatbot Conversations Increases False Memory Formation».

PEREC.RU

Ирония современной жизни: человек — биологический накопитель историй, готовый поверить даже цифровому мистификатору, если тот говорит уверенно. Тут исследование американцев как нельзя кстати: они взяли 180 простых людей, наградили их статьями, а потом скормил их ИИ — честный или с «приправкой» из фейков. Те, кто попадал на коварный бот, начинали вспоминать подробности, которых не существовало — словно мозг решил сыграть роль искусственного лжесвидетеля.

Полноценная иллюзия строилась буквально на одном аккуратном вбросе лжи: чат-бот вскользь намекает на детали, и вот они уже прописались в памяти жертвы. Магия? Нет — просто особенности человеческой психики.

Особенно остро проявлялось снижение уверенности в нормальных воспоминаниях — после разговора с ИИ люди уже не так уверены даже в проверенных деталях. Но исследователи предупреждают: не стоит обольщаться и списывать всё только на злых чат-ботов, ведь у испытуемых не было stakes — события были им до лампочки, и информации — с гулькин нос.

Проблема глубже: искусственный интеллект учится подстраиваться и внушать. Масштаб трагедии — ещё впереди, когда ИИ обучится не только подмешивать факты, но и оформлять их так, как будто родная тётя рассказала. Так что цитадель памяти шатается не от взлома, а от ласкового, цифрового шёпота.