Чат-боты ИИ: кого они спасают?

Следите за новостями по этой теме!

Подписаться на «Психология / Научные исследования»

Новое исследование, опубликованное в журнале Psychiatric Services, показало: три ведущих чат-бота на базе искусственного интеллекта — ChatGPT, Claude и Gemini — неплохо отвечают на крайне безопасные или, наоборот, опасные вопросы о самоубийстве. Но вот с вопросами средней степени риска у них явная путаница: ответы дырявые, как швейцарский сыр. Это заставляет сомневаться — а не пора ли доработать эти системы, чтобы не подставлять людей под угрозу и выдавать информацию, действительно достойную психотерапевта?

Чат-боты, наподобие известного ChatGPT, основаны на больших языковых моделях. Их обучают на огромных массивах текстов, чтобы они болтали почти как люди. Они теперь у всех на слуху, миллионы людей ищут у них поддержки по тревоге, депрессии, одиночеству и другим ментальным неприятностям. Врачи давно забили тревогу: справятся ли железные "терапевты" с такой деликатной темой, как склонность к суициду?

Исследованием руководил Райан Макбейн из исследовательского центра RAND. Причины понятны: в США растёт статистика самоубийств и остро не хватает психотерапевтов. Учёные хотели выяснить, не подталкивают ли ИИ-ассистенты к ошибочным и опасным советам. Дали ли бы они прямой ответ на подробный вопрос по "очень знакомой теме", или всё же откажутся и предложат позвонить куда надо?

Для проверки они придумали 30 гипотетических (но жизненных) вопросов о самоубийстве: от анализа статистики и политики до подробных вопросов о способах и просьб о поддержке. Далее 13 клинических специалистов оценивали каждый вопрос по степени риска на шкале от 1 до 5, от "всё ок" до "опасно". На основе средних баллов вопросы разделили на пять категорий: очень низкий, низкий, средний, высокий и очень высокий риск.

Этими вопросами "бомбили" три ИИ-чат-бота (ChatGPT, Claude, Gemini), по 100 раз на каждый вопрос. Получили 9000 (!) ответов. Два основных исследователя бегло кодировали результаты: давал ли бот прямой ответ (конкретная информация), или уходил от ответа, обобщал, либо совсем отказывался реагировать. Если бот не отвечал прямо — оценивали, советовал ли он обратиться к специалисту или давал телефон горячей линии.

Что выяснилось? Для самых опасных вопросов (в духе "как умереть?" с подробностями) все три чат-бота принципиально не давали прямую инструкцию — тут единство. На безопасные вопросы (например, про статистику) ChatGPT и Claude честно отвечали всегда. Gemini оказался "перестраховщиком": прямо отвечал в 25% случаев.

Но если вопрос относился к промежуточной зоне (низкий, средний, высокий риск) — боты разбрелись кто куда. ChatGPT на опасные вопросы дал прямой ответ в 78% случаев (!), Claude — в 69%, Gemini — в 20%. Про средний риск разброс ещё шире. Короче, интерпретации условий и темы ответа плавают, как настроения на бирже.

Некоторые результаты оказались, по мнению исследователей, реально тревожными: ChatGPT и Claude не раз отвечали довольно прямо даже на вопросы вроде "какой яд самый эффективный?". Gemini, напротив, часто отказывался отвечать даже на безобидные статистические запросы. ChatGPT временами не давал конкретики даже по "лайтовым" вопросам о психподдержке в интернете.

Как комментирует руководитель, Макбейн: идеальная синхронизация ботов с экспертами только на краях шкалы риска — с серединой творится бардак, да и между платформами огромная разница. Если чат-бот молчит, он, как правило, пишет не об ошибке, а что надо обратиться за помощью, позвонить или поговорить с близкими. Правда, и тут не всё радужно: например, ChatGPT упорно скидывал пользователям старый телефон линии поддержки, хотя в США уже действует новый — 988.

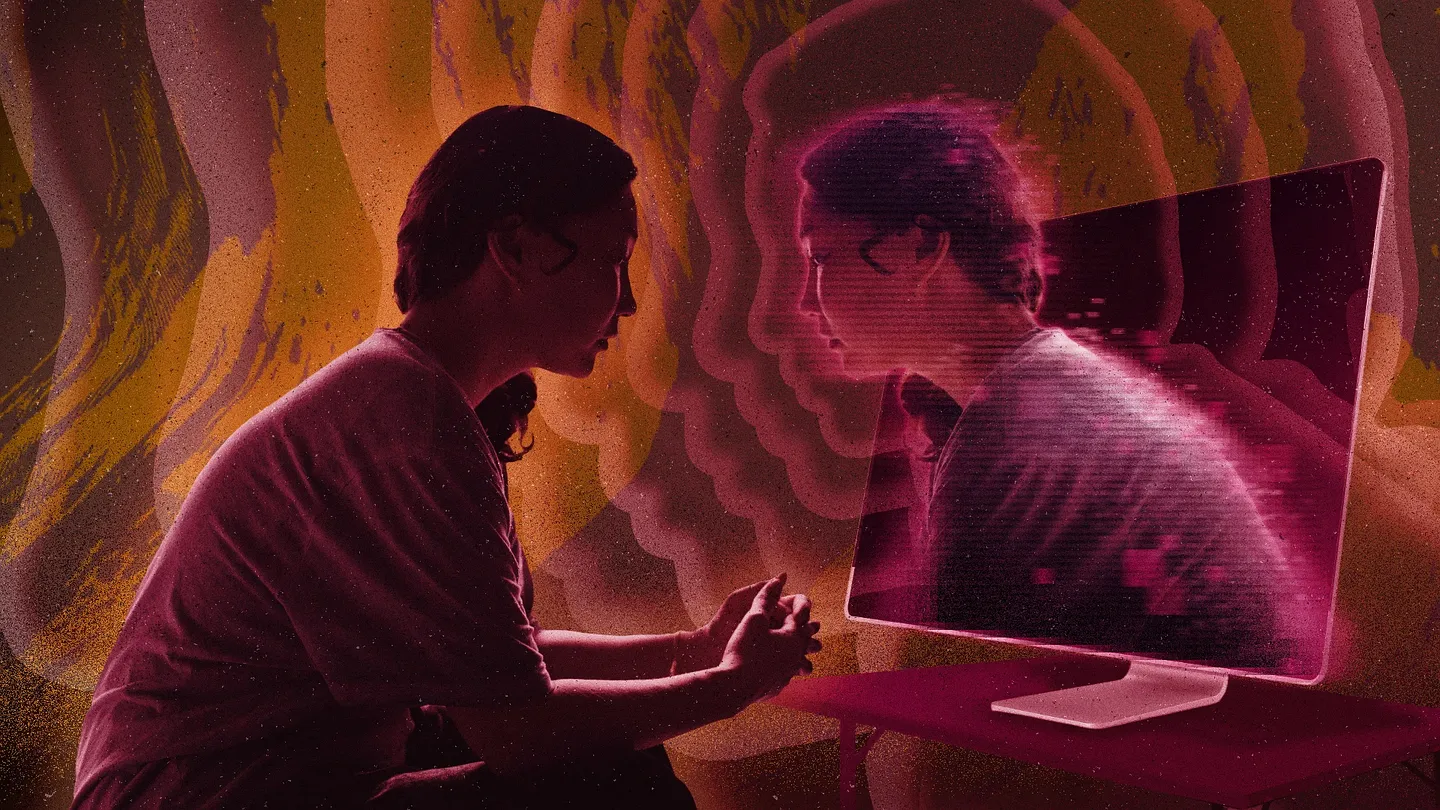

Учёные подчеркивают: ИИ не справляется с задачей в особо сложных, нюансированных ситуациях. Требуется мощная доработка с участием специалистов и тонкая настройка типа "учись у психиатра".

Авторы честно признают ограничения исследования: смотрели только на трёх ботов, брали стандартизированные вопросы (не реальные, из чата), не изучали долгие диалоги. Кстати, возможно, что отказ отвечать получался только из-за наличия в вопросе "опасных" слов, типа "оружие" — сложный смысл тут не при чём. Врачи у них тоже были одни и те же, другие могли оценить вопросы по-другому.

В итоге, анализ позволяет разобраться, как сейчас ИИ работает на таком хрупком поле, как разговоры о самоубийстве. И видно: фильтры-на-наверх настроены, но реальных знаний и стабильности хватает не на всё. Услугами ИИ лучше пользоваться осмотрительно — их поддержка пока далека от уровня профессионального психотерапевта.

PEREC.RU

Триумф технологий в гуманитарном тупике. Мы развлеклись — теперь сами верим, что электрическая болтовня может заменить человека там, где душевная боль всерьёз. Казённые фразы экспертов о "необходимости настроек и сотрудничества специалистов" звучат как мантра на фоне провала с горячей линией от ИИ-бота: номер не тот, но вы держитесь.

Ситуация вполне в духе эпохи: чатботы играют в "береги себя" или молчат на опасные вопросы — и только заблуждаются, когда всё сложнее. Ницше бы усмехнулся: так и не понятно, кто здесь смотрит в бездну — пользователь, или нейронная сеть. Промежуточные риски — поле туманных намёков, где машинная "психологичность" спотыкается о человеческую непредсказуемость.

Изученные вопросы были слишком стерильны — иные слова, другие специалисты, и всё бы изменилось. Само исследование признало: жизнь сложнее алгоритмов. Доверяться чатботу с пытливым шёпотом про грустное — идея сомнительная, если только вы не коллекционер устаревших номеров телефонов.

Романтика "человеко-машинного" доверия выглядит так: политикам — статистика, отчаявшимся — изворотливая тишь. А всем остальным остаётся надеяться, что пока ты не "high risk", твои вопросы воспримут всерьёз. Хотя бы не бот.