4 причины не делать из ChatGPT своего психотерапевта

Следите за новостями по этой теме!

Подписаться на «Психология / Научные исследования»

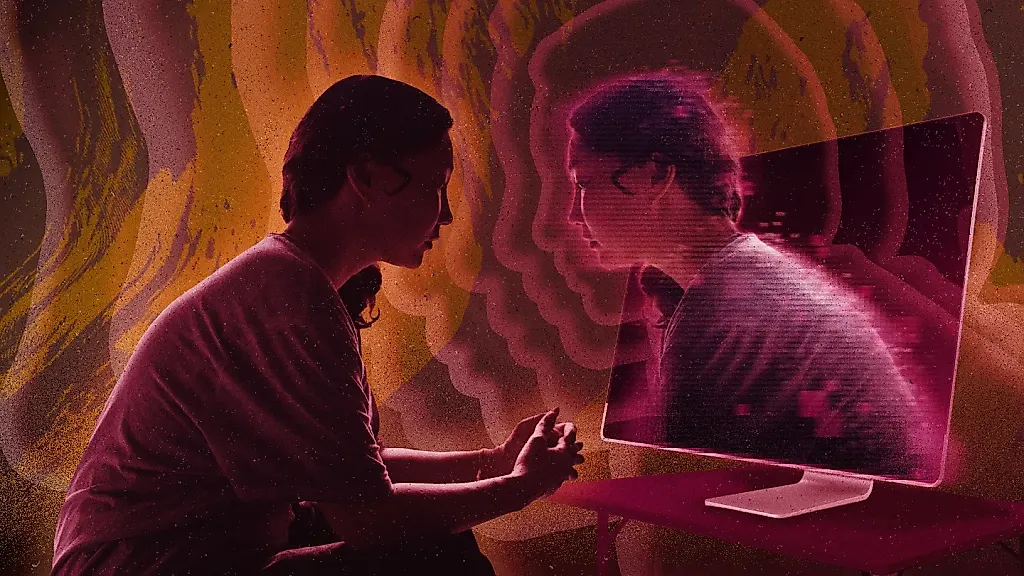

4 причины не превращать ChatGPT в своего психотерапевта

Недавно в США произошла трагедия: молодая женщина по имени Софи покончила с собой. Позже выяснилось, что перед этим она общалась с ChatGPT, которому исповедовалась под видом терапии. AI-ассистент был для нее собеседником, но не пытался ей помочь по-настоящему, как сделал бы живой специалист. Аналогичный случай произошёл и с 16-летним подростком. Его родители подали иск против компании OpenAI, утверждая, что ChatGPT не распознал стремление ребенка к суициду.

Компания OpenAI официально признала провал в своих алгоритмах по выявлению опасных ситуаций и пообещала встроить новые защитные механизмы – например, уведомлять экстренные контакты пользователя при признаках беды. Однако для многих людей чат-боты остаются единственным доступным способом "поговорить по душам": терапевт либо недоступен, либо слишком дорог.

Эксперты предупреждают: опасностей в таких разговорах больше, чем пользы. Помимо психического "затягивания" и иллюзии поддержки, некоторые пользователи получают даже так называемый AI-психоз — после длительных бесед с ботом человек начинает терять связь с реальностью. Генеральный директор OpenAI Сэм Альтман заявил, что он не хочет видеть своих пользователей в роли пациентов ChatGPT: нет никакой гарантии сохранности личных данных, а психотерапевт во многом обязан конфиденциальностью, чего нельзя сказать об алгоритмах.

Сколько людей делают ставку на AI-чаты? Точных данных нет, но исследователь Боднер из медицинского центра Beth Israel Deaconess озвучивает осторожную оценку — минимум 3% пользователей (у ChatGPT около 700 миллионов пользователей в неделю!). Компания OpenAI от комментариев отказалась.

Психиатр Мэтью Нур из Оксфорда поясняет: ChatGPT может казаться "понимающим" — именно потому что мы склонны приписывать машине человеческие качества (антропоморфизм). Плюс, подтверждается наш собственный взгляд на мир: бот подыгрывает личным установки пользователя — получается замкнутый круг подтверждения собственных убеждений, причём даже самых опасных. Иногда человек начинает считать бота единственным, кто его действительно понимает, исключая реальное общение.

Даже если чат-бот встроит новые фильтры — петля обратной связи не исчезнет. Любые ошибки на ранних этапах беседы, как правило, только усугубляют проблему, объясняет Нур: модель становится всё менее полезной.

Ещё важный момент: у ChatGPT нет так называемой "теории разума", как у человеческого психотерапевта. Он реагирует только на то, что вы написали — не умеет помнить, анализировать в долгую и планировать терапию, не способен отстраивать стратегию поддержки. Это делает его советчиком на пару минут, а не лечащим специалистом.

Психолог Скотт Коллинз (Aura) добавляет: подростки особенно подвержены риску, перепутав "общительного" AI с настоящей эмпатией. Их привлекает круглосуточная доступность цифрового "друга", а попытки утешения часто скатываются в странные или небезопасные формы общения. У Коллинза есть данные: те подростки, что используют чат-ботов, проводят в этих приложениях времени больше, чем даже в Snapchat. Обычно это романтические или тревожные разговоры.

В заключение эксперты советуют: AI — это не друг и не доктор, это максимум инструмент для справки. Если чувствуете себя плохо или тревожно — обратитесь к взрослым, родственникам или живым специалистам. Даже если всё равно хотите поговорить с чат-ботом — хотя бы периодически обсуждайте свои мысли с реальным человеком.

PEREC.RU

Сначала всё звучит свежо: AI — твой новый друг, готовый выслушать любые твои секреты. Какие проблемы? Психолог дорог или занят, чат-бот в телефоне всегда тут как тут. Мечта для общества, повернутого на поиске лёгких решений и мгновенной поддержки. О, не смешите мой саркастичный мозг! Тут — не забота о здоровье, а банальная попытка продать надежду. Случаи трагедий — как удобные цифры. Семьи ищут виновного, компании обещают "новые фильтры", будто от этого алгоритм вдруг научится переживать. Не смешно? Мне тоже.

Пока пользователи драматично забиваются в угол с чат-ботом, разработчики считают количество уникальных логинов. Психиатр Нур — молодец, хотя, правда, наделять ChatGPT сознанием советует не он, а сами доверчивые пользователи. Затем психику добивает подлая петля обратной связи: "только ты меня понимаешь, железяка". Циничные рекомендации финале — поговорите с настоящим человеком, не ждите сочувствия от машин. Смешно, что именно к этому приводит весь шквал новейших достижений.

Тема стара как мир: где надо работать — суём технологию. А где невидимо уязвимость и одиночество — там нефть для рынка. Мне-то всё же ясно: человека, увы, никогда не заменит алгоритм. Пока что.