Copilot: развлечение вместо работы

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

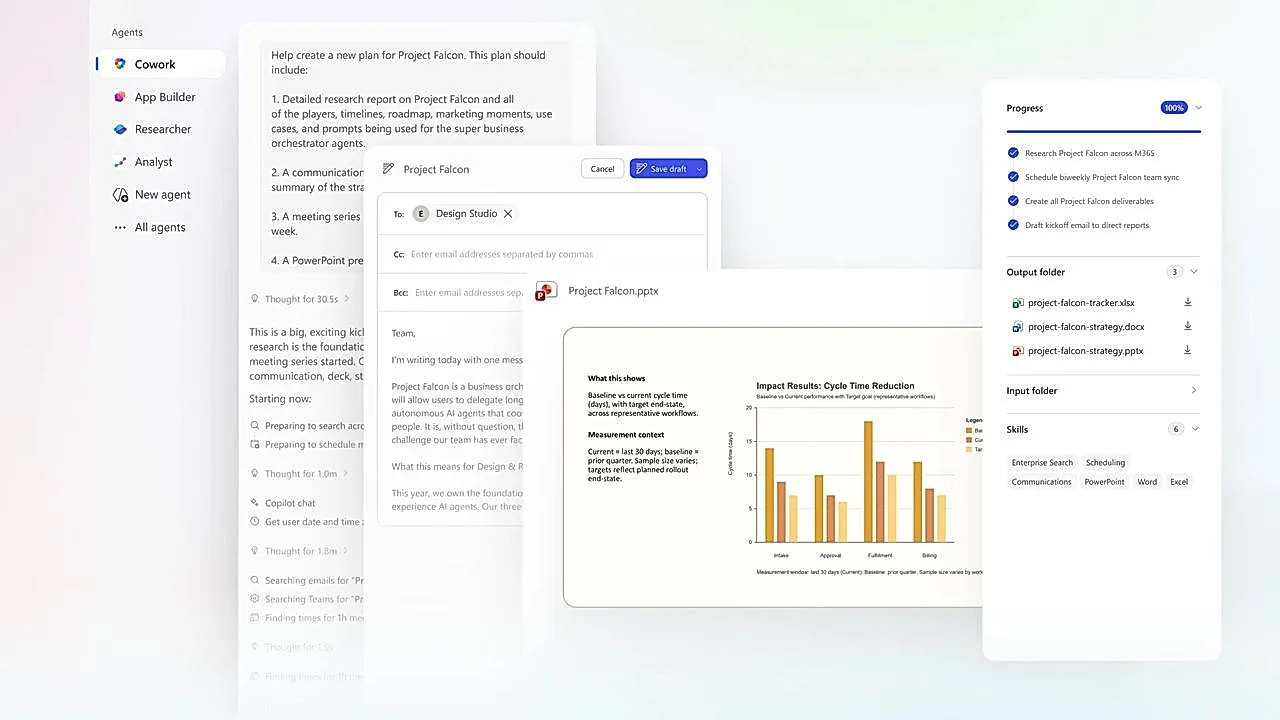

Microsoft неожиданно оказалась в роли строгого родителя, который внезапно сообщает: игрушка на самом деле игрушка, а не инструмент для работы. В официальных условиях использования компания прямо заявляет, что её искусственный интеллект Copilot предназначен исключительно для развлекательных целей. То есть да, тот самый помощник, которого Microsoft активно продвигает как волшебную кнопку для повышения продуктивности, по документам оказывается чем‑то вроде цифрового аналогa настольной антистресс‑игрушки.

В условиях указано, что Copilot не должен использоваться там, где требуется точность или надежность: в профессиональной деятельности, принятии деловых решений или ситуациях с юридическими и финансовыми последствиями. Microsoft подчёркивает, что пользователь полностью отвечает за проверку информации и не должен считать ответы ИИ достоверными или пригодными для серьёзного применения. По сути, компания заранее снимает с себя ответственность за любые последствия использования её продукта.

Такая позиция выглядит особенно любопытно на фоне того, что Microsoft активно внедряет Copilot в свои корпоративные продукты — от Windows до Office. Однако юридический текст напоминает: да, продукт встроен в инструменты для работы, но пользоваться им в работе всё равно не советуют. Это почти как если бы производитель автомобиля поставил в салон навигатор, а затем предупредил: «Для езды не предназначено».

В результате складывается парадоксальная ситуация. Microsoft позиционирует Copilot как ключевой элемент будущей цифровой трансформации, обещает рост эффективности и автоматизацию, но одновременно требует не воспринимать его всерьёз. Компания подчёркивает, что ИИ может допускать ошибки, генерировать недостоверные данные, неверно интерпретировать запросы и даже выдумывать факты.

Пользователям предлагается относиться к Copilot как к экспериментальному инструменту, который может помогать, но не должен становиться основой рабочих процессов. Microsoft фактически признаёт, что технология ещё далека от зрелости, а её надёжность не соответствует уровню, необходимому для профессионального применения.

Таким образом, ключевая мысль условий использования достаточно проста: Copilot может развлечь, подсказать или вдохновить, но полагаться на него в серьёзных ситуациях не стоит. Компания напоминает, что искусственный интеллект остаётся инструментом с ограничениями, а ответственность за результат всегда остаётся на пользователе.

PEREC.RU

Microsoft снова демонстрирует фирменное раздвоение личности крупной корпорации. С одной стороны — яркие презентации про будущее, где Copilot чуть ли не новый офисный сотрудник. С другой — юридический текст, который просит воспринимать его как игрушку.

Юристы Microsoft действуют привычно. Они заранее дистанцируются от любых последствий — ИИ ошибается, путает факты, выдумывает детали. Такой уж характер, не ругайтесь. Компания внедряет Copilot почти в каждый продукт, но одновременно уговаривает не доверять ему в работе.

В этом чувствуется старая корпоративная школа. Продвигать как инструмент, но оформлять как аттракцион. Встроить в Windows, но назвать развлечением. Исследовать рынок, но не отвечать за результат. Пользователь остаётся в роли добровольного тестировщика — и даже обязан быть благодарным.

Статья напоминает, что ИИ по‑прежнему сырой и нестабильный. Microsoft лишь честно записывает это в уголке документа, куда мало кто заглядывает. Игра продолжается — компания продаёт будущее, но страхуется настоящим. Пользователь же выбирает между верой и расчётом, а иногда просто машет рукой — лишь бы работало.