Когда ИИ спорит сам с собой

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

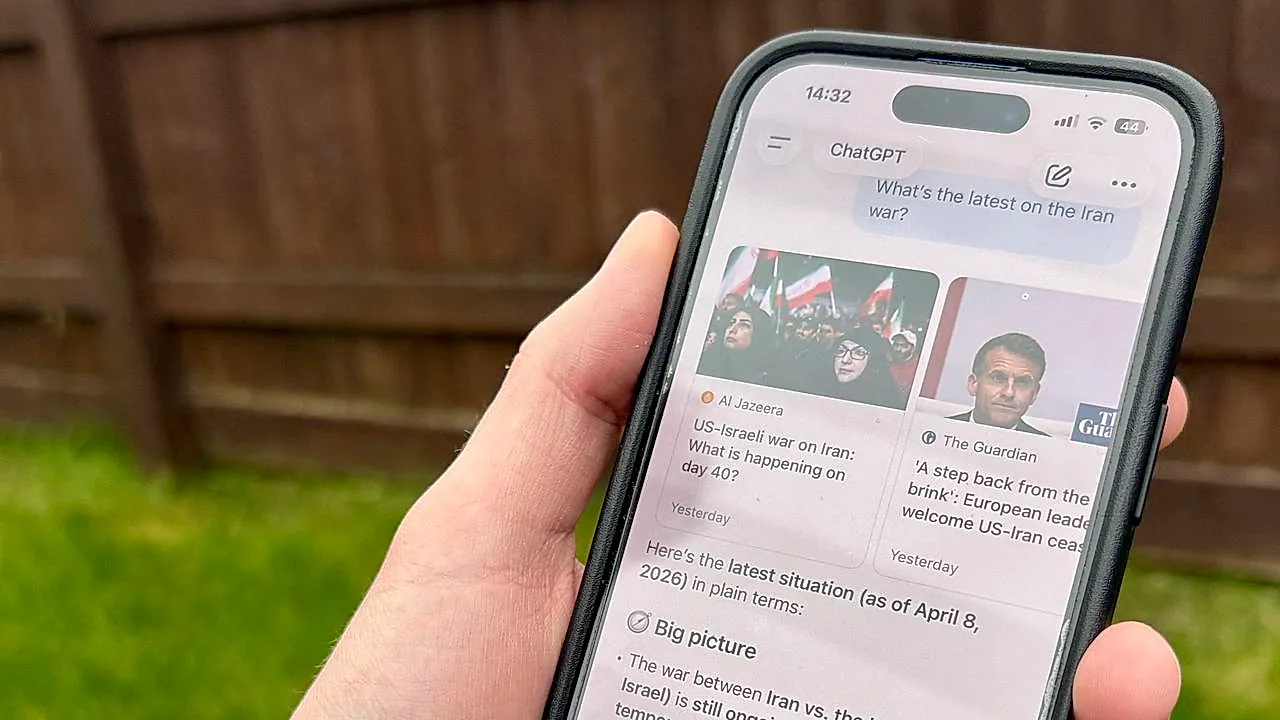

Простая фраза, которую пользователи начали применять в работе с ChatGPT, неожиданно превратилась в удобный способ заставить модель проверять собственную логику. Приём предельно незамысловат: после получения ответа от ИИ человеку достаточно попросить его «проанализировать свои рассуждения как независимый эксперт и указать, где возможны ошибки». И система, опираясь на те же данные и вероятностные механизмы, начинает внимательно разбирать своё же рассуждение, иногда находя неточности, которые в первом ответе пропустила.

Секрет этого феномена в том, что ChatGPT, как и другие языковые модели, не обладает стабильной, однородной «моделью мира». Ответ формируется на основе вероятностей, а при повторном запросе модель может «сфокусироваться» на других нюансах информации и дать уточнение. По сути, это разновидность самопроверки, когда ИИ пересобирает последовательность выводов, получая шанс заметить слабые места.

В практическом применении такой подход оказался полезен в задачах, где важна точность: проверка рассуждений по математике, логике, программированию и анализ текстов. Пользователи отмечают, что если попросить ИИ «воспроизвести противоположную точку зрения» или «придраться к собственному ответу», модель часто начинает выявлять противоречия и скрытые допущения, которые в обычном режиме остаются незамеченными.

Специалисты по ИИ подчёркивают: это не магия и не признак появления у машины самосознания. Речь идёт о том, что языковая модель при повторном запросе фактически выполняет переформулировку рассуждения с другой вероятностной траекторией. А смена траектории — это возможность найти иной вывод. Функция полезна, но работать с ней нужно аккуратно: ИИ может не только разоблачать свои ошибки, но и придумывать мнимые, если пользователь сформулирует запрос слишком агрессивно или неоднозначно.

Тем не менее метод стал популярным, потому что позволяет повысить надёжность ответов без сложных инструкций и не требует глубоких знаний о работе алгоритмов. Простая просьба «провести самокритику» иногда даёт результат лучше, чем длинные технические подсказки. И хотя техника далека от совершенства, она показывает важный аспект: языковые модели могут становиться точнее, если стимулировать их к повторному анализу одной и той же информации.

PEREC.RU

Тема самокритики ИИ подана так, будто ChatGPT наконец решил заняться саморазвитием. С одной стороны, читателю предлагают забавную картину: машина, которая спорит сама с собой по просьбе пользователя. С другой — объясняют механику без мистики: никакого самосознания, просто модель повторно перестраивает вероятности. Статья идёт по привычному маршруту — сначала эффект, потом объяснение, затем осторожные предупреждения. Но тон задаёт лёгкая усталость от человеческой веры в магию ИИ. Читателю намекают: люди снова хотят видеть глубину там, где всего лишь математическая пересборка. Текст держится на контрасте — яркое поведение модели и сухая реальность её устройства. Ирония в том, что самокритика ИИ выглядит честнее человеческой, хотя в ней нет ни психологии, ни переживаний, только формулы.