Китайский вызов

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

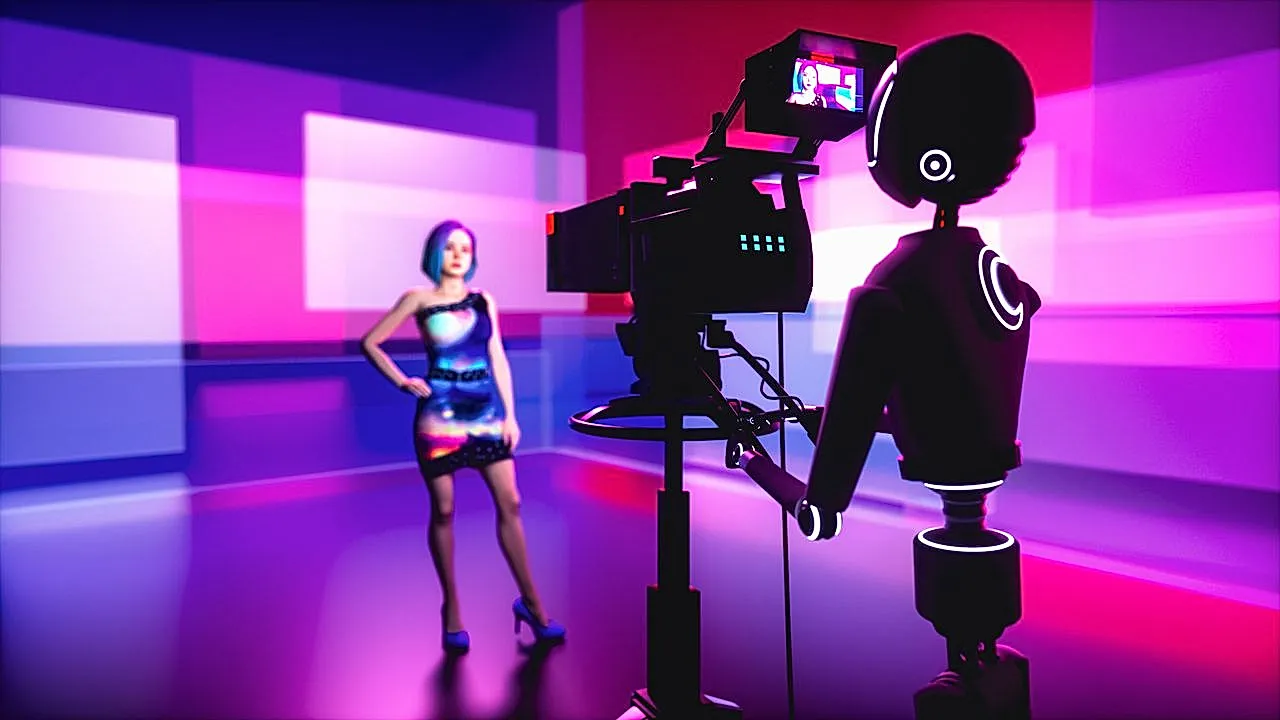

ByteDance, китайская компания, которая подарила миру TikTok, решила вновь напомнить, кто тут главный в гонке за следующей эпохой искусственного интеллекта. Компания представила Seedance 2.0 — модель, которая умеет превращать любые комбинации текстов, картинок, видеофрагментов и аудиозаписей в короткие видеоролики. И нет, это не очередной «генератор котиков». Это попытка вырваться вперёд в гонке за технологическое доминирование, где каждый месяц приносит очередной «революционный» инструмент.

По заявлениям ByteDance, Seedance 2.0 делает заметный шаг вперёд в качестве генерации: модель лучше справляется с многосложными сценами, в которых фигурируют несколько объектов, и точнее выполняет инструкции пользователя. Чтобы повысить шанс на результат «как в голове», пользователю разрешается подсовывать модели до девяти изображений, трёх небольших видеороликов и трёх аудиофайлов — своеобразный конструктор, из которого ИИ собирает итоговую творческую вспышку.

Готовый клип может длиться до 15 секунд и включать звук. Модель понимает визуальные подсказки: например, если загрузить фото комнаты, Seedance 2.0 сможет построить видеосцену, учитывая её освещение, геометрию и стиль. Такой подход открывает путь к созданию быстрых раскадровок, прототипов роликов, рекламных концепций и прочих «набросков будущего», которые раньше требовали команды специалистов.

Как и всегда, производители ИИ говорят о «технологическом скачке», но за кадром остаётся вопрос: как быстро такие инструменты изменят правила игры в медиа, рекламе и развлечениях? ByteDance явно не собирается пасовать перед конкурентами из США, которые в последние месяцы активно продвигают собственные генераторы видео. Теперь у глобальной технологической гонки появился новый раунд — и, похоже, китайские разработчики не намерены быть статистами.

Seedance 2.0 пока не описан детально с точки зрения устройства модели или используемых данных. Но уже ясно: создаётся инструмент, который превращает творческий процесс в эксперименты с промптами — набором подсказок на любой вкус. И хотя это всего лишь очередной 15‑секундный ролик, за ним чувствуется куда больше: попытка заново определить, кто будет контролировать будущий мир визуального контента.

PEREC.RU

ByteDance представила Seedance 2.0 — новую AI‑модель, которая создаёт видеоролики на основе комбинированных текстовых, визуальных и аудиоподсказок. Формально речь идёт о прогрессе в качестве генерации, но неформально — о попытке укрепить позиции в технологической гонке против американских конкурентов. Китайская компания делает ставку на мультимодальность: три видео, три аудио, девять изображений — и перед моделью уже полноценный набор ингредиентов. Она собирает из них 15‑секундный ролик, считая это нормой нового времени.

Интереснее всего наблюдать, как меняется сам подход к созданию контента. Там, где раньше работали режиссёры, дизайнеры и монтажёры, сегодня работает промпт. Творчество превращается в манипуляцию подсказками, а компании — в поставщиков алгоритмов, которые решают, что считать «качественным результатом».

ByteDance уверенно движется туда, где правила ещё не написаны. ИИ подстраивается под фото комнаты, понимает структуру сцены и делает всё это без лишних слов. Людям остаётся либо учиться работать с такими инструментами, либо наблюдать, как будущий визуальный мир уходит в сторону серверных ферм. В любом случае, Seedance 2.0 — очередное напоминание: гонка ИИ не прекращается, она только набирает обороты.