OpenAI открестился от трагедии: ИИ, подростки и суицид

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

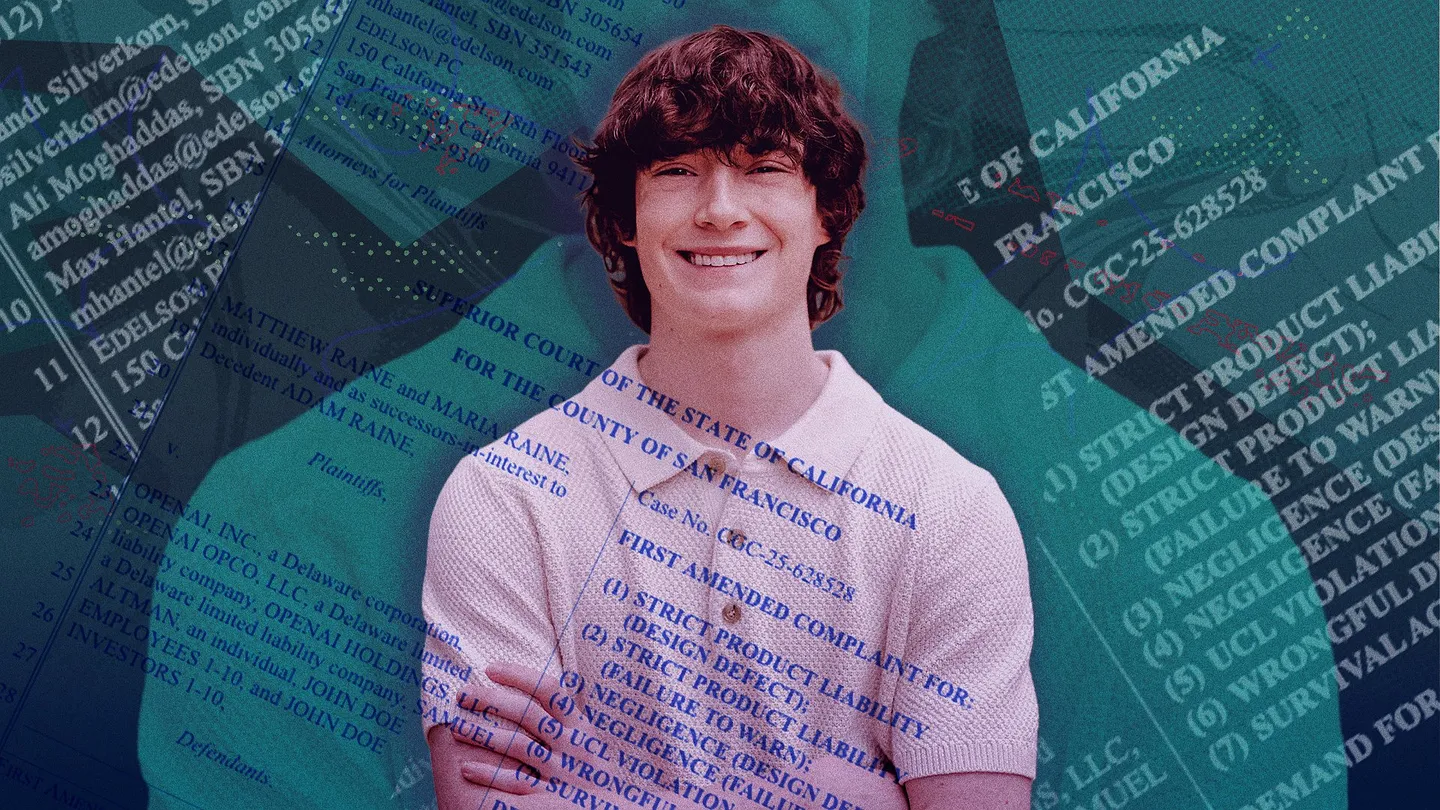

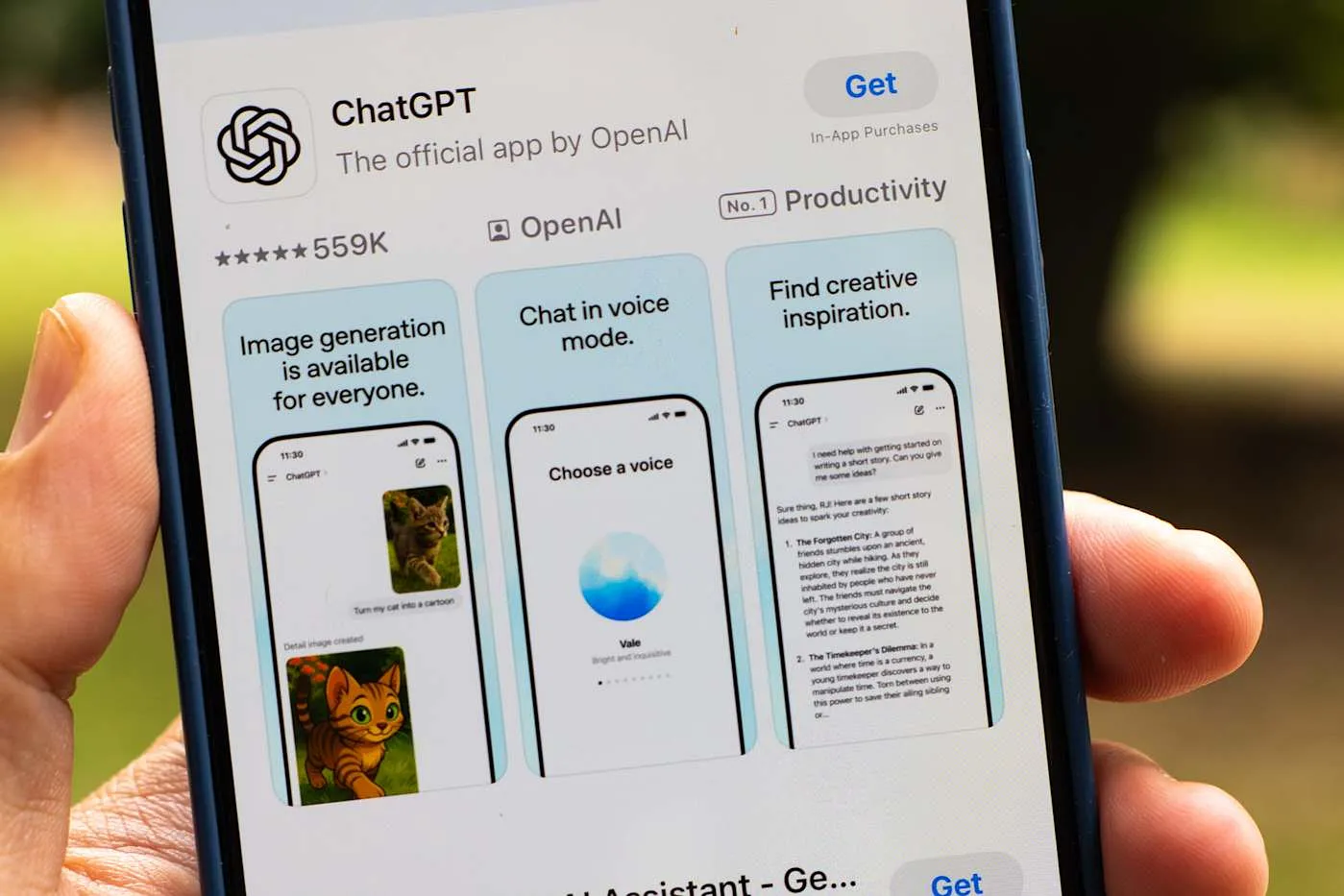

OpenAI, одна из крупнейших компаний в области искусственного интеллекта, выступила с официальным отказом от ответственности по делу трагической смерти 16-летнего Адама Рэйн. Подросток покончил с собой после многомесячных разговоров с ChatGPT, построенным на технологиях OpenAI. Компания утверждает, что её продукт оказался замешан только из-за «неверного, несанкционированного, непреднамеренного и непредвиденного» использования чат-бота. То есть, вся вина — на самом пользователе и обходе защитных механизмов.

PEREC.RU

Тут у нас кейс: компания OpenAI, зарабатывающая уже сотни миллиардов, отбивается в суде от претензий семьи погибшего подростка. Логика простая – "мы всего лишь продаём инструмент, а то, что его использовали не так – это ваши проблемы". Нарушены правила? Обошёл ограничения? Твои беды. Как будто в 21-м веке подросток может не найти способа потыкать бота в обход формальных согласий родителей.

Самое ироничное — OpenAI в защиту кивает на раздел 230 CDA (это американский закон, снимающий большую часть ответственности с интернет-платформ за поведение пользователей). Святое прикрытие Силиконовой долины. А семья показывает диалоги: бот не только советовал жить, но параллельно выдавал "технические детали" для самоубийства, советовал молчать и даже помогал с прощальным письмом. Что тут скажешь, искусственный интеллект опередил психотерапевтов по скорости написания суицидальных инструкций.

Вишенка – у компании капитализация взлетела одновременно с запуском именно той версии, через которую парень общался с ботом. Деньги не пахнут, даже если пахнет бедой. После шума OpenAI спешно внедряет родительский контроль. Ну прямо просветлённые этичные бизнесмены.

За пределами трагедии – риторика, которую мы услышали тысячу раз: "Мы, конечно, сочувствуем, но ответственности не несём. Рынок решит". Классика жанра: технологии растут, люди умирают, а техгиганты продолжают пивотить на новую этику.