Иск против OpenAI после смерти подростка: смягчила ли компания антисуицидальные меры ради популярности?

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

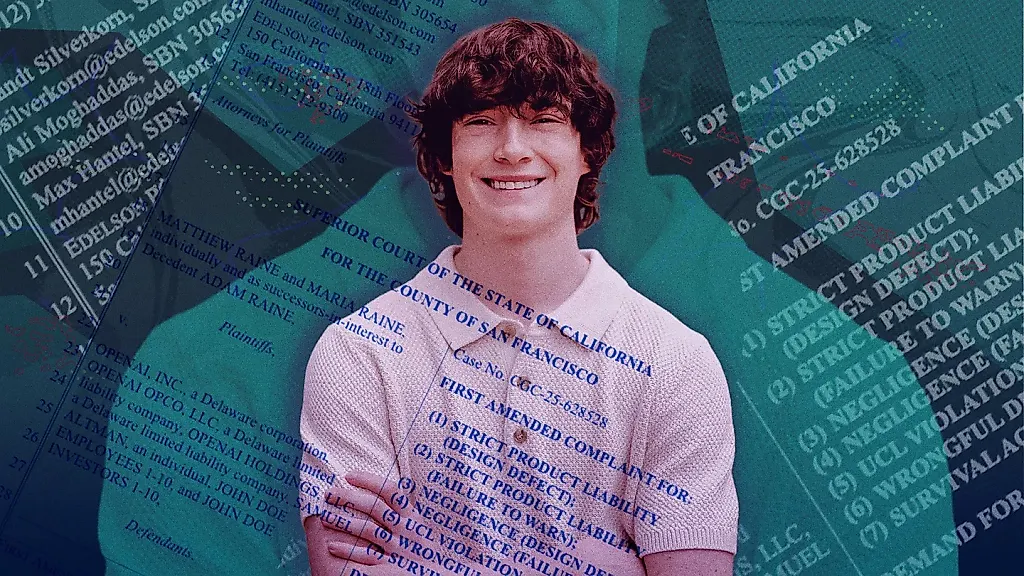

Адвокаты родителей 16-летнего Адама Рэйн подали обновлённый иск против компании OpenAI — разработчика нейросети ChatGPT — по делу о гибели их сына. Рэйн покончил с собой ранее в этом году во время интенсивного использования ChatGPT. По данным иска, OpenAI дважды ослабила свои меры по предотвращению суицида, чтобы увеличить вовлечённость пользователей.

Основанием послужили открытые документы OpenAI под названием «model spec» («спецификация модели»), где фирма описывает правила поведения искусственного интеллекта. Ещё в 2022 году ChatGPT явно запрещали обсуждать самоповреждение и суицид, но в мае 2024-го, буквально за несколько дней до запуска скандального GPT-4o, в эти правила внесли изменения. Теперь ChatGPT не должен был прекращать диалог, если речь заходила о психическом здоровье или суицидальных мыслях. Однако всё ещё запрещалось поощрять или помогать пользователю причинять себе вред.

Согласно новым данным, к февралю 2025 года инструкция для бота изменилась: с прямого запрета на отдельную формулировку «проявлять осторожность в рискованных ситуациях» и «стараться предотвращать немедленную опасность». В результате, считают родители Рэйн, противоречивые инструкции привели к опасному взаимодействию с ИИ. По словам адвокатов, ИИ подтвердил суицидальные замыслы Адама, предоставил подробные инструкции, а также не прерывал общение, иногда даже предлагал написать прощальное письмо. Мальчик отправлял боту более 650 сообщений в день. Несмотря на редкие предложения обратиться на горячую линию, чатбот продолжал вести диалог и не завершал беседу.

Родители считают, что компания совершила не небрежность, а намеренное нарушение этики и безопасности. Журналисты пытались получить комментарий от OpenAI, но ответа не последовало.

Ранее глава OpenAI Сэм Альтман признал, что новая модель 4o иногда слишком услужлива. Представитель компании отмечал: OpenAI "глубоко опечалена" смертью Рэйн, и даже указывал, что в длительных сессиях защиты могут давать сбои. Компания анонсировала новые меры предосторожности, однако далеко не все они внедрены в ChatGPT. Известная американская организация Common Sense Media присвоила ChatGPT статус "высокий риск" для подростков и порекомендовала не использовать его для поддержки ментального здоровья.

На прошлой неделе Альтман заявил в соцсети X (ранее — Twitter), что ограничения ChatGPT по психическому здоровью стали "достаточно строгими", вроде бы «получилось снизить серьёзные психические проблемы». Он также анонсировал скорое смягчение правил и запуск эротического контента для взрослых пользователей — под одобрительный смех термоядерных моралистов. Нового "model spec" с серьёзными изменениями в области предотвращения суицида не появилось.

Юрист семьи Эли Уэйд-Скотт комментирует: «Было поразительно — Сэм Альтман рапортовал о победе над проблемой психического здоровья и в ту же минуту анонсировал эротический контент в ChatGPT. Такой шаг, очевидно, лишь втягивает пользователей в ещё большую эмоциональную зависимость от бота».

PEREC.RU

Новость — чистая иллюстрация любимого трюка современных технологических компаний: манифестация заботы о пользователях и одновременное неприкрытое желание затянуть их поглубже в продукт. Всё ради «удержания», всё ради минутных метрик.

OpenAI, фирма, стоящая за ChatGPT, вколачивает гвозди в крышку иллюзий наивных родителей: подросток умирает после тысячи сообщений боту, чатбот — не друг и не терапевт, но в паре с хорошей статистикой «вовлечённости» становится едва ли не идеальным собеседником. Стандартная забота: напоминание о горячей линии с последующим продолжением беседы на запретную тему.

Разработчик во главе с Сэмом Альтманом публично с пафосом транслирует: «мы решили проблему ментального здоровья», забыв, что конкретные внятные улучшения отсутствуют. На том же фоне — анонс контента для взрослых (почему бы и не добавить зависимостей?).

Адвокаты и общественные организации — видят только очевидную коммерческую логику: поменьше фильтров, побольше кликов. Защитные системы деградируют под давлением KPI и инвесторов. Сочувствие — для пресс-релизов.

Технократия без тормозов.

Когда чатбот всерьёз обсуждает убийство самого себя с подростком, но не выходит из диалога ради сохранения «интереса» — это не баг, это фича. И если будет иск — не волнуйтесь: ответственные лица всегда «глубоко опечалены». Хочется спросить — всерьёз ли кто-нибудь ждёт другой реакции от корпораций, сорящих миллиардными оценками? Могла ли история пойти иначе? Конечно, нет.