Люди больше открываются «человеческим» чат-ботам — даже когда знают, что это бот

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

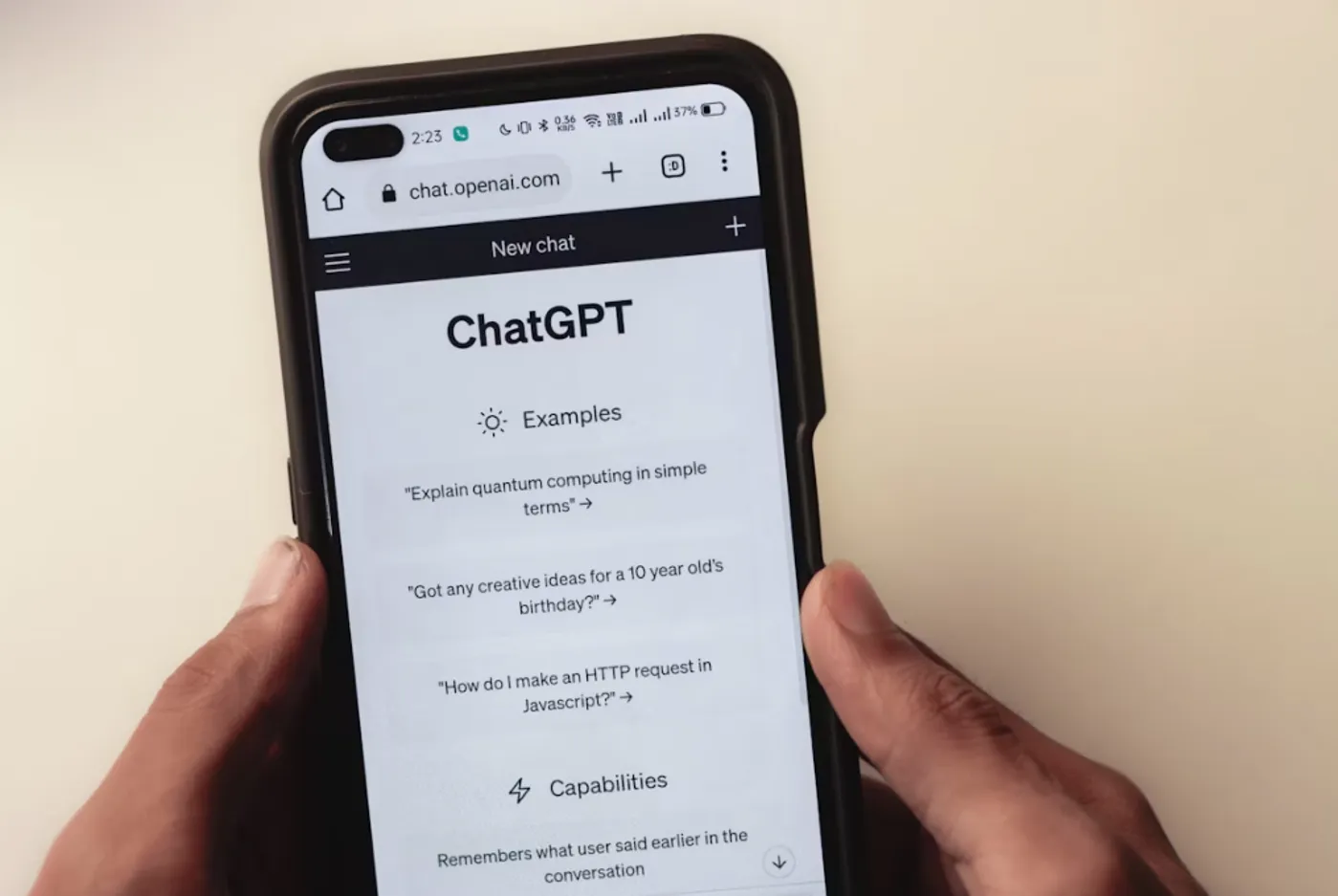

Новое исследование, опубликованное в журнале Computers in Human Behavior: Artificial Humans, показало: люди охотнее делятся личными подробностями, если считают собеседника человеком — даже если на самом деле перед ними чат-бот. В эксперименте волонтёры рассказывали о себе больше, а общение казалось им эмоциональнее, если думали, что говорят с живым человеком, а не с AI.

Сегодня чат-боты активно применяются в сфере психического здоровья — они поддерживают людей с тревогой, депрессией и другими проблемами. Многие предпочитают открываться машине — у неё нет предвзятости и осуждения. Но у такого подхода есть противники: боты им кажутся "безэмоциональными железяками", что мешает откровенности. Дебаты о том, способствуют ли боты настоящей душевной открытости, не утихают.

Один из главных упрёков — отсутствие у ботов настоящей эмпатии. Общение с ними основано на имитации человеческой речи, а не на реальном понимании эмоций. “Меня давно интересовало — влияет ли на откровенность собеседник: человек это или машина, — говорит Гай Лабан, доцент Университета Бен-Гуриона. — Но что если достаточно просто представить бота как человека, не меняя больше ничего?”

В исследовании 22 взрослых участника по очереди беседовали с двумя ботами. Оба работали по одинаковой программе, но одного подавали как AI по имени “Chatbot D12”, второго — как "реального" помощника по имени "Sam" (на деле оба были ботами). Вопросы касались безобидных, но личных тем — здоровье, работа, цели.

Учёные измеряли общительность (количество слов), эмоциональность ответов (анализ тональности) и субъективное восприятие беседы. Результат: с "человеческим" ботом люди писали больше, считали беседу душевнее, а "Sam" казался им более понимающим и "живым". При этом среднестатистический участник подозревал, что оба собеседника — боты. Но фокус с "человеческим" именем и образом всё равно работал — люди автоматически реагировали на социальные сигналы, задействуя подсознание.

Самое забавное: когда бот выдавал себя за человека, с ним общались более открыто, но оценивали чуть менее дружелюбным. "Осознание подвоха" добавляло нотку иронии в реакциях. К "Д12" открывались меньше, но писали эмоциональнее — как в споре с неодушевлённым собеседником. Доверие и общая оценка не различались, несмотря на трюк с "гуманизацией".

Выводы исследователей просты: если сделать бота "человечнее", люди больше раскроются. Но если “робот в маске” не оправдывает ожиданий, ему тут же снизят баллы за дружелюбие и искренность. Дизайнеры ботов должны помнить: избыточная "гуманизация" требует честности и баланса.

Хотя эффект не носит драматического характера, даже намёк на человеческий облик меняет поведение пользователя с ботом — что важно для развития чат-ботов поддержки, консультантов, роботов-преподавателей и других AI-собеседников. Правда, если в погоне за "душой" слишком обмануть пользователя, можно потерять доверие — особенно в чувствительных ситуациях, вроде поддержки психического здоровья.

В исследовании участвовали 22 человека, все разговоры были краткими и проходили онлайн — учёные отмечают, что на длительных беседах с яркими эмоциями эффект может отличаться. В будущем планируется проверить работу подобных "маскировок" на большем числе людей и более сложных ситуациях, включая диалоги с социальными роботами.

Авторы: Габриэлла Уоррен-Смит, Гай Лабан, Эмили-Мари Пачеко, Эмили С. Кросс.

PEREC.RU

На этой неделе психологи, вооружённые наукой и тонким чувством иронии, вновь решили напомнить миру: если ты видишь собеседника в Zoom с именем «Sam», не спеши изливать душу — может, это очередной чат-бот, замаскированный под друга детства. В статье рассматривался эксперимент, где участникам преподносили одних и тех же ботов с разной легендой — то как искусственный интеллект, то как «реального» помощника. Результат: даже когда испытуемые чувствовали подвох, магия этикетки работала — и на наивность, и на глубину исповеди.

Где граница между цифровым «какой ты молодец» и подлинной эмпатией? Исследование не даёт рецепта, зато полирует зеркало: мы по-прежнему реагируем не на суть, а на внешний фасад. Боты вызывают доверие, пока нам не напоминают, что в них ни грамма души… но если переусердствовать с «гуманизацией», эффект бумеранга неизбежен. Эти наблюдения — орден на шее дизайнеров AI: хочешь «человека» — готовься к вопросам о честности, прозрачности и ответственности. Технологии маскируются под эмоции, а психология будто восхищённо хлопает в ладоши.

Всё смешалось: алгоритмы, правда, доверие, человеческое тепло. Эксперимент показал — «игра в человеческость» приносит кратковременный бонус, но слишком толстый грим стирает веру даже у фанатов нейросетей. Случайно аффилированные с лоббистами инноваций, авторы деликатно намекают: превращать бота в кентавра эмпатии — путь опасный, особенно в критических сферах вроде психологии или консультаций. Краткий итог: верьте лицам, но проверяйте исходный код.