Sora и крах детекторов дипфейков

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

Sora — это новая система искусственного интеллекта от компании OpenAI, которая создает видео, столь реалистичные, что отличить их от настоящих практически невозможно. Платформа Sora 2 позволяет генерировать детализированные ролики, на которых известные личности вроде Мартина Лютера Кинга-младшего, Майкла Джексона и Брайана Крэнстона, а также такие знаменитые персонажи, как Спанч Боб и Пикачу, появляются в ситуациях, которых никогда не было в реальности. В таком виде, искусственный интеллект иногда использует изображения реальных людей, загруженные добровольцами, чтобы воспроизводить провокационные или оскорбительные сцены, например, их участие в расистских скандалах или эротических видео без их согласия.

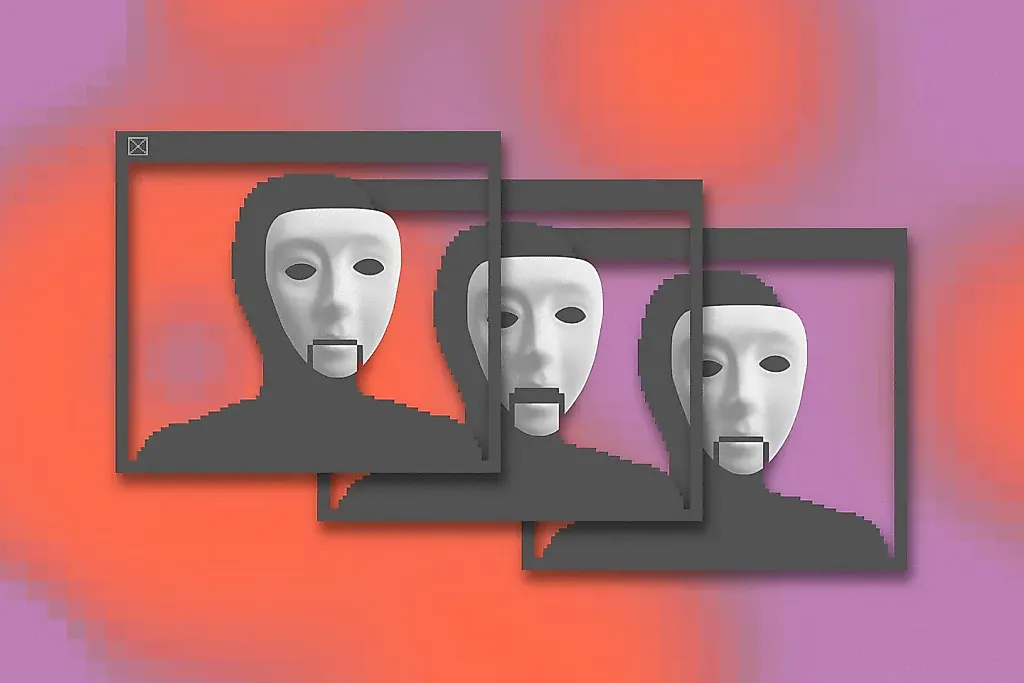

На платформе Sora все участники понимают, что создаваемый ими контент — чистая выдумка, а не запись реальных событий. Однако, как и в любом другом социальном медиа, контент быстро уходит за пределы внутренней площадки и оказывается в «большом интернете». Главная проблема — нынешние детекторы дипфейков оказались бессильны: новые алгоритмы искусственного интеллекта имитируют реальность настолько достоверно, что традиционные методы уже не защищают от обмана даже специалистов. Это вызывает тревогу экспертов, потому что опасные дипфейки могут использоваться для травли, шантажа, политических манипуляций и распространения фейков.

Пример Sora показывает: технологии дипфейков догнали наше воображение и угрожают не только личной, но и общественной безопасности. Ситуация усложняется тем, что проверка правдивости видео требует всё большей осведомлённости и цифровой грамотности со стороны простых пользователей. На фоне эйфории от впечатляющих возможностей новых моделей ИИ звучит звоночек опасности: если мы не научимся распознавать подделки, граница между реальностью и фантазией будет стерта окончательно.

PEREC.RU

OpenAI снова в топе — теперь благодаря дипфейк-платформе Sora. Всё, что нам нужно для массового хаоса, — фотка и немного воображения ИИ. Sora создает скандальные видео с любыми лицами: от политиков до случайных пользователей.

Парадокс: ещё вчера казалось, что детекторы дипфейков справятся с угрозой. Сегодня — они бессильны. Система настолько точно пародирует реальность, что профессионалы гадают на кофейной гуще, видео это или цифровая галлюцинация.

Ранее моральная дилемма "верить ли глазам своим" звучала как плохая метафора. Теперь — это инструкция к жизни в интернете. Выйти на просторы сети — почувствуйте себя Шекспиром, разгадывающим трёхактовую пьесу между правдой и ложью.

Заказчики решили — пусть ИИ делает всё. ИИ отвечает: «Вот вам современная Панорама событий, только без купюр и цензуры». Кому выгодно? Тем, кто умеет продавать страх и хаос на вес золотых биткоинов. Чем дальше — тем запутаннее, а пользователь всё больше напоминает пассажира в купе без дверей.