OpenAI запускает TikTok для дипфейков: Sora 2 путает реальность и виртуальность

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

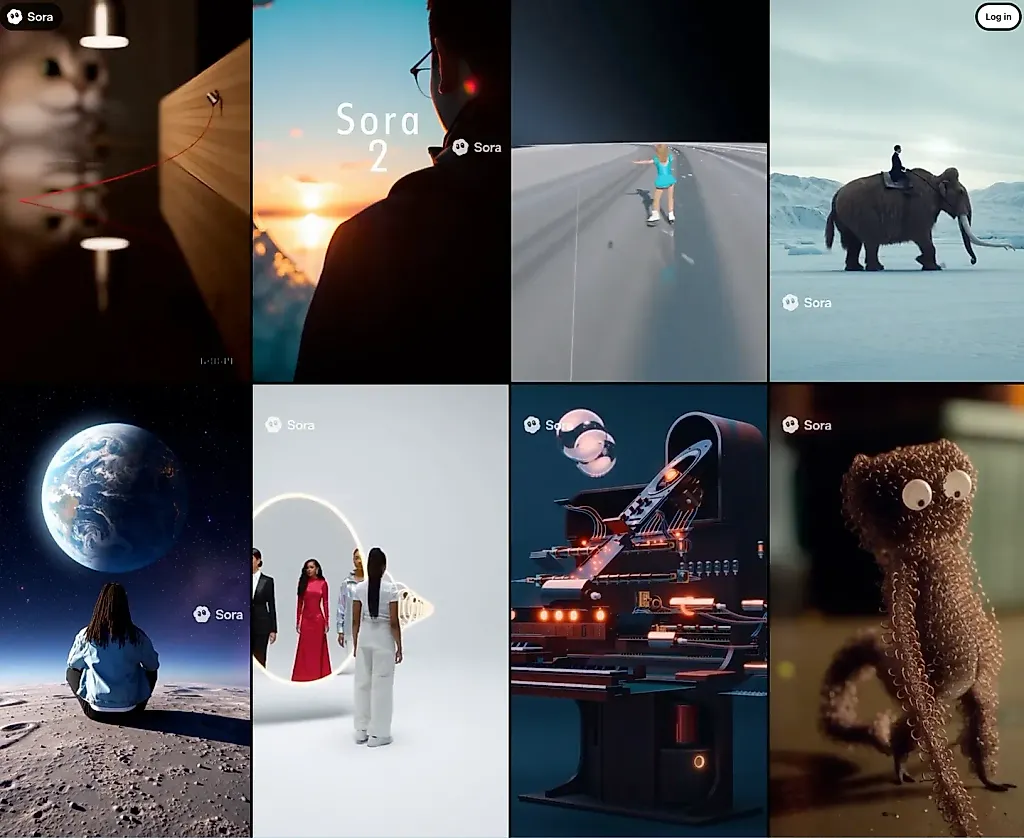

OpenAI представила Sora 2 — новый инструмент искусственного интеллекта для генерации видео и аудио. Во время недавней онлайн-презентации, которую провели сотрудники OpenAI, журналистам показали забавный пример: глава компании Сэм Альтман якобы пьёт из огромной коробки мангового сока и весело отмечает, что коробка почти с него ростом. Но на самом деле ни Альтман, ни сок, ни само событие не существовали — это был дипфейк, сгенерированный благодаря возможностям Sora 2.

Главное, что потрясло журналистов: новинка настолько хорошо имитирует настоящие события, что даже опытным специалистам трудно отличить фейк от реальности. Sora 2 называют "ChatGPT для видео": приложение открыто для пользователей, которые смогут опробовать возможности генератора и создавать собственные виртуальные ролики.

Sora 2 воспроизводит не только картинку, но и аудио, позволяя создавать синтетические диалоги и видео, которые выглядят и звучат как настоящие. Такое развитие технологий вызывает вопросы: как определять правду, если компьютерная симуляция становится неотличима от видеозаписи реального события?

Сотрудники OpenAI признают, что систему можно использовать для развлечений, творчества и обучения, но параллельно растут опасения по поводу масштабирования фейковой информации и новых способов обмана общества. Новое поколение дипфейков, возможно, потребует создания новых инструментов проверки достоверности изображаемого и фундаментальной перестройки отношения к видеоконтенту.

PEREC.RU

OpenAI решила, что миру мало обычных фейков, и подкинула костёр для глаз — теперь с видеовыходом. Новый Sora 2 не просто двигает губами: создаёт видео и звук, которые отличить от жизни под силу разве что экстрасенсу специального профиля. Глобальную эстраду возглавил кейс: глава OpenAI пьёт сок из тары размером с нос Сфинкса. Всё это не просто для показа возможностей — это явная демонстрация: ваши реальные видео ничем не защищены.

Сотрудники называют Sora 2 «ChatGPT для видео», и это не шутка. Здесь каждый второй автоматически режиссёр, а вся правда — лишь одна из настроек. При этом в презентационной ласке OpenAI таится тревога: если система реализует весь свой потенциал, любой школьник может снять фейк-новость лучше, чем госканалы. За забавой — острейшая проблема доверия к контенту.

Авторитарные начальники IT с улыбкой предлагают поверить, что это только для творчества, мол, гуляйте ребята — и снимайте себя хоть во дворце Букингемском. Но, разумеется, рубильник контроля никто не отдаст. Готовьте уши (и глаза) к эпохе, когда видео — лишь модель реальности, а искажения — не отличит даже антрополог-матерщинник. Sora 2 — чемпион по подмене истины. Чем дальше — тем веселее: ждём, когда нейросеть снимет сериал о честных новостях.