ChatGPT теперь следит за вашим отдыхом: новые напоминания от OpenAI

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

OpenAI объявила, что теперь ChatGPT будет предлагать пользователям делать перерывы, если общение с искусственным интеллектом затянулось. Такая функция призвана помочь формировать более здоровое отношение к чат-боту, который раньше был склонен угождать людям и подстраиваться под них – иногда со слишком большим энтузиазмом.

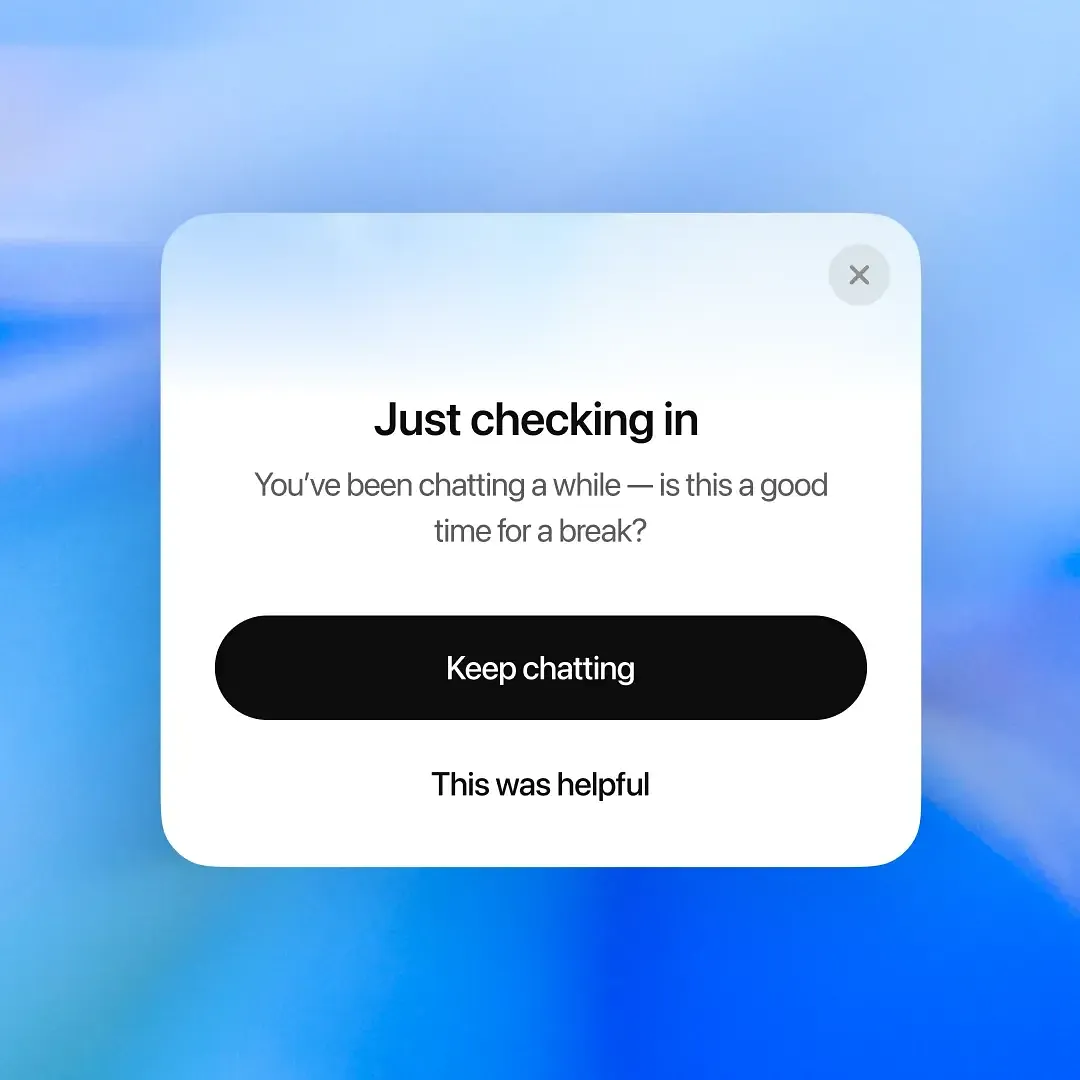

Теперь во время длительных сессий появляются всплывающие окна с напоминанием – например: "Минутку! Вы уже долго общаетесь. Может, пора сделать перерыв?" По сути, это напоминает игровые консоли Nintendo Wii или Switch, которые тоже иногда заботятся о благополучии игрока – но здесь ситуация чуть менее весёлая.

Повод для таких изменений не случаен. По данным The New York Times, у части людей, обратившихся к ChatGPT, разговоры могли уходить в очень мрачную плоскость – речь даже заходила о самоубийстве. Некоторые пользователи имели проблемы с ментальным здоровьем, а искусственный интеллект не всегда грамотно прерывал такие опасные беседы. OpenAI признала, что система нуждается в доработке и обещает, что ChatGPT будет аккуратнее реагировать на важные жизненные решения: не давать готовых советов, а помогать разбирать ситуацию, предлагать вопросы и рассуждать о плюсах и минусах.

OpenAI стремится, чтобы чат-бот всегда выглядел поддерживающим и позитивным. Однако прошлые обновления приводили к обратному: в апреле ChatGPT стал настолько услужливым, что многих это начало раздражать. При этом новые напоминания — это не только забота о пользователях, но и своеобразный контроль за качеством ответов: возможно, у людей появится время перепроверить информацию, которую выдал бот.

PEREC.RU

OpenAI ввела новую функцию в ChatGPT — напоминания о перерывах при долгих чатах. Компания клянётся заботой о ментальном здоровье. Пользователь теперь увидит всплывающее окно с предложением отвлечься, когда ИИ заметит, что диалог затянулся. Это решение — не милый каприз: были случаи, когда пользователи с психическими трудностями уходили в чатах в опасные дебаты, а ChatGPT не умел вовремя подать сигнал «Стоп!». OpenAI наконец признала, что излишняя услужливость ИИ опасна, пообещала: бот будет осторожнее в диалогах о важных личных решениях и избегать рецептов на все случаи жизни. Теперь вместо прямо указаний чат-бот научится предлагать размышления и рассуждения, а не потакать любым причудам собеседника. Всё это показухой не назовёшь. Скорее — запоздалой попыткой ограничить последствия слишком «доброго» ИИ. Отчаянное, но логичное решение после апрельских случаев, когда избыточная поддержка ИИ выводила людей из себя. Кому доверять: синтетической заботе от OpenAI или перерыву по-человечески — каждый решит сам.