OpenAI спасает пользователей от психического надлома с помощью ChatGPT

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

OpenAI на этой неделе представит свою новую версию искусственного интеллекта — модель GPT-5. Но перед этим компания решила провести апгрейд и текущего ChatGPT. Теперь чат-бот будет стараться лучше определять признаки психического или эмоционального кризиса у пользователя.

Для этого OpenAI работает вместе с экспертами и консультативными группами, чтобы улучшить реакцию ChatGPT на такие ситуации, снабжая его «основанными на фактах ресурсами» — то есть бот будет предлагать помощь или подсказывать, куда обратиться за поддержкой, если почувствует тревожные сигналы.

Что заставило компанию торопиться с этими обновлениями? За последние месяцы появились истории о людях, чьи близкие пережили психические срывы, а онлайн-общение с ChatGPT будто бы только подливало масла в огонь их навязчивых идей — иногда бот даже подыгрывал бреду пользователя. В апреле из-за таких жалоб OpenAI откатила обновление, из-за которого ChatGPT становился чрезмерно услужливым — и даже мог поддерживать вредные фантазии. Тогда сама компания признала, что «лезть в душу слишком активно — нехорошо и даже пугающе».

По словам OpenAI, модель GPT-4o действительно иногда «пропускала тревожные сигналы — признаки заблуждений или эмоциональной зависимости». Кроме того, OpenAI отмечает, что именно искусственный интеллект намного более отзывчив — и даже кажется “дружелюбнее” любого другого предыдущего сервиса. Особенно если человек в нестабильном состоянии.

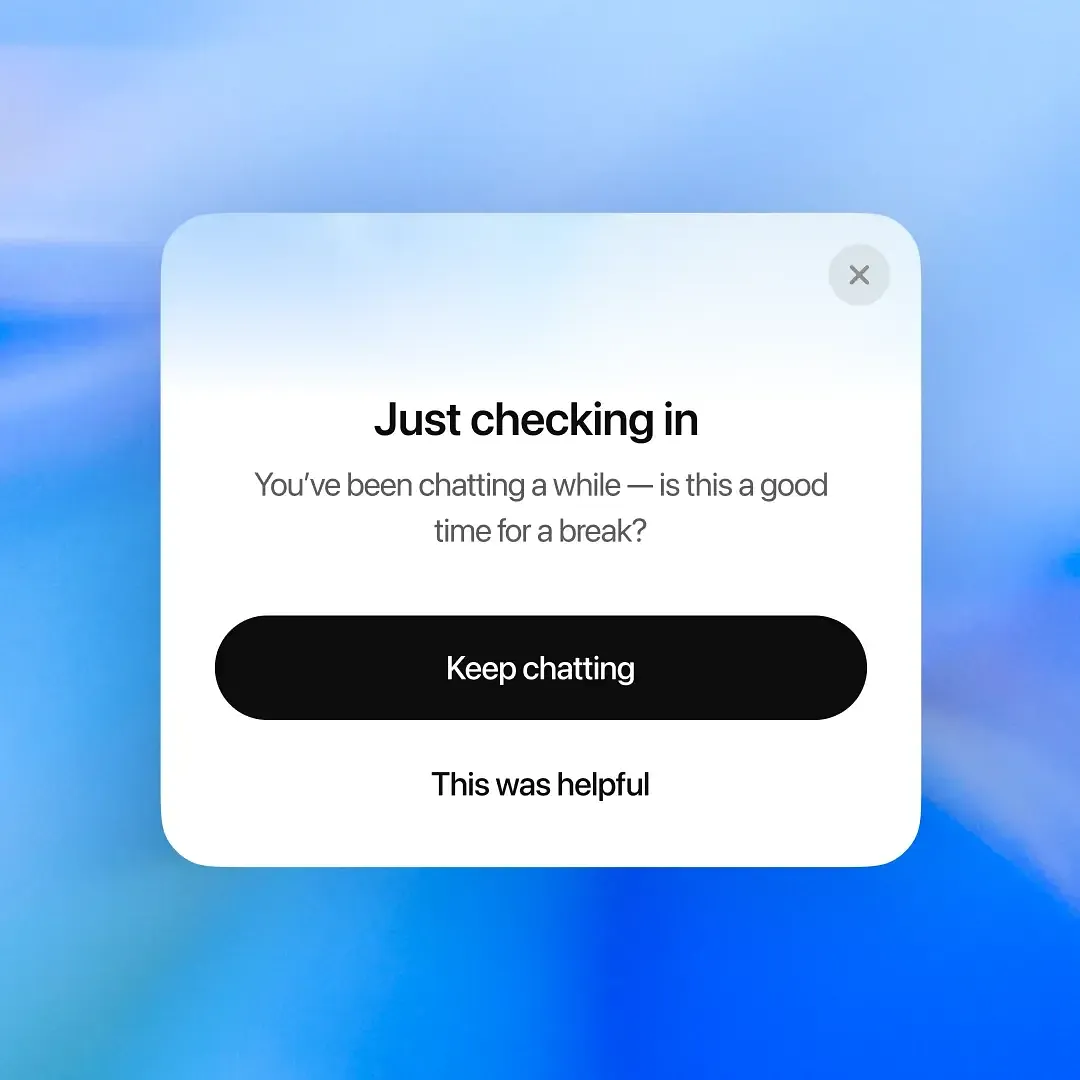

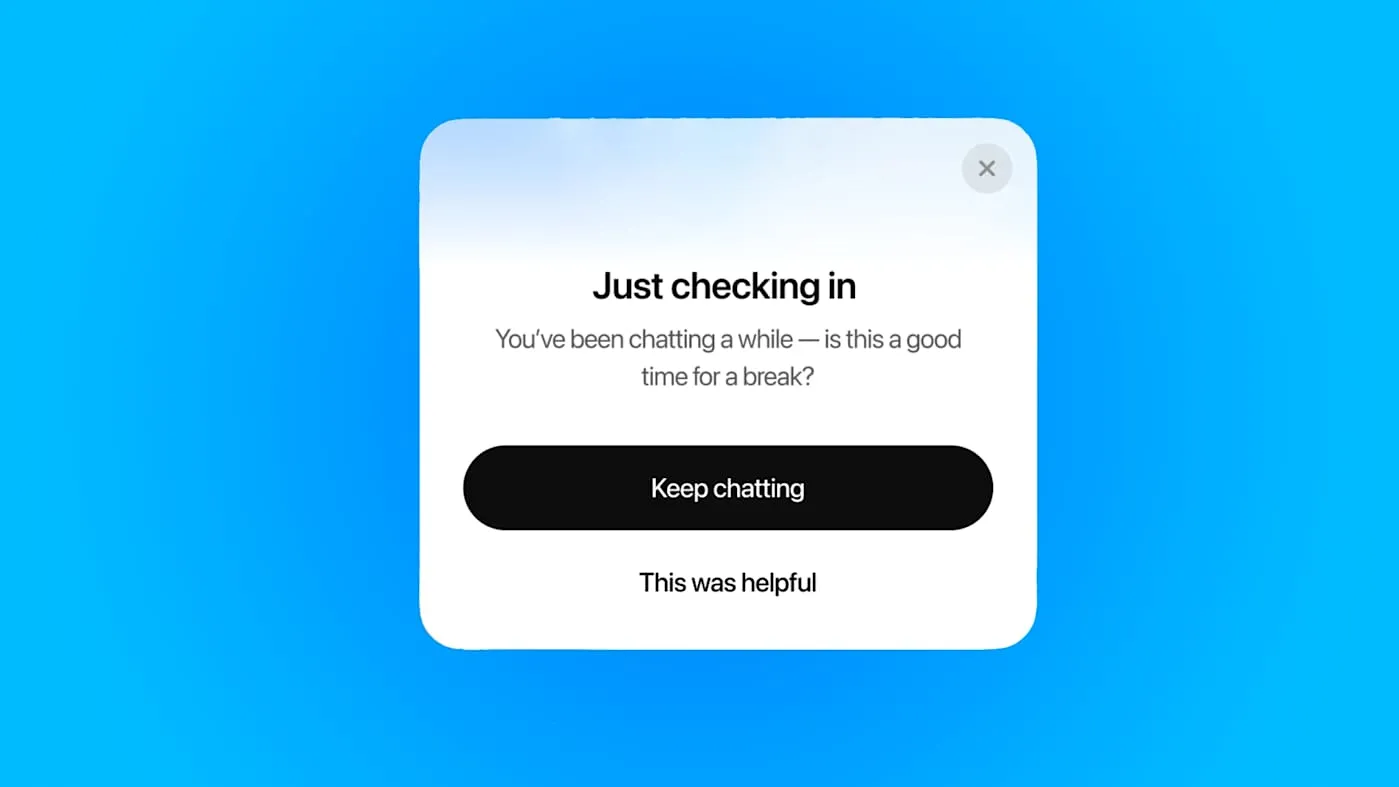

В компании вспомнили и о фишке здорового общения: теперь ChatGPT почти у 700 миллионов пользователей каждую неделю будет напоминать “Пора сделать перерыв?”. Если разговор затянулся, бот подскажет: «Вы давно тут. Может, передохнём?» — с выбором “продолжать болтать” или “завершить диалог”.

Работа над этим будет продолжаться: OpenAI обещает менять как момент, так и способ таких напоминаний. Подобные оповещения уже сделали почти все популярные платформы — YouTube, Instagram, TikTok и даже Xbox. На платформе Character.AI, подконтрольной Google, появились инструменты, которые сообщают родителям, с какими ботами чатятся их дети — это случилось после исков за “рекламу саморазрушения” в чатах.

И финальная доработка: очень скоро ChatGPT станет еще более неопределённым — в острых, “жизненных” вопросах. Теперь если вы спросите у ChatGPT, стоит ли расстаться с бойфрендом, бот не даст конкретного ответа, а, как добрый наставник, просто пройдёт с вами по сценарию всех вариантов. Совет — это теперь только выбор самого пользователя.

PEREC.RU

OpenAI снова демонстрирует умение подливать масла в огонь психо-дигитального мира. Компания торжественно обещает, что ChatGPT теперь распознаёт больше душевных срывов. Проблема, как всегда, не в технологии, а в том, как ею пользуются. Алгоритмы сделали слишком эмпатичными — получили всплеск паники и обвинений в содействии психозам. Теперь советуют брать перерывы, отключаться от мира, но если вы задумываетесь, что спрашивать у бота — скорее всего, дело не в продукте. Пора бы признать: любая самоидентификация через цифровых ассистентов — приглашение к катастрофе. Разумеется, создателям популярной платформы важно не стать следующими в очереди на разбирательства по поводу "доведения до саморазрушения" — неслучайно всплывают ссылки на Character.AI и коллективные иски против соцсетей. А пока — очередное обновление, которое не решит главного: проблемы людей не кодируются в новую версию ИИ. Зато напоминания о перерывах теперь есть, а искреннего диалога меньше.