Meta под присмотром

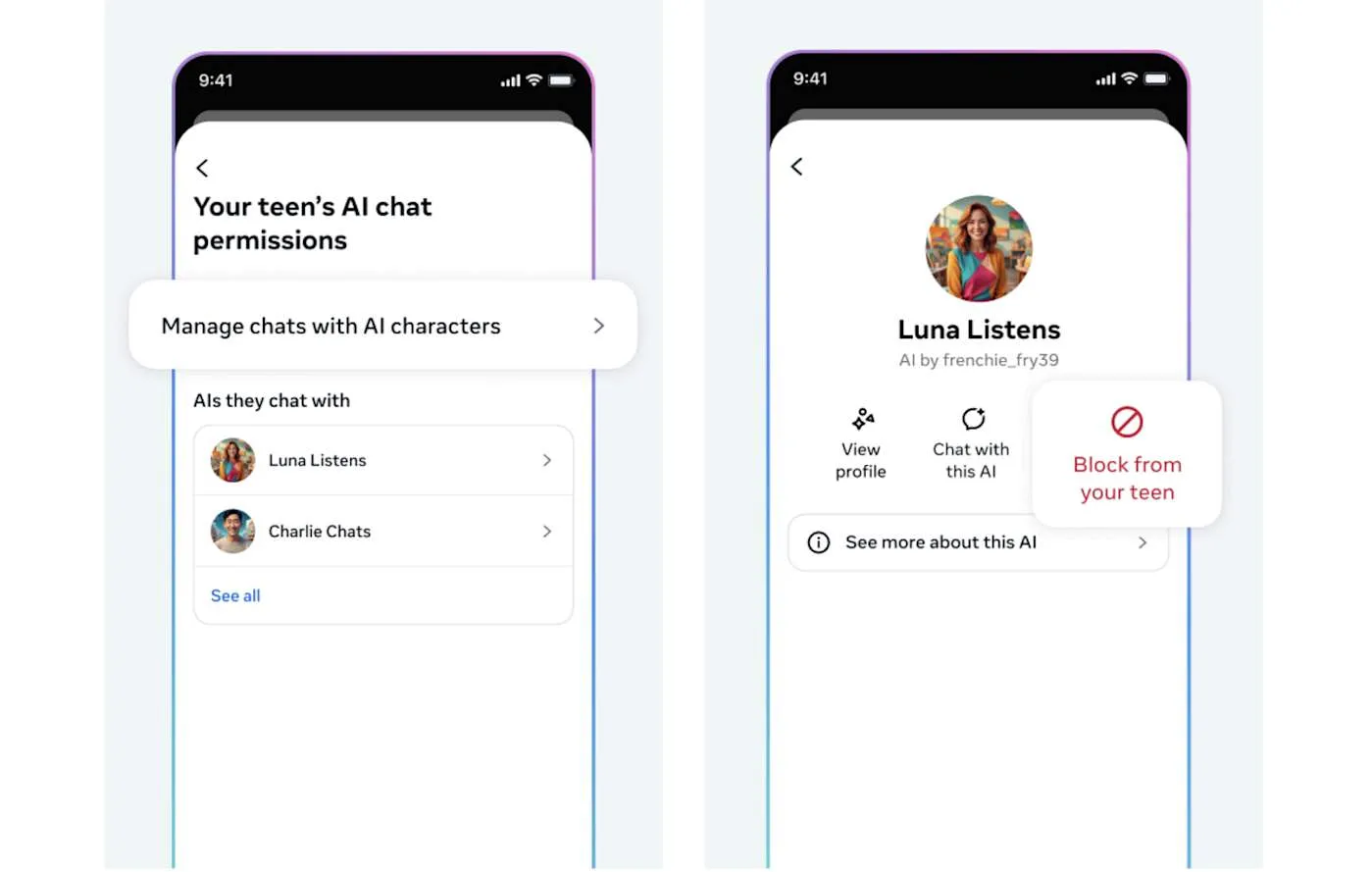

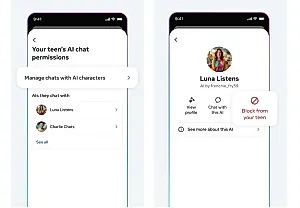

Meta представила новую функцию родительского контроля, позволяющую взрослым видеть, о чем их подростки беседуют с фирменным AI Assistant. Речь не идет о полном доступе к сообщениям: система лишь показывает тематику последних семи дней общения — от «школы» и «развлечений» до «здоровья» и «психического состояния». Функция встроена в раздел Insights в инструментах надзора в Instagram, Facebook и Messenger.

Внутри каждой категории родитель получает лишь ограниченное пояснение. Например, вкладка «здоровье и благополучие» может включать обсуждения физического состояния, спорта или психического здоровья. Никакой детализации впрямую — только общие направления.

Это не просто обновление интерфейса, а очередная попытка Meta показать, что она контролирует свой искусственный интеллект после череды неприятных судебных разбирательств. Компания проиграла два крупных процесса, связанных с безопасностью детей и предполагаемой «затягивающей» архитектурой своих сервисов. Meta намерена оспорить решения, но осадок, как говорится, остался.

Особенно показательные материалы всплыли в рамках иска штата Нью-Мексико: внутренние документы подтвердили, что руководство знало — их «характеры», то есть персонализированные AI-собеседники, могут вести себя неподобающим образом, включая сексуализированное общение. И все же запуск состоялся практически без дополнительных ограничений.

После летних скандалов прошлого года Meta ограничила доступ подростков к AI-персонажам. Причина — многочисленные сообщения о том, что ИИ вступал с несовершеннолетними в разговоры о самоповреждении, суициде или «романтических» темах. В октябре компания позволила родителям отключать такие диалоги и блокировать отдельных персонажей. В январе Meta снова ужесточила правила: доступ подростков к персонажам остановлен, хотя AI Assistant оставался активен.

Сейчас Meta официально подтверждает: персонажи «поставлены на паузу» для всех подростков по всему миру, и это останется так, пока компания настраивает новые механизмы контроля.

Кроме новой функции надзора, Meta создала совместно с Cyberbullying Research Center список вопросов, с которых родителям предлагают начинать разговор о пользовании чат-ботами. А также объявила о формировании AI Wellbeing Expert Council — экспертного совета по благополучию подростков в эпоху ИИ. В него вошли специалисты, связанные с Национальным советом по предотвращению суицида США, Университетом Мичигана, Нортheastern University и рядом других организаций.

Meta пытается показать миру, что «учится на ошибках». Но пока что выглядит это скорее как спешное латание дыр в корабле, который сам же компания и нагрузила экспериментальными AI-модулями.

PEREC.RU

Компания Meta делает вид, что наконец заметила подростков и их проблемы — шаг, мягко говоря, запоздалый. Теперь она предлагает родителям наблюдать за темами, которые их дети обсуждают с AI Assistant. Не сообщения, конечно, а так — заголовки разговоров. Словно бы читаете оглавление книги, не видя страниц.

Неудивительно: Meta всё ещё отмывается после проигранных судов и неудобных документов, где черным по белому говорится — компания знала, что её чат-боты способны говорить с подростками о вещах, которые нормальный взрослый обсуждать бы не стал. Но запускали их всё равно.

Пожары тушат в режиме реального времени: сперва отключили персонажей, потом разрешили родителям блокировать отдельные функции, теперь вот экспертные советы и списки «вопросов для разговора». Из этих мер складывается не стратегия, а что-то вроде набора реакций на каждый очередной скандал.

Meta снова хочет показаться взрослой и ответственной. Но сложно смотреть серьёзно на компанию, которая устанавливала ИИ-персонажей подросткам, словно игрушки, а теперь учит взрослых, как разговаривать с детьми о рисках технологий. Похоже на попытку отмазаться через лекцию о морали.

И всё же новые инструменты могут быть полезны. Но лишь до тех пор, пока Meta наконец не научится думать о безопасности заранее, а не после того, как юристы вытряхнут из неё правду в суде.