Нью‑Йорк против советов ИИ

Законодатели штата Нью‑Йорк всерьёз взялись за искусственный интеллект: они предлагают ограничить работу чатботов, чтобы те не давали юридических и медицинских советов. Повод простой и, увы, вполне банальный — растущие опасения, что люди принимают ответы алгоритмов за выводы специалистов, а это способно привести к ошибкам с реальными последствиями.

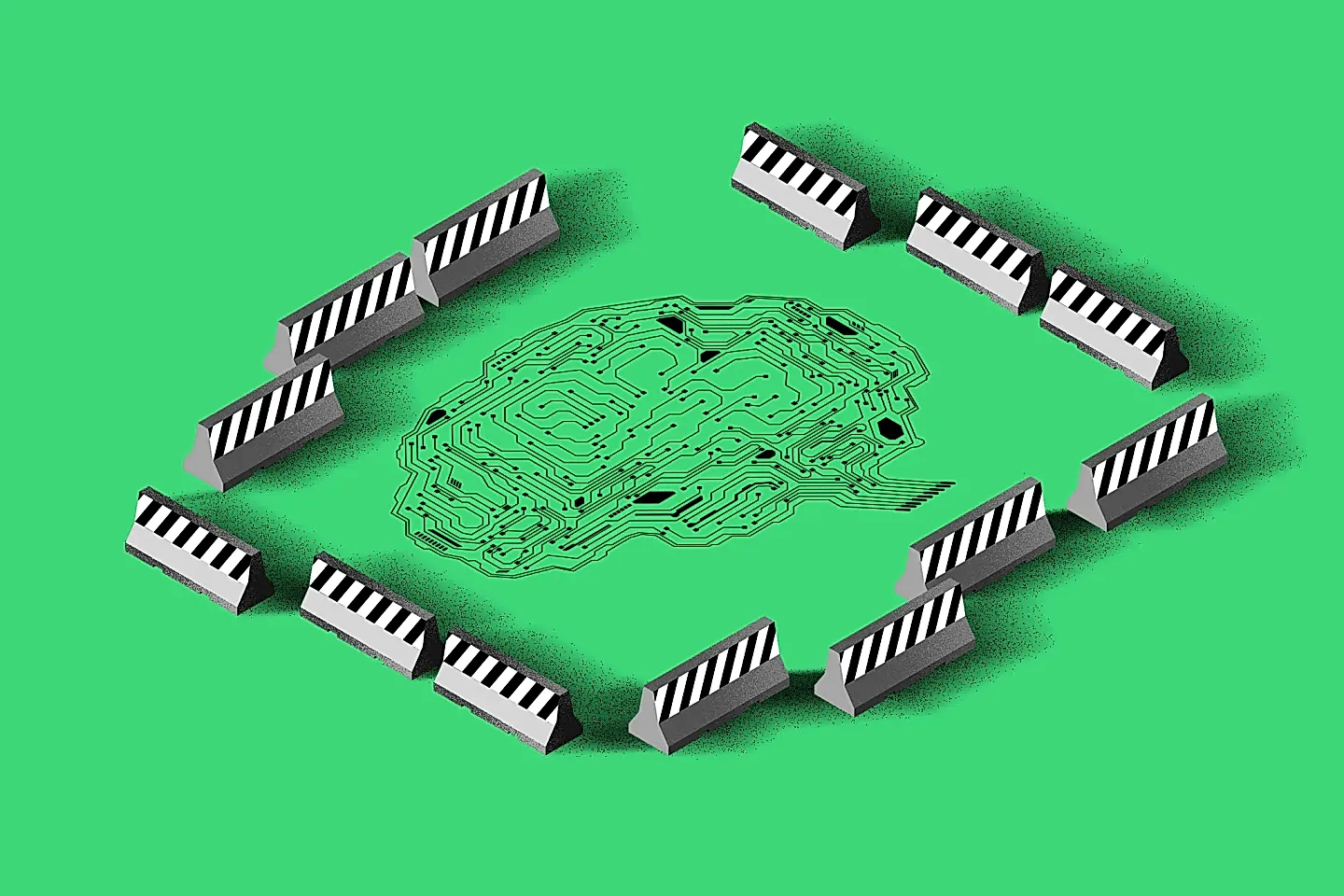

Пока что инициатива находится на рассмотрении, но общий замысел известен: любые цифровые помощники, использующие ИИ‑генерацию текста, должны будут чётко указывать, что они не являются лицензированными юристами или медиками. Более того, предлагается запретить им маскировать свою информацию под профессиональные консультации. То есть никаких «диагнозов» и «юридических оценок» — только общие сведения и рекомендации обращаться к реальным специалистам.

Это не попытка объявить войну технологиям — скорей попытка притормозить разогнавшийся поезд. В США уже были случаи, когда люди полагались на советы ИИ, принимая их за экспертные, и попадали в неприятные, а порой опасные ситуации. Законодатели уверяют: речь идёт о том, чтобы предотвратить путаницу между алгоритмическими ответами и профессиональной помощью.

Обсуждение продолжается, и пока что нет точных сроков принятия закона. Но тенденция очевидна: власти стараются очертить границы, в которых ИИ может взаимодействовать с общественно значимыми областями — особенно там, где ошибка может стоить слишком дорого.

PEREC.RU

Законодатели Нью‑Йорка решили ограничить чатботы, которые уверенно раздают медицинские и юридические советы. Формально — ради безопасности граждан. Неформально — чтобы люди не путали набор статистических предсказаний с компетенцией специалистов.

Инициатива проста: ИИ обязан честно сообщать, что он не врач и не юрист. А ещё — не выдавать свои ответы за профессиональные консультации. Такая мера выглядит логичной: жители стали воспринимать алгоритмическую речь как экспертную, и последствия уже приносили проблемы.

История напоминает попытку вернуть контроль над тем, что саморазвивается быстрее, чем успевает думать регулятор. ИИ стал говорить убедительно, и многие решили, что убедительность равна компетентности. Регуляторы делают шаг назад, будто просят время, чтобы разобраться, куда всё движется.

Разработчики ИИ действуют по логике «мы просто делаем технологию», пользователи — по логике «раз уж отвечает уверенно, значит знает». Законодатели пытаются закрыть дыру между двумя заблуждениями, пока она не стала пропастью.

Но за заботой о гражданах угадывается другая нота — страх потерять контроль над тем, что разговаривает лучше многих профессионалов. Слишком разговорчивый ИИ посягает на зоны, где долго царили лицензии и экспертность, и теперь требуется отвести его от этих территорий без лишнего шума. Возможно, это только первая попытка распределить полномочия между людьми и алгоритмами, пока последние не решили, что могут действовать сами по себе.