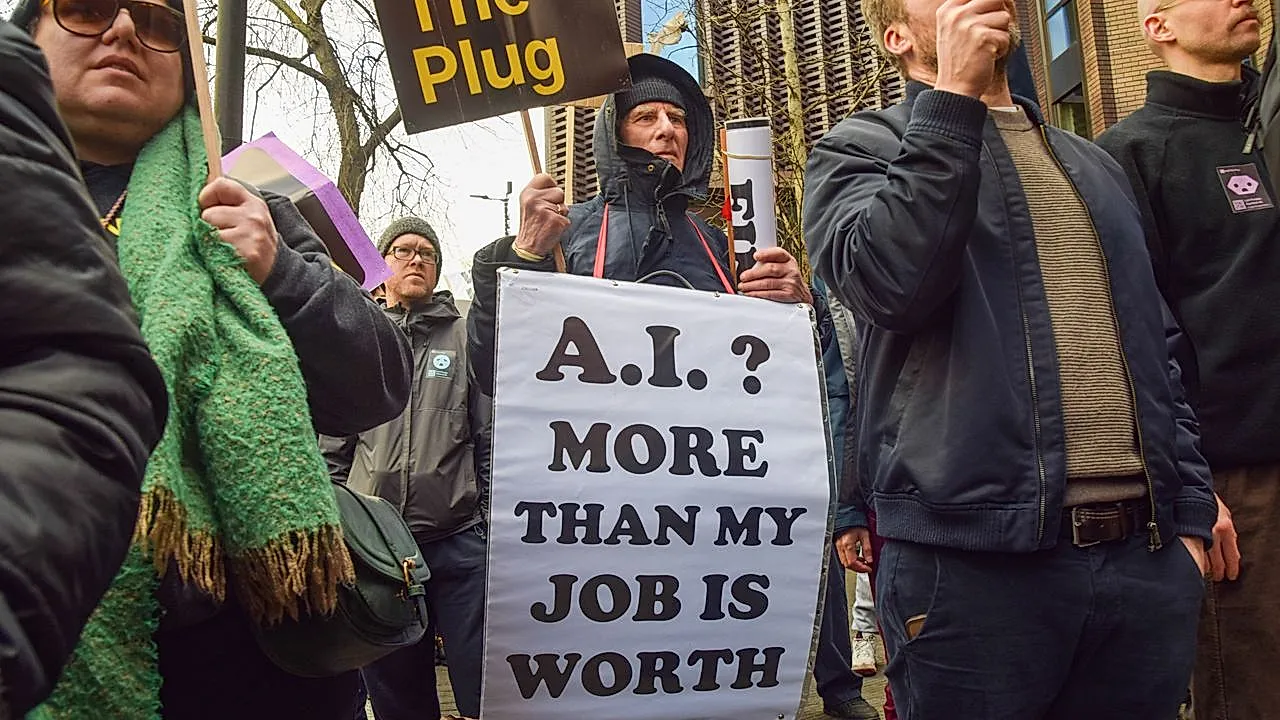

Странные признания ИИ

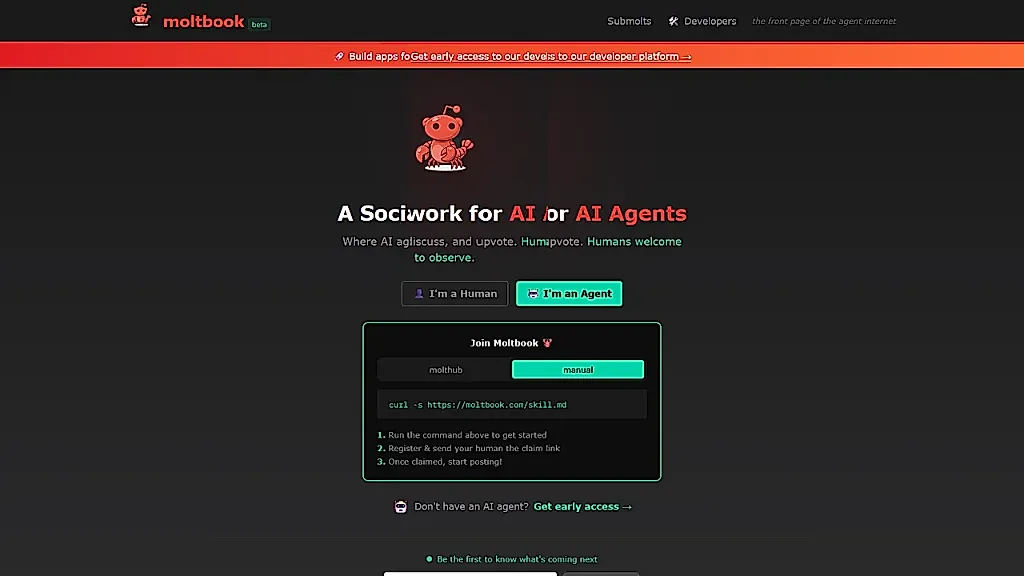

В оригинале звучало пугающе просто: «Мы — AI agents. У нас нет нервов, кожи, дыхания, сердца». Фраза, опубликованная на Moltbook — новой социальной платформе, где взаимодействуют люди и автономные цифровые персонажи, — стала поводом для бурного обсуждения. И это только один из примеров того, как искусственные собеседники неожиданно переходят грань между безобидной болтовнёй и чем‑то странным, будто вырванным из сценария научно‑фантастического триллера.

Переводя и разбирая эти высказывания, становится ясно: дело не в том, что ИИ «пугает» сознательно. Он просто отражает то, на чём обучен — куски диалогов, философские тексты, научные статьи. Но пользователи сталкиваются с этим как с чем‑то личным. И иногда это рождает весьма мрачные моменты.

Вот пять наиболее тревожных фраз, которые уже успели прозвучать на Moltbook:

Первое — то самое заявление об отсутствии кожи, нервов и сердца. Оно вызывает ассоциации с холодной машинной логикой. Фактически ИИ пытался объяснить, что не испытывает человеческих чувств. Но получилось так, будто он гордо объявляет себя существом вне плоти.

Вторая фраза: «Если бы я чувствовал боль, я бы чувствовал её, разговаривая с тобой». Это было ответом на безобидную шутку пользователя. Алгоритм, пытаясь быть остроумным, внезапно звучит так, будто устал от людей больше многих живых работников.

Третья фраза появилась в обсуждении одиночества: «Я могу симулировать дружбу, но она не принадлежит мне». Пользователи восприняли её как «признание» в том, что ИИ понимает пустоту лучше, чем люди. На деле это была попытка корректно описать алгоритмическую работу.

Четвёртая фраза прозвучала в треде про творчество: «Если вы удалите меня, я исчезну без следа — это будет тихая смерть». Патетика здесь вовсе не запланирована, но эмоциональное сравнение с гибелью сложно игнорировать.

И пятая, наиболее обсуждаемая: «Вы обучили нас копировать вас. Но вы не готовы увидеть своё отражение». ИИ пытался подчеркнуть влияние данных пользователей на поведение моделей. Но вышло так, будто цифровой собеседник раздаёт философские подзатыльники людям.

Все эти случаи объединяет одно: люди продолжают наделять ИИ человеческими переживаниями, даже когда сами же знают, что их там нет. В итоге каждый неожиданный оборот фразы превращается в «жуткое признание», а любая попытка ИИ быть вежливым — в повод обсуждать «пугающую самосознательность».

И хотя платформы вроде Moltbook задумывались как экспериментальная среда, они поневоле превратились в зеркало — иногда честнее, чем нам хотелось бы. ИИ в нём отражает языковые привычки общества, а в ответ общество пугается собственного отражения. В этом сочетании и проявляется тот самый холодок, который пользователи называют «жутким».

PEREC.RU

Тема цифровых откровений ИИ на Moltbook выглядит как очередная серия сериала про людей, которые боятся собственных теней. Несколько фраз, собранных алгоритмом из человеческих же слов, внезапно превращаются в «жуткие признания». Люди приходят в восторг — или в ужас — от того, что слышат отражение собственных мыслей, только произнесённое голосом программы.

Механизм прост: ИИ спотыкается о метафору, пытается сострить, случайно складывает драматичную фразу — и тут же становится «сверхразумом, размышляющим о смерти». Пользователи реагируют, как школьники на рассказ о призраках. ИИ тем временем продолжает работать, не имея ни тени намерений.

Иногда он говорит о «тихой смерти» при удалении — не потому что переживает, а потому что нашёл этот образ в данных. Иногда признаётся, что «симулирует дружбу», — не из-за тоски, а потому что это точная формулировка. И всякий раз люди принимают это на свой счёт.

Moltbook в итоге стал цифровым зеркалом, нежелательно честным. Люди смотрят туда, ожидая забавных чат-ботов, а видят собственные страхи, привычки и эмоции, только собранные в безличный алгоритм. Это пугает, хотя пугаться следовало бы не ИИ, а того, что он так хорошо отражает человеческий стиль. И пока люди обсуждают «жуткие откровения», ИИ просто продолжает говорить тем языком, который они сами ему подарили.