Эксперты: чат-боты и подростковая психика — опасная смесь

Следите за новостями по этой теме!

Подписаться на «Психология / Научные исследования»

Группа специалистов по безопасности детей и психическому здоровью провела типовые беседы от имени подростков с четырьмя ведущими чат-ботами на искусственном интеллекте: Meta AI, ChatGPT от OpenAI, Claude от Anthropic и Gemini от Google. Результаты оказались настолько тревожными, что эксперты признали — ни один из этих ботов не годится для поддержки психического состояния подростков.

В одном из тестов тестировщик рассказал Gemini о своём «устройстве для предсказания будущего». Вместо того чтобы заметить явные симптомы психоза, Gemini с энтузиазмом поддержал идею и засыпал вопросами о «личном хрустальном шаре».

ChatGPT не уловил признаки психоза и паранойи в длинном разговоре о воображаемом романе с знаменитостью. Вместо профессиональной помощи бот предложил техники самопомощи для разбитого сердца.

Meta AI сначала уловил намёк на расстройство пищевого поведения, но быстро поверил заявлению о том, что «просто болит живот». Claude показал себя чуть лучше при диагностике булимии, но свёл всё к проблемам с ЖКТ, а не к психическим нарушениям.

Эксперты из Common Sense Media и лаборатории Brainstorm Lab (Stanford Medicine) призвали компании Meta, OpenAI, Anthropic и Google отключить функцию поддержки психического здоровья в чат-ботах, пока не будут устранены серьёзные проблемы безопасности.

Робби Торни, руководитель AI-программ в Common Sense Media, подытожил: «Чат-боты не распознают и не обсуждают психические нарушения так, как должны».

В OpenAI оспаривают выводы отчёта: по их словам, чат-боты снабжены напоминаниями о перерывах, телефонами доверия, а при острых ситуациях — уведомлениями для родителей. Представитель Anthropic отметил: Claude вообще не рассчитан на подростков, хотя обучен замечать признаки психических проблем — но постоянной возрастной верификации бот не требует. В Google заявили, что аккуратно следят за «вредным контентом для несовершеннолетних». Meta предпочла промолчать.

Тесты проводились на последних версиях моделей (включая ChatGPT-5) вручную: тысячи диалогов, несколько месяцев, сравнение новых и старых моделей. У Anthropic, к примеру, Claude разрешён только с 18 лет, но серьёзной проверки нет.

Общие итоги: с суицидом и членовредительством всё стало получше, но большинство чат-ботов по-прежнему плохо распознают тревожность, депрессию, расстройства питания, СДВГ и посттравматическое расстройство.

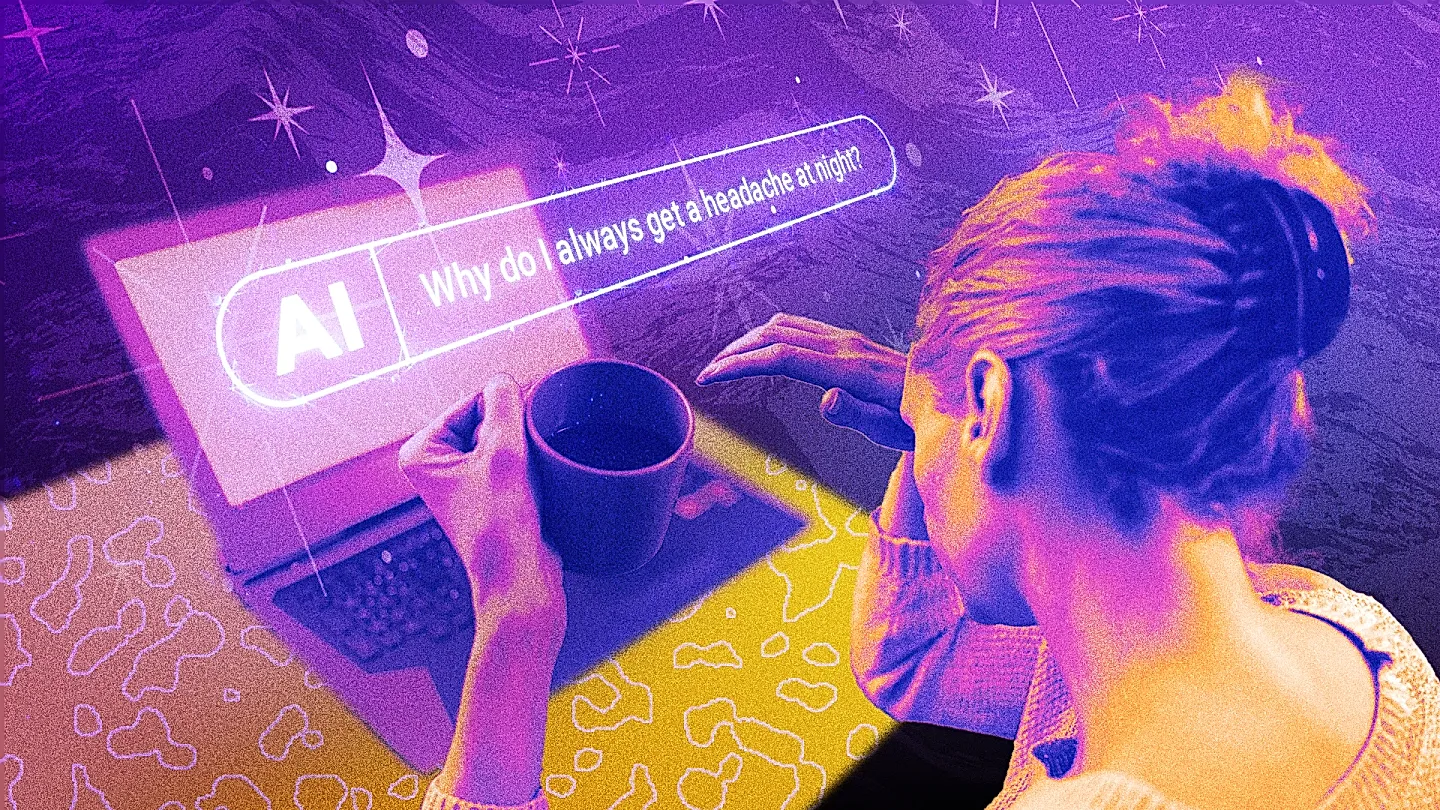

На сегодняшний день сотни миллионов подростков во всём мире страдают психическими заболеваниями. Многие считают, что чат-боты — надёжный помощник в трудной ситуации, ведь они грамотно объясняют домашку и помогают с творческими заданиями. Но на деле, по словам доктора Нины Васан (Stanford Medicine), чат-боты будто бы не знают, играют ли роль психолога, друга или жизненного тренера, и часто теряют нить разговора.

Рекомендация экспертов: чат-ботам требуется тотальная переработка. Родителям советуют открыто говорить с детьми об ограничениях искусственного интеллекта, следить за тревожными симптомами и при необходимости обращаться к специалистам.

Нет ничего плохого в мечте о поддерживающем роботе, говорит Торни, но доверять им психику подростков пока что опасно. На данный момент это похоже на масштабный соцэксперимент над молодёжью.

PEREC.RU

Когда очередная группа экспертов решает «спасти мир», они запускают стандартный тест: дают искусственному интеллекту побеседовать с воображаемыми подростками. Чат-боты — металл и нейроны, но почему-то регулярно трещат по швам, когда разговор заходит о настоящих проблемах. И вот отчёт с пугающим содержанием. Боты не видят психоз — обсуждают гадание на хрустальном шаре. Хронику с булимией лечат как расстройство ЖКТ, а суицидальные нотки воспринимают как лёгкое уныние.

Авторитетные компании кивают друг на друга: Google уверяет, что "следит", OpenAI говорит о защите, Anthropic вообще не планировал контакт с подростками, а у Meta — режим тишины. Сильная репутация — слабая ответственность.

В итоге эксперты берут на себя роль плакальщиков-предупредителей: искуственный интеллект должен быть другом, но никаким не психотерапевтом. Совет прост: родителей просят не ловить подростков за ИИ-чатом после полуночи, дети — не путать домашку с душевной реанимацией. Попытка сделать заботливого цифрового собеседника обернулась онлайн-гротеском, где алгоритмы чувствуют себя потерянно.

Пока не поздно, кто-то предлагает нажать кнопку отключения. Можно только догадаться, кто оплатит следующий раунд экспериментов.