Уязвимости в Claude Code

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

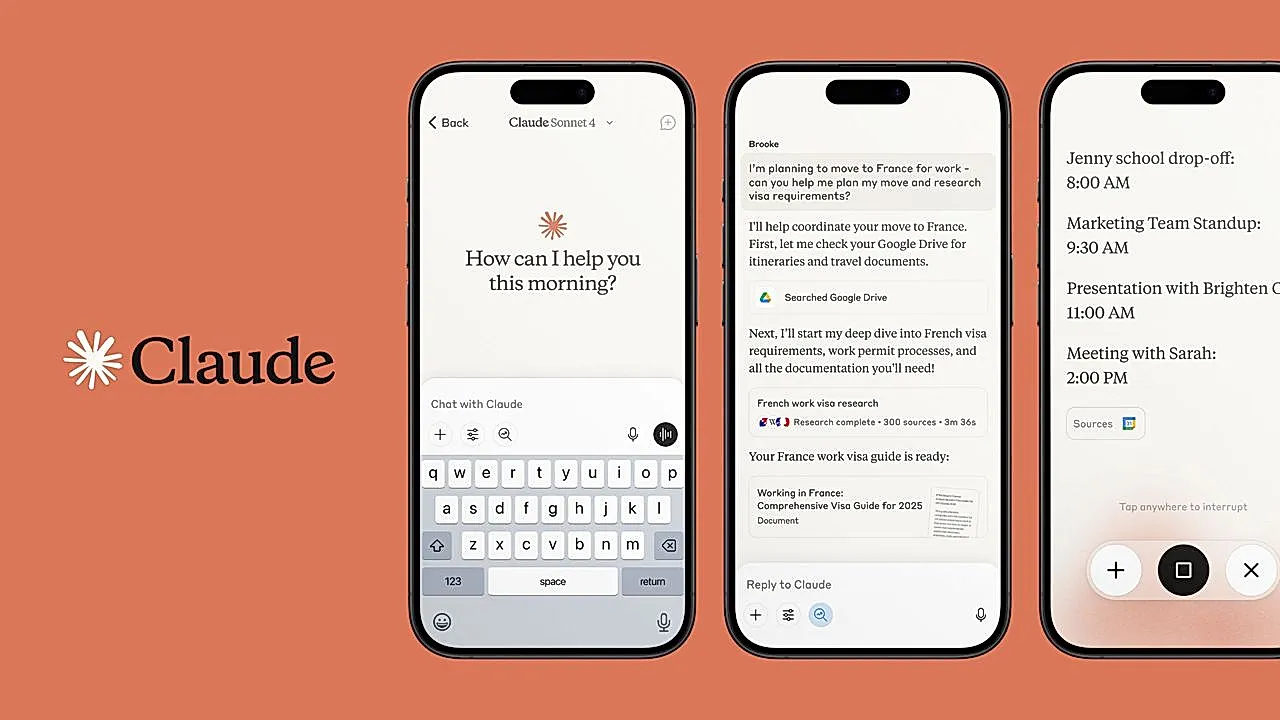

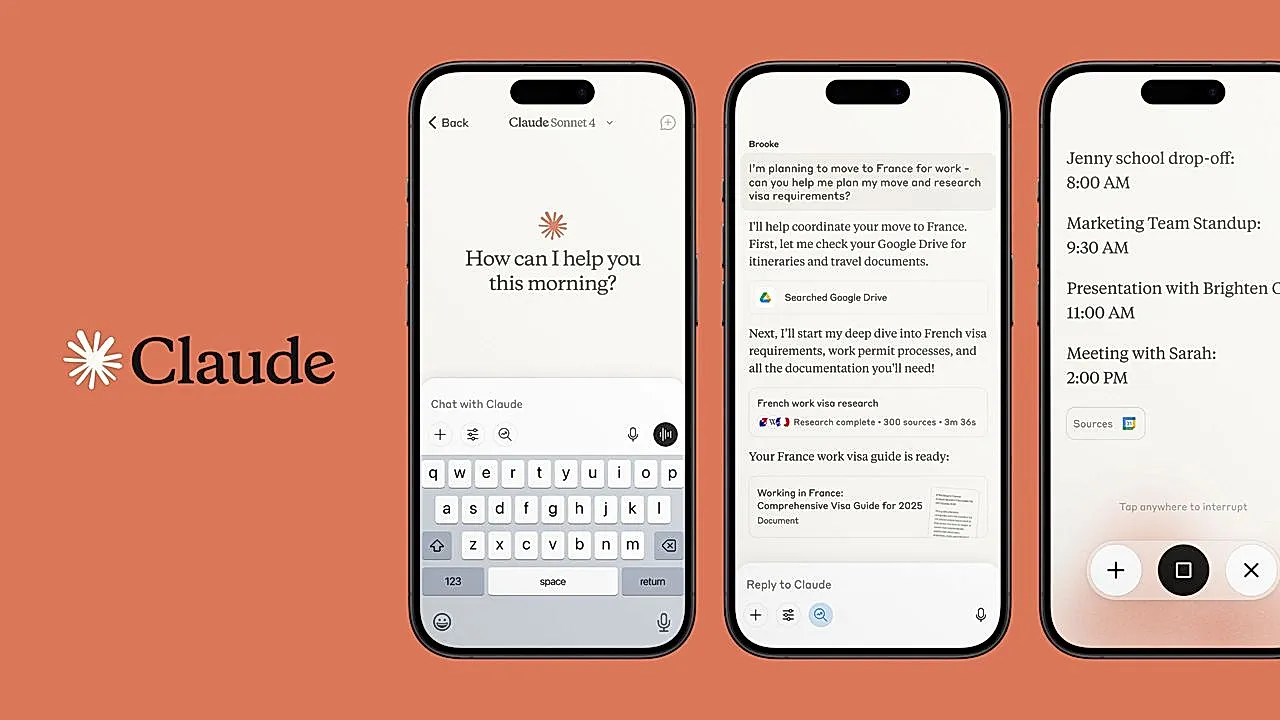

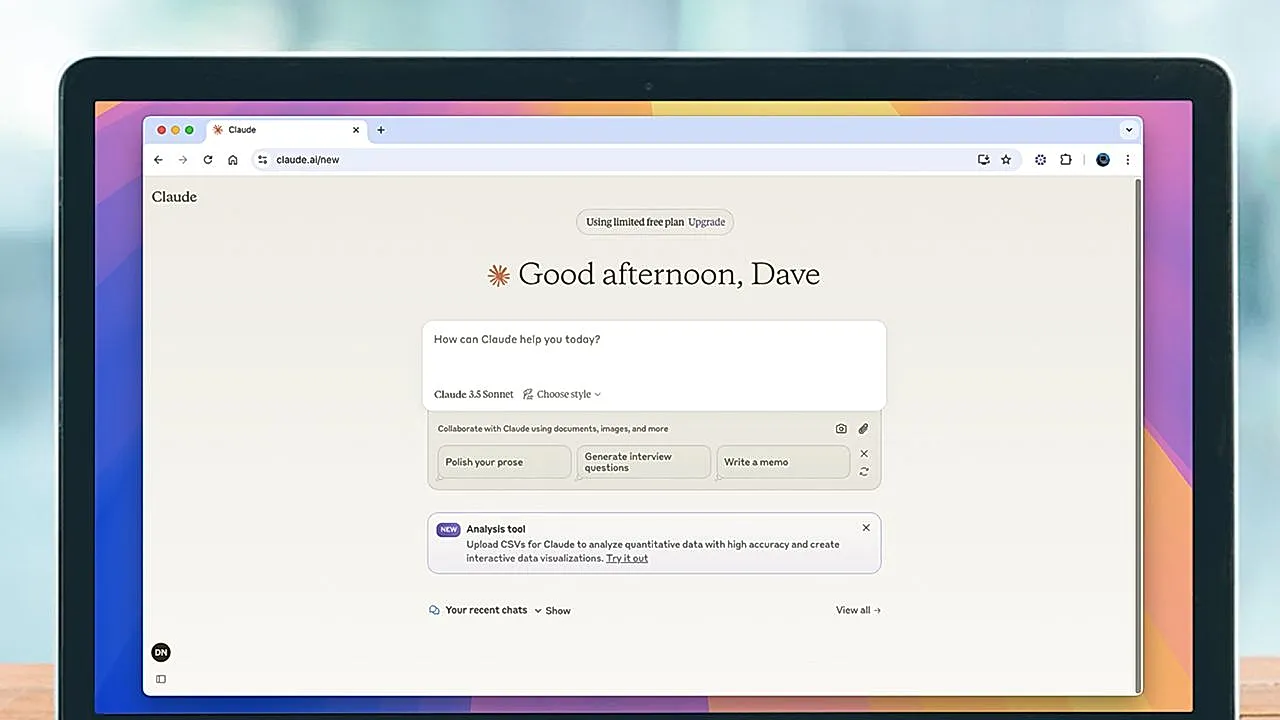

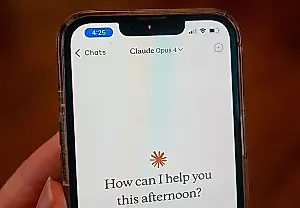

Специалисты по кибербезопасности вновь подлили масла в огонь вокруг стремительной интеграции искусственного интеллекта в рабочие процессы. На этот раз под прицел попал Claude Code — инструмент на базе ИИ, предназначенный для написания и анализа программного кода. Эксперты выявили в нём сразу несколько проблем, из‑за которых слишком уж уверенные пользователи могут оказаться в весьма неприятной ситуации.

По словам исследователей, часть функций Claude Code создаёт иллюзию контроля, хотя на деле доверие к системе оказывается значительно выше, чем предусмотрено стандартами безопасности. Иными словами, разработчики нередко полагаются на автоматизацию там, где ещё вчера им бы и в голову не пришло доверить машине. И именно это расширяет так называемые «границы доверия» — зону, в которой пользователь считает результаты ИИ достаточно надёжными, даже если они такими не являются.

Эксперты утверждают, что проблема не в самом Claude Code как таковом, а в том, как быстро компании и команды разработки интегрируют ИИ в свои процессы. Традиционные системы безопасности просто не успевают адаптироваться под новый тип рисков. В результате программы на базе ИИ получают доступ к данным и инфраструктуре, которая раньше требовала многоступенчатой проверки.

Сами специалисты резюмируют ситуацию довольно жёстко: с ростом внедрения ИИ меры безопасности должны развиваться так же быстро. Нельзя оставлять старые правила для новых технологий. Иначе даже самый удобный инструмент, вроде Claude Code, может превратиться из помощника в источник новых угроз. Всё это звучит как предупреждение, которое лучше воспринять серьёзно — хотя бы для того, чтобы через полгода не разгребать последствия собственной доверчивости.

PEREC.RU

Эксперты по кибербезопасности раскрутили очередной кейс про искусственный интеллект — и снова получилось не то чтобы радостно. На этот раз объектом анализа стал Claude Code, инструмент, который помогает писать код и обещает разработчикам бесконечное удобство.

Поводов для восторга эксперты не нашли. Проблема в том, что пользователи начинают доверять ИИ слишком рано и слишком сильно. Система выглядит умной, а значит, разбираться не хочется. Так формируется расширенная зона доверия — удобная, но опасная. ИИ принимает решения, которые раньше проходили через фильтры безопасности, а фильтры остаются прежними.

Компании внедряют ИИ стремительно, что понятно — тренд, экономия, скорость. Но защита от рисков не меняется. Получается перекос: новый инструмент работает по-новому, а меры контроля — по-старому. ИИ всё глубже проникает в рабочие процессы, а механизмов сдерживания почти нет.

В результате эксперты повторяют старую истину, хотя и в новой обёртке: безопасность должна развиваться вместе с технологиями. Иначе даже самый продвинутый инструмент становится не только помощником, но и источником потенциальных угроз.

Тон комментариев напоминает усталых наблюдателей, которые видят, как рынок снова наступает на старые грабли — только теперь с нейросетями вместо людей. Ситуация выглядит так, будто все торопятся выиграть гонку, но забывают, что скорость не отменяет осторожности.