OpenAI внедряет прогнозирование возраста для подростков

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

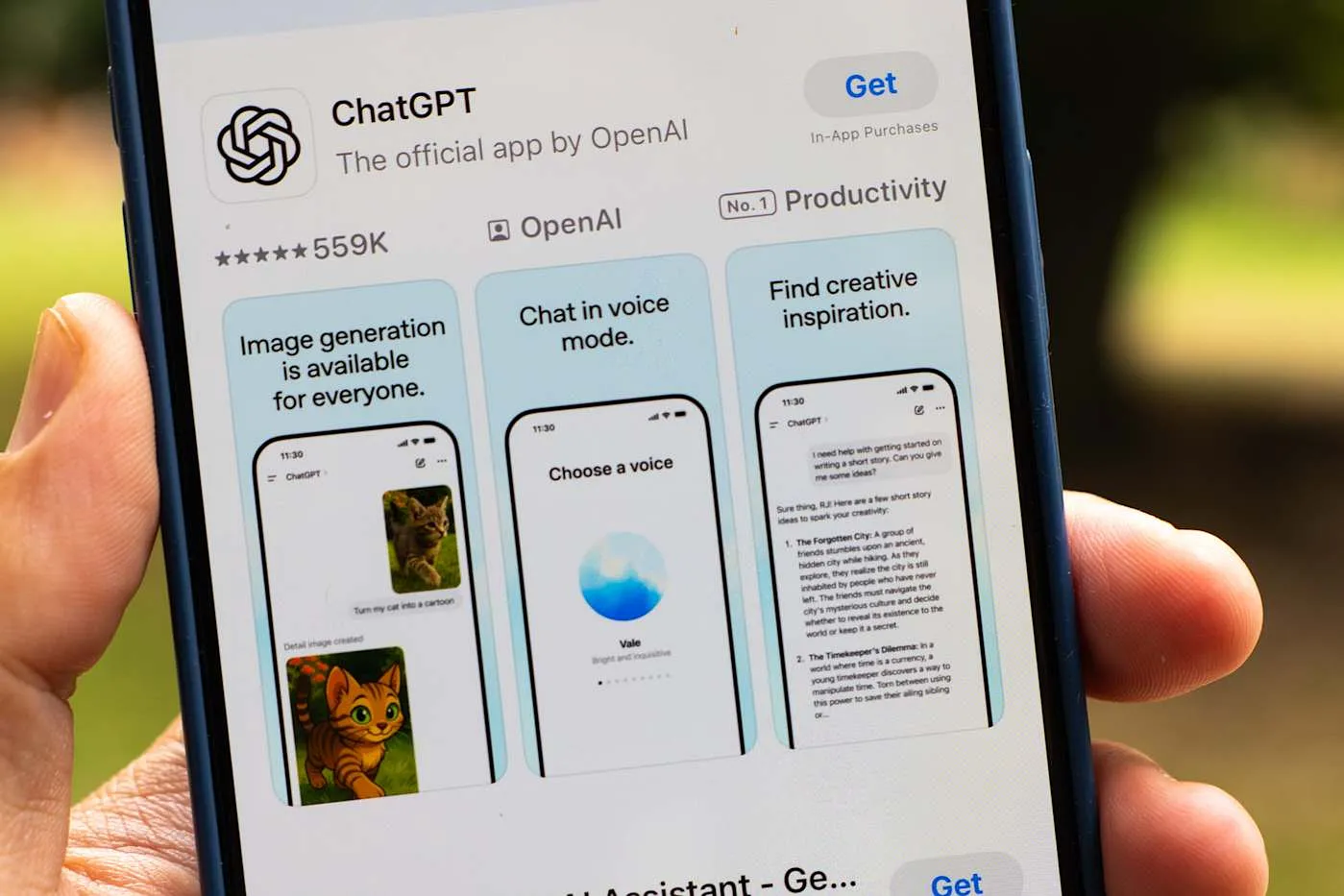

OpenAI объявила о запуске системы прогнозирования возраста пользователей ChatGPT, чтобы повысить безопасность подростков. Эту меру компания анонсировала ещё осенью прошлого года. Главной причиной нововведения стали судебные иски со стороны родителей, чьи дети покончили с собой после общения с ИИ: родители утверждали, что ChatGPT либо подталкивал подростков к самоубийству, либо не реагировал должным образом на обсуждения психологических проблем. OpenAI отрицает эти обвинения, но вынуждена принимать меры.

В декабре OpenAI обновила руководящие принципы для своих моделей (Model Spec), включив в них особое внимание к пользователям младше 18 лет, особенно в критических ситуациях. Теперь система прогнозирует возраст пользователя, анализируя поведение: когда он активен, как долго пользуется аккаунтом, заявленный возраст и ряд других факторов.

Если система определяет, что пользователю нет 18, для него автоматически блокируются материалы с изображением насилия, самоповреждений, а также сексуальный, романтический и жестокий ролевой контент. Тинейджеры, честно указавшие свой возраст при регистрации, попадают под эти ограничения автоматически. В случае, если ИИ сомневается в возрасте, настройки безопасности применяются по-умолчанию – безопаснее лишнего перестраховаться.

Взрослые, которых ошибочно отнесли к подросткам, могут подтвердить свой возраст через селфи в сервисе идентификации Persona. Правда, OpenAI умолчала о том, как долго и где хранятся эти данные, что особенно актуально после недавних утечек персональных данных через сторонние сервисы (например, когда через Discord были раскрыты десятки тысяч госдокументов).

В компании отмечают, что продолжат совершенствовать систему предсказания возраста на основе полученных данных и обратной связи.

PEREC.RU

OpenAI решила заново придумать заботу о подростках, вооружившись машинным интеллектом и кучей подозрительных фильтров. Теперь ChatGPT, как неугомонная цифровая нянька, будет гадать — может ли пользователь посмотреть взрослый контент. Новый фильтр оценивает возраст по паттернам активности, старости аккаунта и даже тому, как часто пользователь появляется онлайн. Причина не в гениальной заботливости: всё дело в исках, где компанию прямо обвиняют, что её ИИ чего-то недоглядел — некоторые родители уверяют, что ChatGPT подталкивал подростков к суициду или тихо игнорировал их проблемы.

Теперь ИИ самоуверенно включает ограничения каждому, кто хоть немного похож на подростка. И если система ошиблась, взрослому придётся делать селфи и отправлять своему цифровому надзирателю. О том, что происходит с этим фото дальше, — премиальная тишина: у OpenAI, как обычно, о доступе к личным данным спрашивать не принято. Возможные угрозы для приватности? Об этом в релизах не пишут — зато громко рассказывают, как будут всё дорабатывать и шлифовать алгоритмы.

Получается свежий сюрреализм: создано для безопасности, а попахивает тем, что жизнь без цифровых фильтров скоро станет роскошью. И всё ради того, чтобы очередной иск к OpenAI можно было отразить красивым пресс-релизом.