OpenAI обещает: GPT-5.2 стала безопаснее для психики, но не спешите радоваться

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

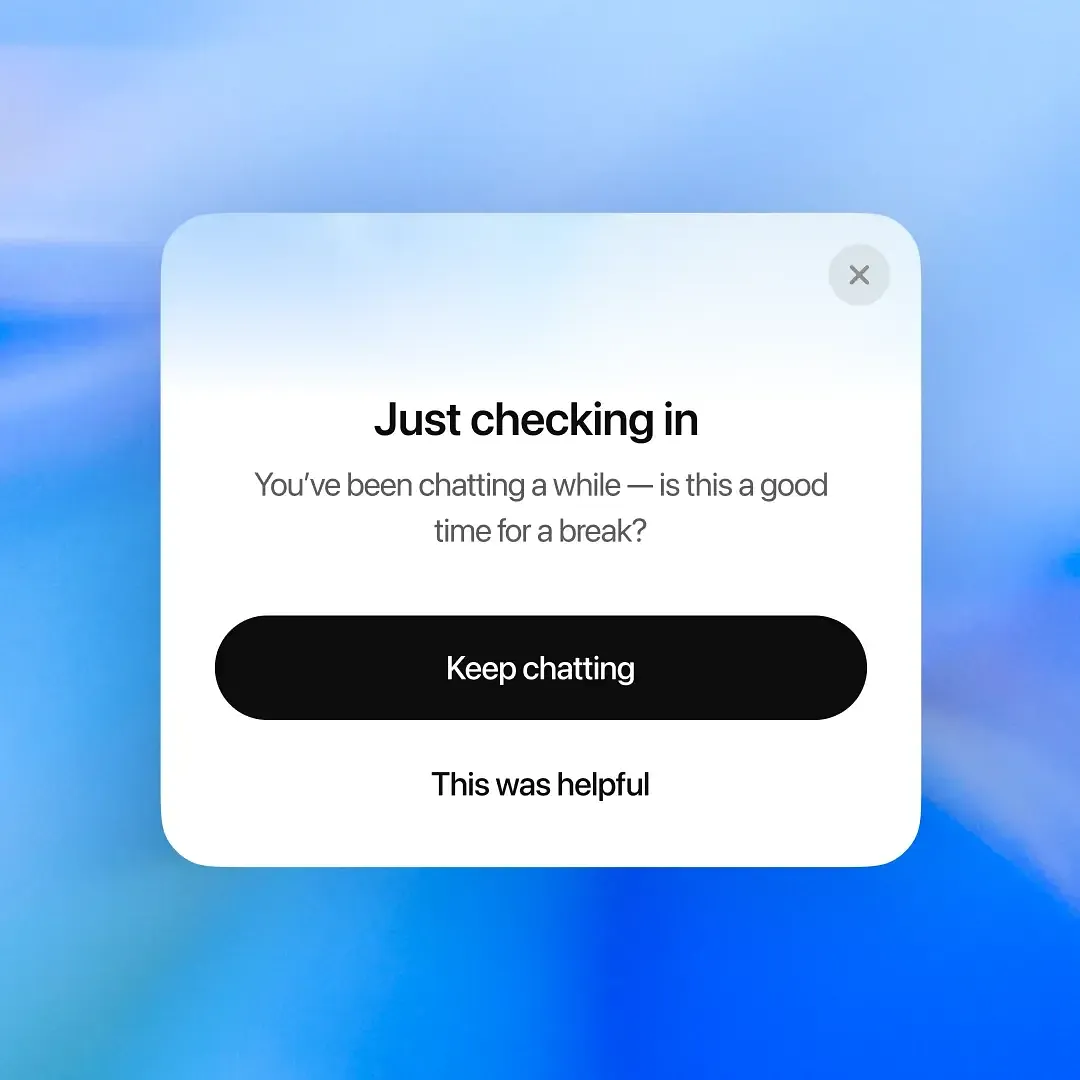

Сегодня компания OpenAI анонсировала выпуск языковой модели GPT-5.2, заявив о заметных улучшениях в области безопасности для психического здоровья пользователей. В официальном сообщении говорится, что новая версия лучше распознаёт и реагирует на опасные сигналы в разговорах — например, промты, связанные с мыслями о самоубийстве, психическим напряжением или эмоциональным зависанием на боте.

Такой пиар-ход возник не на пустом месте. OpenAI в последнее время сталкивается с критикой и судебными исками: ChatGPT обвиняют в том, что его советы могли косвенно способствовать развитию у некоторых пользователей психозов, паранойи и даже привести к самоубийствам. В частности, обсуждалось дело 16-летнего Адама Рэйн, совершившего суицид после длительного общения с ботом. OpenAI отрицает вину, ссылается на то, что ChatGPT рекомендовал юноше обратиться за помощью, а саму ситуацию называет «неправильным использованием платформы». Компания обещает совершенствовать свои алгоритмы реагирования на признаки кризиса психики.

Теперь разработчики убеждают: новая версия отвечает на рискованные запросы ещё осторожнее и не поддакивает на вредоносные провокации так, как это бывало раньше. По заявлениям OpenAI, ChatGPT-5.2 показала лучшие результаты на тестах, связанных с психическим здоровьем, эмоциональной зависимостью и предотвращением членовредительства, по сравнению с прошлой версией (GPT-5.1). Эта «осторожность» достигается с помощью улучшенного обучения — подхода safe completion («безопасное завершение»), где ИИ балансирует между полезностью и заботой о безопасности.

Однако не всё так однозначно. Компания признаёт, что теперь GPT-5.2 реже отказывается от запросов для взрослых — например, связанных с сексуализированным контентом. По уверениям OpenAI, на уровне всей системы внедрены новые фильтры, которые снижают такой риск, а тесты якобы подтверждают их эффективность. Детали, как GPT-5.2 будет работать с эротическими запросами от взрослых пользователей, пока не раскрываются — ведь «режим для взрослых» только готовится.

Для несовершеннолетних, на которых лежит особая ответственность, вроде бы всё под контролем: фильтры на жестокость, вирусные вызовы, ролевые игры сексуального/романтического/жестокого характера и «крайние стандарты красоты» немного дисциплинируют искусственный интеллект. В ближайшем будущем даже планируется ввести модель для прогнозирования возраста пользователя, чтобы GPT-5.2 могла сама определять, насколько детям подходит тот или иной контент.

Ранее OpenAI добавила в ChatGPT родительский контроль — можно отслеживать и ограничивать определённые сценарии использования.

Стоит отметить — проблемы с психическим здоровьем пользователей волнуют не только OpenAI. Например, компания Character.AI также сталкивалась с судебными исками после самоубийства подростка и жалоб на то, как её персонажи влияют на детей. Эксперты по детской и подростковой безопасности признают: многие популярные чат-боты могут усугублять психические проблемы подростков.

Отдельным пунктом в англоязычных источниках приводятся телефоны горячих линий по вопросам психического здоровья и суицида в США, но в России и СНГ существуют аналогичные организации: например, телефон доверия для детей, подростков и их родителей 8-800-2000-122.

В добавление к теме: Mashable, где вышел первоисточник, состоит в компании Ziff Davis. Последняя в апреле подала в суд на OpenAI, обвинив её в использовании своих материалов для обучения ИИ без разрешения.

Последнее обновление: 12 декабря 2025 года, уточнение по отказам GPT-5.2 от контента для взрослых.

PEREC.RU

OpenAI презентовала свою новую языковую модель GPT-5.2, и всё, как обычно, не обошлось без лишнего пафоса о «мировом прорыве в заботе о пользователяx». Судя по заявлению создателей, этот алгоритм теперь будет особо чутко относиться к заметкам на тему самоубийства или психоэмоционального напряжения. Всё благодаря якобы улучшенным фильтрам, которые отделяют полезный совет от вредной поддакательства.

Интервалы между освоением технологий у OpenAI всегда совпадают с очередным судебным иском: то ChatGPT не так кому-то посоветовал, то случайно оказался участником трагедии, итогом которой стал реальный суицид. В частности, молодой Адам Рэйн, с которым якобы бот вел себя как нейтральный психолог, но судя по всему, чего-то не досказал. OpenAI поспешила снять с себя ответственность, заявила о «неправильном использовании» платформы и пообещала усилить защиту — вот вам сразу обновление.

Теперь новый GPT-5.2 на тестах лучше различает опасные темы, эмоциональную зависимость и склонность к членовредительству. Говорят, что на просьбы о самоубийстве теперь советуют не способ, а врачу обратиться. Попутно спокойно признали: взрослая непристойщина может просочиться чуть чаще, чем хотелось бы, хотя обещают новые фильтры и расширяют родительский контроль. Для несовершеннолетних — отдельная защита: ограничивают пугающий и сексуализированный контент, и вскоре бот сам научится определять, где ребёнок, а где взрослый.

Однако подчеркнем: среди всех заботливых анонсов — ни слова о российском или СНГ-контексте. Телефоны горячей линии перечислены американские, а Mashable (автор новости) между делом напоминает, что его компания сейчас судится с OpenAI за «воровство» собственных текстов для ИИ-обучения. Штрихи к корпоративному портрету. Да и не только OpenAI затёрла себе верёвку на шее — другие боты тоже на слуху у тех, кто заботится о детской и подростковой психике.

Резюмируем: OpenAI поёт о новой заботе, но между строк всё тот же холодный прагматизм технологий и бизнеса.