ИИ Google научился делать почти настоящие «фото на телефон»

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

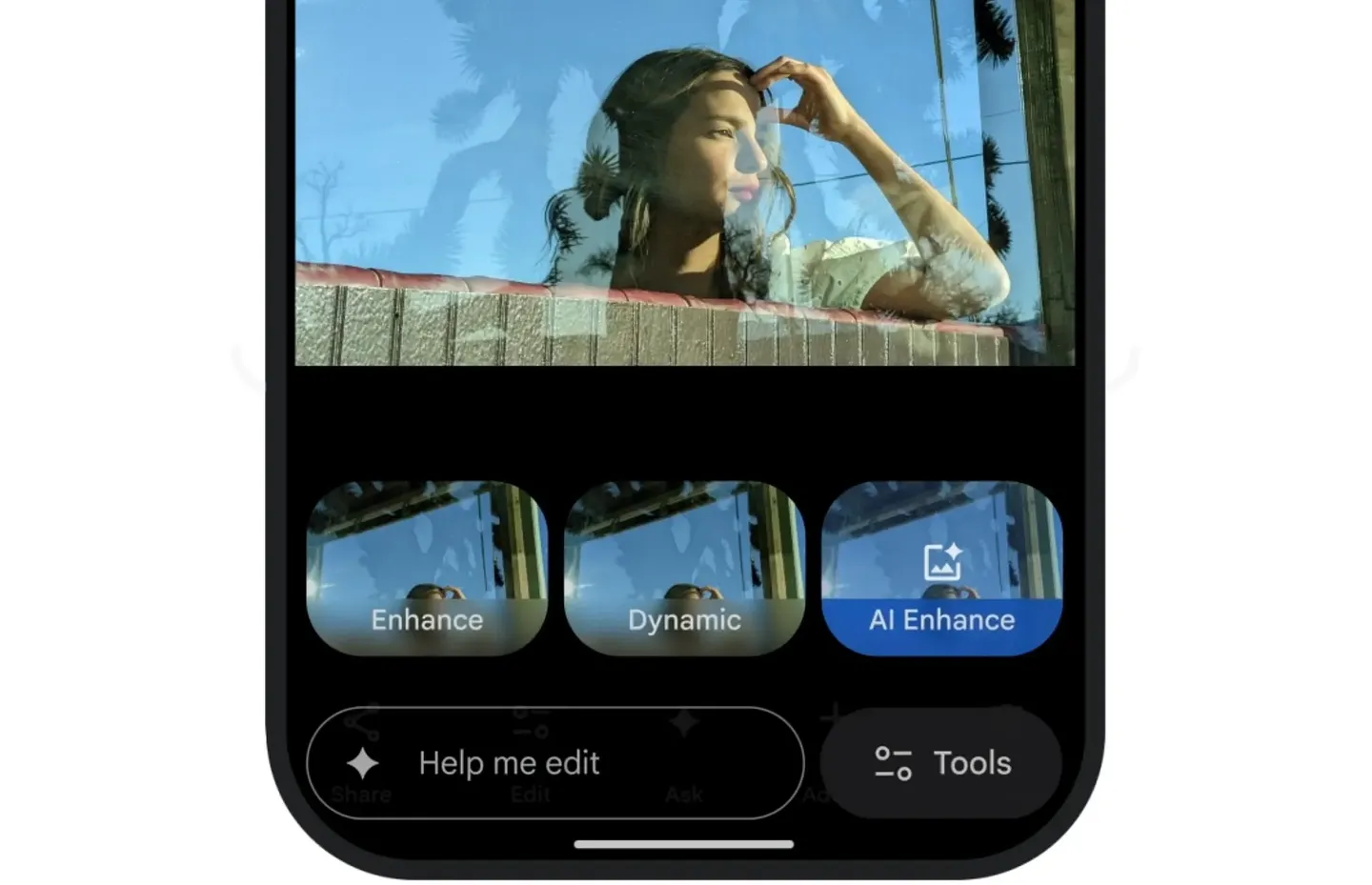

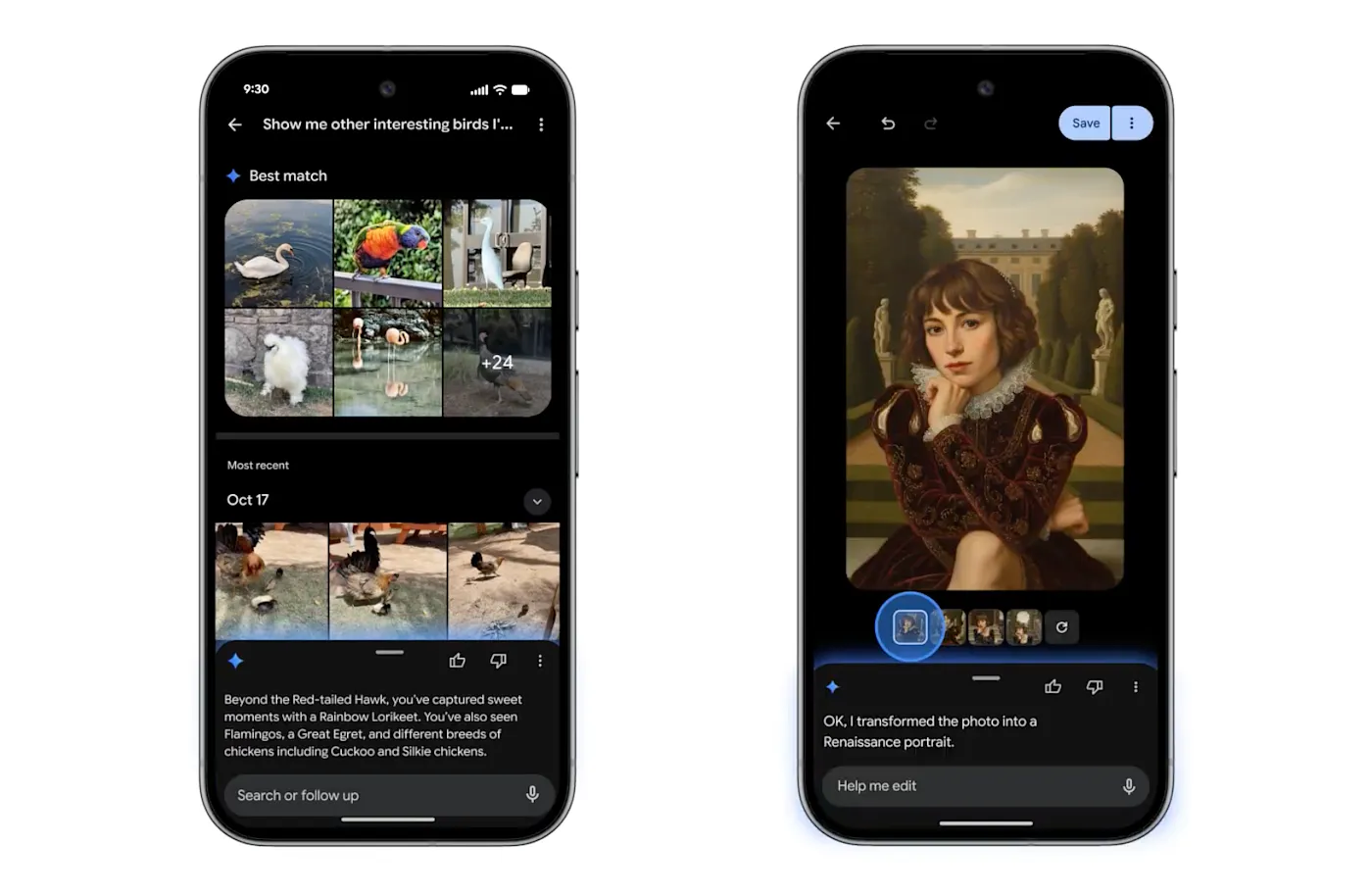

ИИ-модель Google, ориентированная на генерацию изображений, достигла нового уровня мастерства – теперь она может создавать настолько правдоподобные снимки, что отличить их от реальных фотографий, сделанных камерой смартфона, становится практически невозможным. На днях я тестировал эту нейросеть, и ощущение после просмотра её работ можно описать одним словом – «бананы». Почему? Потому что она генерирует настолько реалистичные снимки, что возникает ощущение абсурда – как будто сходишь с ума от их фотореализма. Название модели, Nano Banana Pro, весьма символично – ведь изображения, созданные этим ИИ, действительно выглядят как «настоящие» фото с телефона. Это отличает их от прежних некачественных попыток искусственного интеллекта изобразить фотографии: раньше сгенерированные ИИ картинки легко выдавали себя неестественными деталями или ошибками. А теперь на первый взгляд всё настолько похоже на правду, что распознать подделку может только очень внимательный человек. Конечно, если присмотреться, «чёртовы бананы» всё же можно различить: отдельные элементы, вроде неестественно расположенного уличного фонаря на фоне, выдают суть происходящего – картинка сгенерирована искусственно. Но для большинства обычных пользователей эти нюансы останутся незаметными, и они будут уверены, что это реальное фото, снятое обычной камерой смартфона. Подобные технологии могут перевернуть наше представление о подлинности изображений – ведь если даже специально обученный взгляд с трудом замечает искусственное происхождение снимка, то что уж говорить о среднестатистическом зрителе? Пока что технология требует доработки и может временами совершать курьёзные ошибки, но тенденция очевидна: если машины уже сейчас умеют генерировать такие реалистичные псевдофото, реальным фотографам придётся искать новые способы доказывать подлинность своих кадров. Какой вывод? Похоже, скоро привычная истина «увидел – поверил» окончательно утратит свою актуальность.

PEREC.RU

Google снова решил всех перехитрить и запустил ИИ с говорящим названием Nano Banana Pro. Ядрёная смесь технологии и троллинга: теперь сгенерировать фото, которое выглядит как кастомное селфи для соцсетей, можно без помощи камер — только фантазии алгоритма. Кажется, что снимок сделан обычным смартфоном обычным человеком в обычном городе — но зритель ловит себя на мысли: что-то тут не то. Кто-то в Google явно решил, что фейк должен быть максимально похож на оригинал, и вплотную приблизился к этой мечте.

Конечно, идеального воплощения не получилось: искусственный свет и пересмотренная перспектива выдают происхождение снимка. Но раньше и этого не было — нейросети неправдоподобно мазали детали, а тут уже почти достойно паспорта или Tinder. Из-за чего всему интернету пора задуматься: если ИИ творит такие "селфи", значит, скоро любое фото будет под подозрением. Скучно, как в музее восковых фигур, но гораздо опаснее: доверие к изображению исчезает, а сам процесс фотосъёмки становится шоу для алгоритмов. Впору придумывать цифровые паспорта для настоящих снимков и учиться отличать искусственную реальность от настоящей. Ну а Google, как всегда, в роли главного провокатора: сделал — сам удивился, как круто получилось.