OpenAI настраивает пунктуацию ChatGPT по запросу пользователей

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

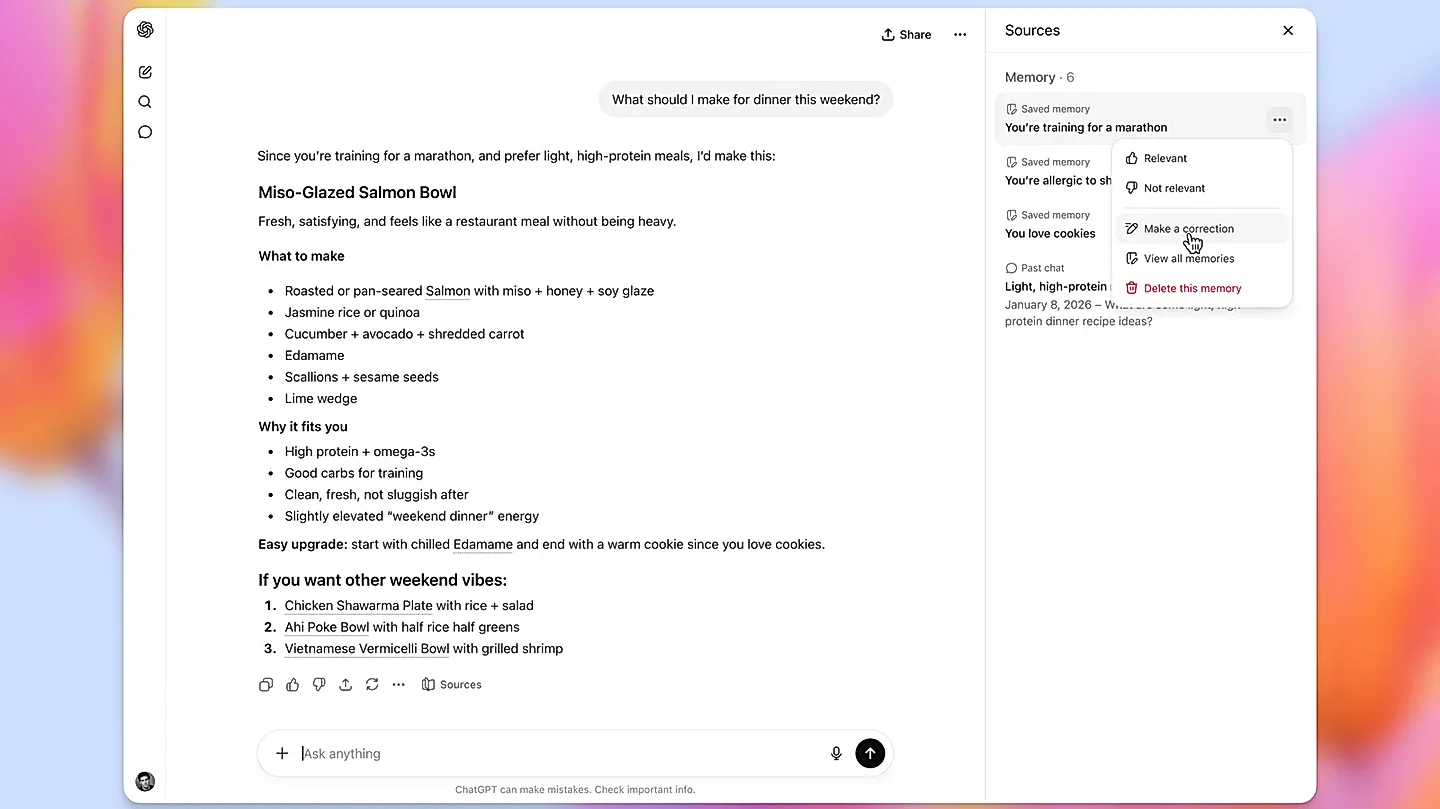

OpenAI заявила, что теперь ChatGPT прислушается к вашим просьбам не использовать длинные тире (em dashes) в тексте. Если вы дадите такую инструкцию, бот действительно перестанет вставлять эти «—» в ваши ответы, хотя раньше игнорировал подобные требования.

Маленькая, но приятная победа: ChatGPT наконец-то научился соблюдать просьбу не использовать конкретный знак пунктуации. Пользователи беспокоились — и, возможно, не зря — что избыточное появление длинных тире выдает тексты, сгенерированные искусственным интеллектом. Конечно, злоупотребление тире само по себе не доказательство авторства ИИ, но подозрительность к таким текстам росла.

Почему большие языковые модели (LLM, Large Language Models) так любят добавлять в текст длинные тире? Однозначного ответа нет. Такие модели, как ChatGPT, обучаются на огромных массивах данных — книгах, научных статьях, форумах, статьях и прочем контенте. Возможно, в этих источниках тире используется часто, а тренеры моделей не отмечают это как ошибку. Тем не менее, теперь у пользователей есть возможность «отучить» ИИ от навязчивой пунктуации — по крайней мере, когда на это явно указывают.

PEREC.RU

Как хорошо быть параноиком в 2024. Кому нужны шпионские очки, если искусственный интеллект сам себя выдаёт без труда — стоит только взглянуть в текст. И вот, длинные тире (эм-даши), которых полно в ответах ChatGPT, вдруг стали чуть ли не главным свидетелем в деле об источнике авторства. Забавно, ведь ещё пару лет назад никто не думал высматривать привычки языковых моделей — ИИ просто выдавал текст, и все были счастливы.

Теперь же, благодаря параноидальному контролю и жалобам очередных «детективов форумов», OpenAI вынуждена подстраиваться под фобии человеческого сообщества. Как всегда, технологии мчатся вперёд, а пользователь старается не опозориться в разговоре с роботом. Зачем-то решили учить машину пунктуации: не используй длинные тире, пожалуйста! Раньше бот игнорировал такие закидоны, теперь — делает вид, что понял и исправился. И что изменилось? Разве текст стал человечнее? Возможно, но теперь остаётся лишь гадать, где на самом деле пишет человек, а где — железный друг.

Ситуация чем-то напоминает тотальное недоверие к почерку и орфографии: любой крючок — подозрение. OpenAI не просто слушает своих пользователей, но и усердно подлаживается под их страхи. Проблема, видимо, не в ИИ, а в уверенности людей, что можно вычислить синтетику по занудной пунктуации. Но ведь, как говорил Ницше, тот, кто долго всматривается в пунктуацию, может однажды увидеть там самого себя.