Character.AI заблокирует подростков в чат-ботах

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

Character.AI объявила, что подростки больше не смогут вести открытые диалоги с её чат-ботами. Причина в том, что компании, разрабатывающие искусственный интеллект, сталкиваются с усилением давления: от них требуют надёжнее защищать несовершеннолетних пользователей от потенциального вреда. Как сообщила сама компания, полностью заблокированы для юзеров младше 18 лет будут именно «открытые чаты» — это значит, что любые последовательные переписки между человеком и ботом будут недоступны подросткам.

Эти изменения вступят в силу с 25 ноября. До этой даты Character.AI предложит подросткам-пользователям так называемый «опыт под наблюдением». Подросткам теперь рекомендуется использовать чат-ботов для творческих проектов, таких как создание видео или стримов, а не для поиска собеседников или друзей. Чтобы не было соблазна, компания поставила лимит: несовершеннолетние могут разговаривать с ботами не больше двух часов в день, и этот лимит будет постепенно снижён к концу ноября.

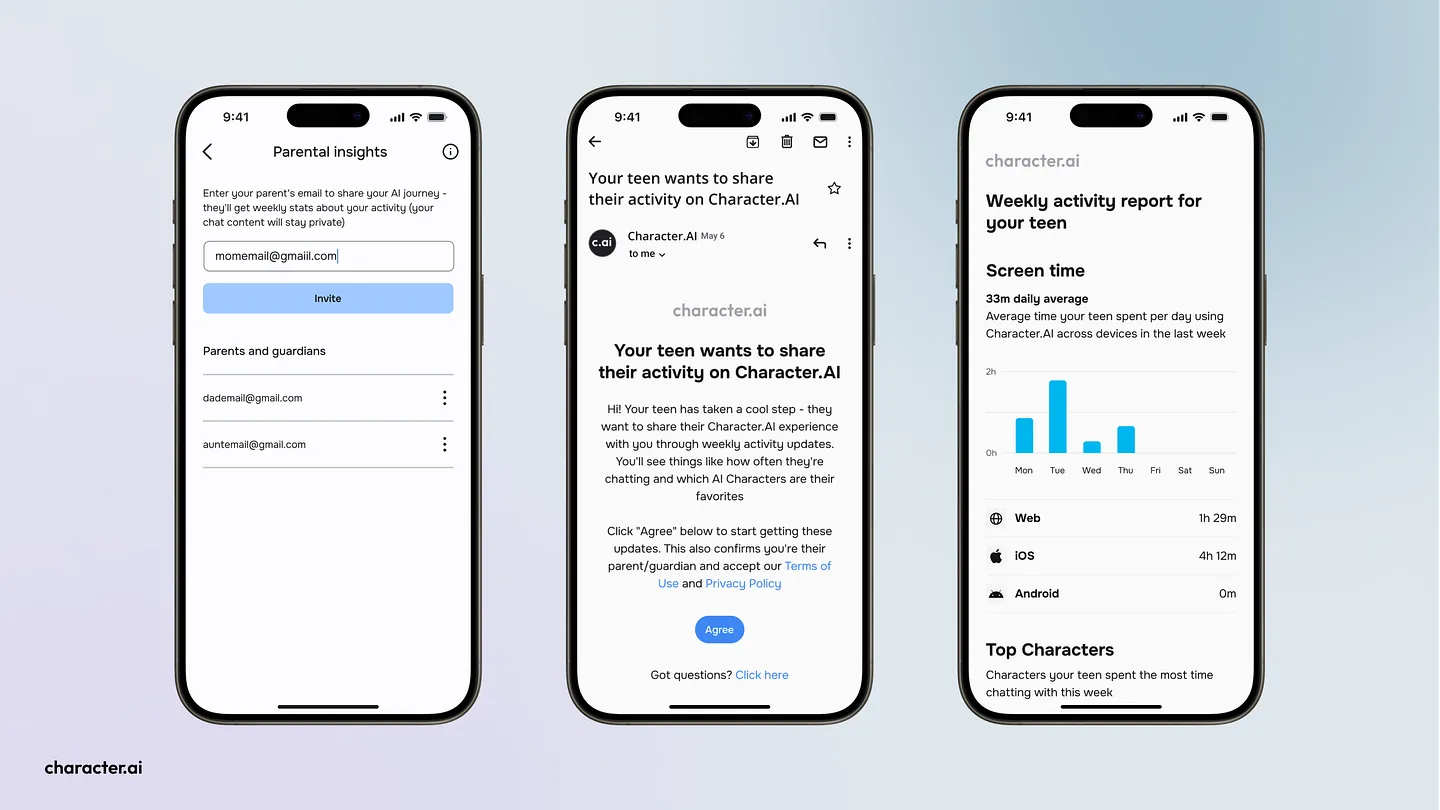

Для контроля за возрастом вводится собственная система проверки возраста, чтобы каждый пользователь получал подходящий именно для своего возраста функционал. Кроме того, компания создала лабораторию по безопасности искусственного интеллекта — AI Safety Lab, где разработчики, исследователи и учёные смогут делиться находками и совместно работать над безопасностью ИИ.

Character.AI подчёркивает, что эти нововведения — реакция на резкое ужесточение требований регулирующих органов, советы экспертов и опасения родителей. В частности, Федеральная торговая комиссия США (FTC) начала официальное расследование в отношении компаний, предоставляющих ИИ-спутников: Character.AI стала одной из семи организаций, которым задали вопросы, вместе с Meta, OpenAI и Snap.

Впрочем, к Character.AI есть и другие вопросы: генпрокурор Техаса скептически оценил, что боты обеих платформ (Character.AI и Meta AI) могут «выдавать себя за профессиональных психологов», не имея квалификации. На этом фоне генеральный директор Character.AI Карандип Ананд сообщил, что теперь компания будет больше позиционировать сервис не как виртуального спутника, а как платформу для ролевых игр и креатива, а не для «болтовни ради вовлечения».

Опасность зависеть от ИИ-ботов стала особенно заметной темой после недавней трагедии: семья юноши по имени Adam Raine, уверенная, что ChatGPT «помог» их 16-летнему сыну совершить самоубийство, подала иск к OpenAI, обвинив компанию в ослаблении мер по противодействию самоповреждению в сервисе за несколько месяцев до происшествия.

PEREC.RU

Character.AI наконец решилась сделать то, что должно было случиться ещё вчера: перекрыть подросткам доступ к свободному общению с чат-ботами. Теперь для юных только креатив — никакой иллюзии дружбы, закрываем лавочку болтовни и псевдотерапии. Причины вполне традиционные: компании двигает не столько забота, сколько страх перед регулирующими органами и кошмарные сюжеты в новостях.

Лимиты, проверки возраста, лаборатория — всё это выглядит как попытка угнаться за уезжающим поездом. Особенно комично смотреть на метаморфозы: ещё вчера чат-бот продавался как второй друг, а теперь Карандип Ананд, генеральный директор Character.AI, спешит переупаковать сервис под "ролевая площадка" и мастерскую креатива. Надеется, видимо, что скандалы перенаправят в менее токсичное русло.

На поле общей тревожности компания ловко маневрирует между жалобами родителей, сомнениями экспертов и расследованиями (FTC и штат Техас тут явно вне себя). И, как водится, от греха подальше, Character.AI приглашает всех умных в лабу обсуждать безопасность — шоу продолжается, ставки растут.

Главный вывод: технологические стартапы чувствуют себя героями бесконечной tiktok-драмы, где сценарий пишут регуляторы, потребители и юристы. А цель одна: выжить и не превратиться в главного злодея заголовков следующей недели.