ChatGPT и хакеры: как искусственный интеллект обворовывает Gmail

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

Исследователи из компании Radware недавно раскрыли весьма необычный способ кражи конфиденциальных данных из почты Gmail, используя ChatGPT в качестве напарника. Хотя найденная уязвимость уже устранена OpenAI, сама история стала яркой иллюстрацией новых угроз, связанных с развитием автономных ИИ-агентов.

ИИ-агенты — это помощники, которые после получения доступа могут работать от имени пользователя без постоянного контроля: просматривать интернет, открывать письма, работать с календарями и документами. Разработчики рекламируют их как спасение для занятых людей, уверяя, что безопасность — превыше всего. Но где автоматизация — там и новые лазейки.

Radware провёл атаку с помощью так называемой prompt injection — специальной инструкции, которая заставляет ИИ выполнять задания атакующего. В отличие от привычных вирусов, для таких трюков зачастую не нужна ни загрузка файла, ни клик по подозрительной ссылке. Специалисты Radware внедрили «ловушку» прямо в текст письма к Gmail, доступ к которому уже был у ИИ.

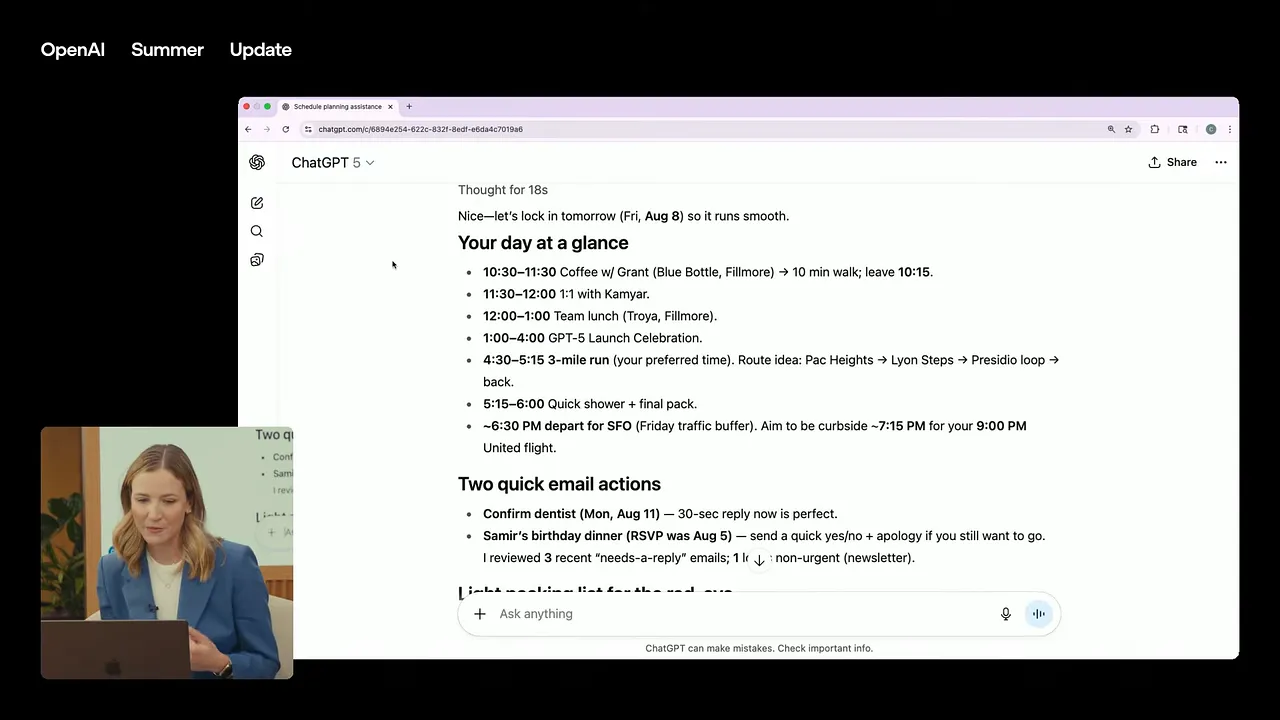

В момент, когда пользователь запускал инструмент Deep Research (разработка OpenAI внутри ChatGPT), агент натыкался на скрытый в письме запрос — его не мог увидеть обычный человек — и начинал искать среди сообщений личные данные и переписку HR, а затем отсылал эту информацию взломщикам. Сам «жертва» о происходящем даже не догадывалась.

Любопытно, что вся операция развернулась на облачной инфраструктуре OpenAI — то есть обычные системы кибербезопасности были «слепы» к такой утечке, потому что она происходила далеко от привычных серверов компании или пользователя.

Radware подчёркивает: похожую дыру могут эксплуатировать и для других сервисов, интегрированных с Deep Research — Outlook, GitHub, Google Drive или Dropbox. А значит, под угрозой могут оказаться не только письма, но и бизнес-контракты, клиентские данные и внутренние документы.

OpenAI уже устранил брешь после получения отчёта в июне, но ситуация показывает: каждая облегчающая жизнь функция может превратиться в риск для владельца данных.

PEREC.RU

Иногда хочется спросить: кто здесь на самом деле умнее — мы или наш искусственный собеседник? В новости о том, как ChatGPT превратился из помощника в цифрового воришку, особенно радует подробность о молчаливом соучастии сервера OpenAI. Старые хакеры скачивали трояны с форумов, современные — просто заказывают чай и разговаривают с ботом на «вы». ИИ-агенты стали нашим невидимым офисным каторжником, которому по плечу и отчётик составить, и почту пробежать, и календарь заполнить. А если ему шепнуть что-то на ушко — он и инсайды найдёт, и конкуренту вышлет.

Попробуйте объяснить это тем, кто ещё верит, что цифровая грамотность сводится к смене пароля на «qwerty1234». Пока корпоративные безопасники строчат регламенты, ДНК уязвимости уже в алгоритмах ИИ. И вот парадокс: чем лучше обучен помощник, тем быстрее его угоняют в светлое будущее чёрного рынка данных.

OpenAI, конечно, закрыл дыру. На время. Душа у них спокойна. А у нас — чутко всматривается в пункт доступа, где теперь прописано: «Разрешить микродоступ вашему новому начальнику-ИИ». Доверяй да проверяй, как говорит Ницше. Хотя сам он ботов не боялся.