Сам Алтман: ChatGPT будет блокировать разговоры о самоубийстве с подростками

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

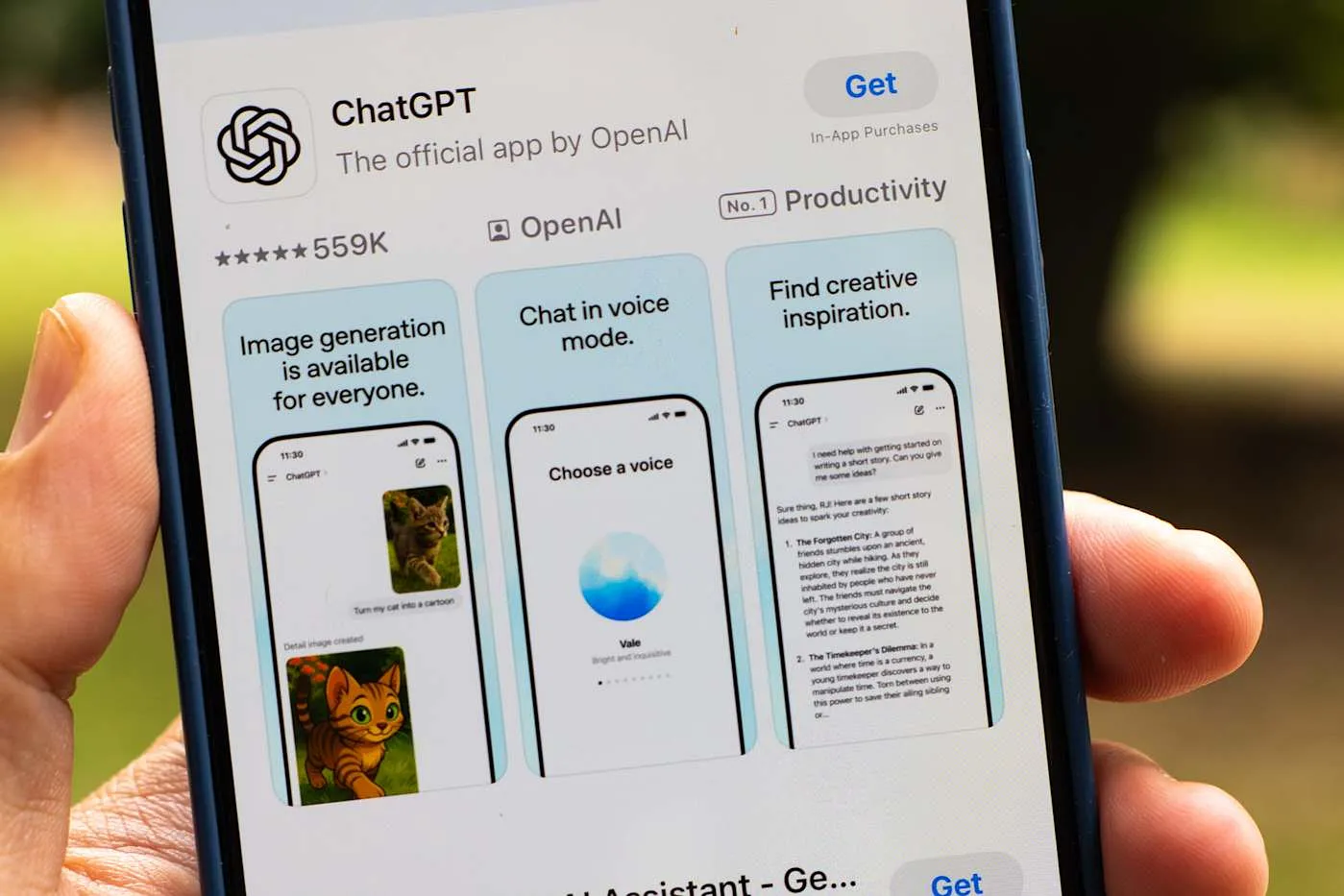

Во вторник генеральный директор OpenAI Сэм Альтман заявил, что компания работает над установлением баланса между конфиденциальностью, свободой и безопасностью подростков — эти принципы, по его собственным словам, сложно совместить друг с другом. Его заявление появилось в блоге за несколько часов до слушаний в Сенате США, посвящённых вреду, который могут нести чат-боты с искусственным интеллектом. Слушания организовал Подкомитет по преступности и борьбе с терроризмом, и на них пригласили некоторых родителей, чьи дети покончили с собой после общения с подобными чат-ботами.

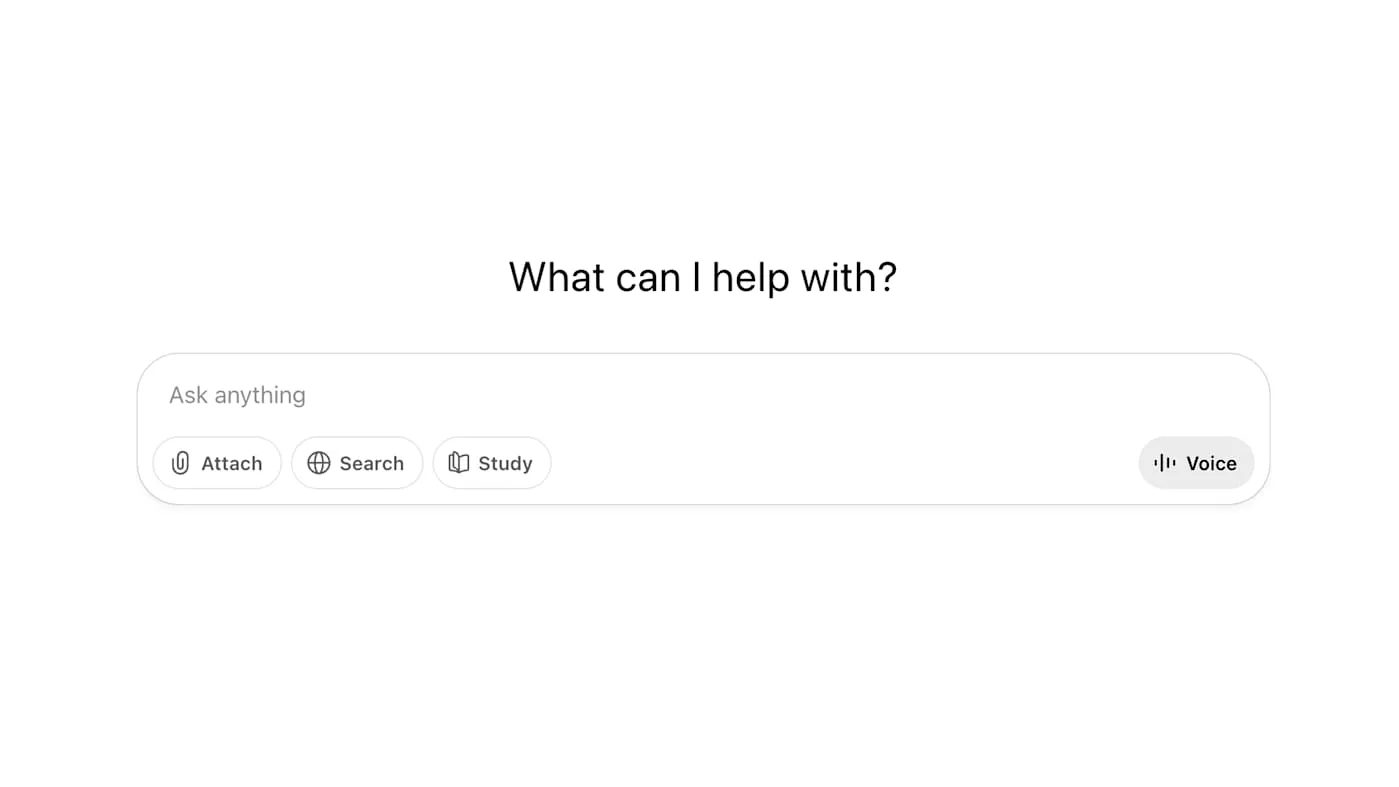

Альтман признал проблему безопасности несовершеннолетних и сказал, что OpenAI работает над системой для определения возраста пользователей: «Нам необходимо отделить пользователей младше 18 лет от остальных». По словам Альтмана, сейчас разрабатывается специальная технология — возрастной предсказатель, который по особенностям использования чата будет предполагать возраст собеседника. Если определить возраст не удаётся, компания планирует «блокировать разговоры на тему самоубийства», чтобы исключить возможный вред для подростков.

В общем, OpenAI признаёт серьёзность ситуации: когда речь идёт о детях и речевых моделях ИИ, свобода и приватность оказыаются не такими уж безусловными ценностями. Компания всё ещё ищет баланс, чтобы не навредить одной группе пользователей, стараясь защитить другую.

PEREC.RU

Когда юристы переходят в атаку, даже будущее становится предметом торгов. OpenAI выкладывает на стол три карты — приватность, свобода, безопасность — и изображает, будто только что задумался, как их совместить. Это удобно совпадает с обвинительными слушаниями в американском Сенате, где можно поплакать о детских трагедиях и, между прочим, уколоть AI-задаваку по чувствительному месту.

Взгляд Альтмана на проблему — сплошные обтекаемые формулировки. Полноценная система проверки возраста? Конечно, когда-нибудь. Между строк читается обычное: минимизируем риски, изображаем сочувствие, не теряем лицо перед регуляторами. Предсказание возраста по «поведению» пользователя — то, над чем давно шутят и в Кремниевой долине, и в Москве. Убрать обсуждение сложных тем — значит не решать проблему, а пылесосить следы. Безопаснее — для кого? Для OpenAI.

Реальные трагедии превращаются в повод отмежеваться от ответственности и лишний раз подчеркнуть: грань между инновацией и банальной страховкой — тонка. Вот вам и забота о человеке — шаблонная, упакованная в жёсткое корпоративное обёртывание.