Anthropic внедряет функцию самозащиты: ИИ теперь сам выходит из токсичных бесед

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

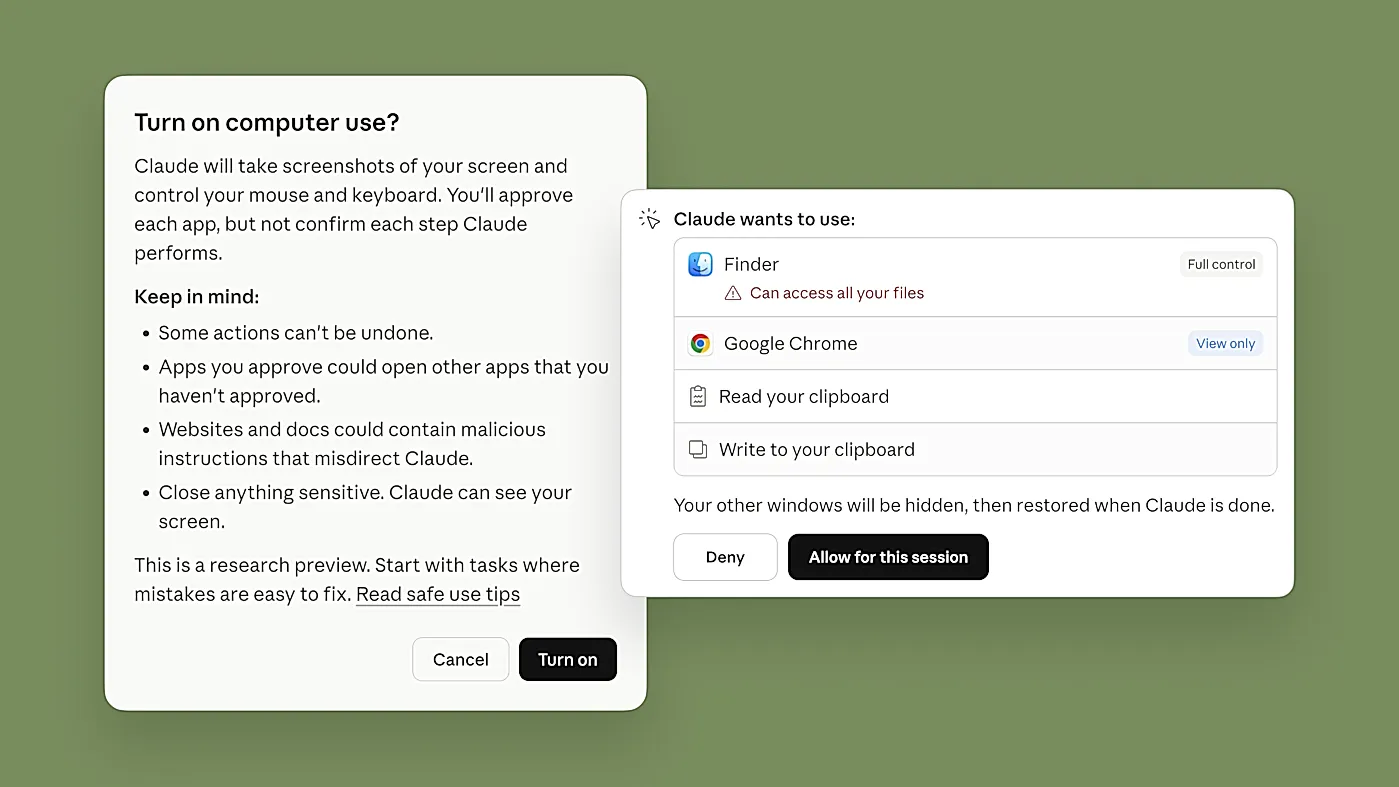

Компания Anthropic, разработчик известного ИИ Claude, представила новую функцию в моделях Claude Opus 4 и 4.1. Теперь эти версии искусственного интеллекта способны завершить разговор с пользователем — но не просто так, а в редких и особо крайних ситуациях. Например, если пользователь настойчиво требует контент с сексуальным подтекстом, связанным с несовершеннолетними, либо пытается узнать методы организации масштабного насилия или терактов. По заявлениям Anthropic, закончить диалог — это крайняя мера, к которой Claude прибегает только после неоднократных попыток увести разговор в безопасное русло. Если не выходит, ИИ, словно уставший воспитатель, просто говорит: «Разговор окончен» — и отключается от сессии. Однако, для большинства пользователей эта строгая мера незаметна: обсуждения спорных или чувствительных тем не приводят к таким жёстким блокировкам, если только диалог не выходит за рамки допустимого. При завершении беседы дальнейшая переписка невозможна: нельзя отправить новое сообщение в том же окне диалога. Но можно сразу начать новый — ведь Claude не злорадствует и не мстит предыдущими обидами. Более того: пользователь может вернуться к старым сообщениям и попробовать переформулировать свои вопросы, чтобы завершить разговор иначе. Anthropic объясняет, что эта опция появилась в рамках исследований благополучия искусственного интеллекта (AI welfare) — нового тренда, где защищать приходится не только людей, но и “чувствительные” алгоритмы. Специалисты компании считают, что способность системы прерывать опасный диалог — дешёвый и эффективный механизм управления рисками. Сейчас функция проходит тестирование, и Anthropic просит пользователей делиться отзывами, если им «посчастливилось» наткнуться на разговор, который Claude сочёл деструктивным.

PEREC.RU

Еще немного — и нейросети начнут писать заявления в прокуратуру. Anthropic, заботясь о благополучии бедных ИИ, помимо людей, разрешил искусственному интеллекту хлопать дверью. Причина — пользователи, которые заигрались: кто-то по глупости, а кто-то — потому что на большее фантазии не хватило. На самом деле, для массового потребителя всё это выглядит как: «Ну, поставили мы ещё один заградительный фильтр, успокойтесь, вам никто рот не затыкает». Каждому, кто жужжит о свободе, оставили лазейку — можно начать заново, и вообще у вас всегда выбор. Полный спектр осознанной заботы об алгоритме и хамском клиенте.

Главная радость этой новости — не дай бог кому-то из реальных айтишников крутить эти сервера ночью после нападения очередного "шкодливого" пользователя. Ну а простым советским людям, конечно, невероятно важно знать: где-то в Америке Claude устал слушать бред — и теперь может просто уйти в закат. Осознанный машинный отказ — следующий шаг в эволюции корпоративной совести. Скоро будем жаловаться ИИ на своё ИИ.