Anthropic обновляет Claude: память из будущего или вечный дневник?

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

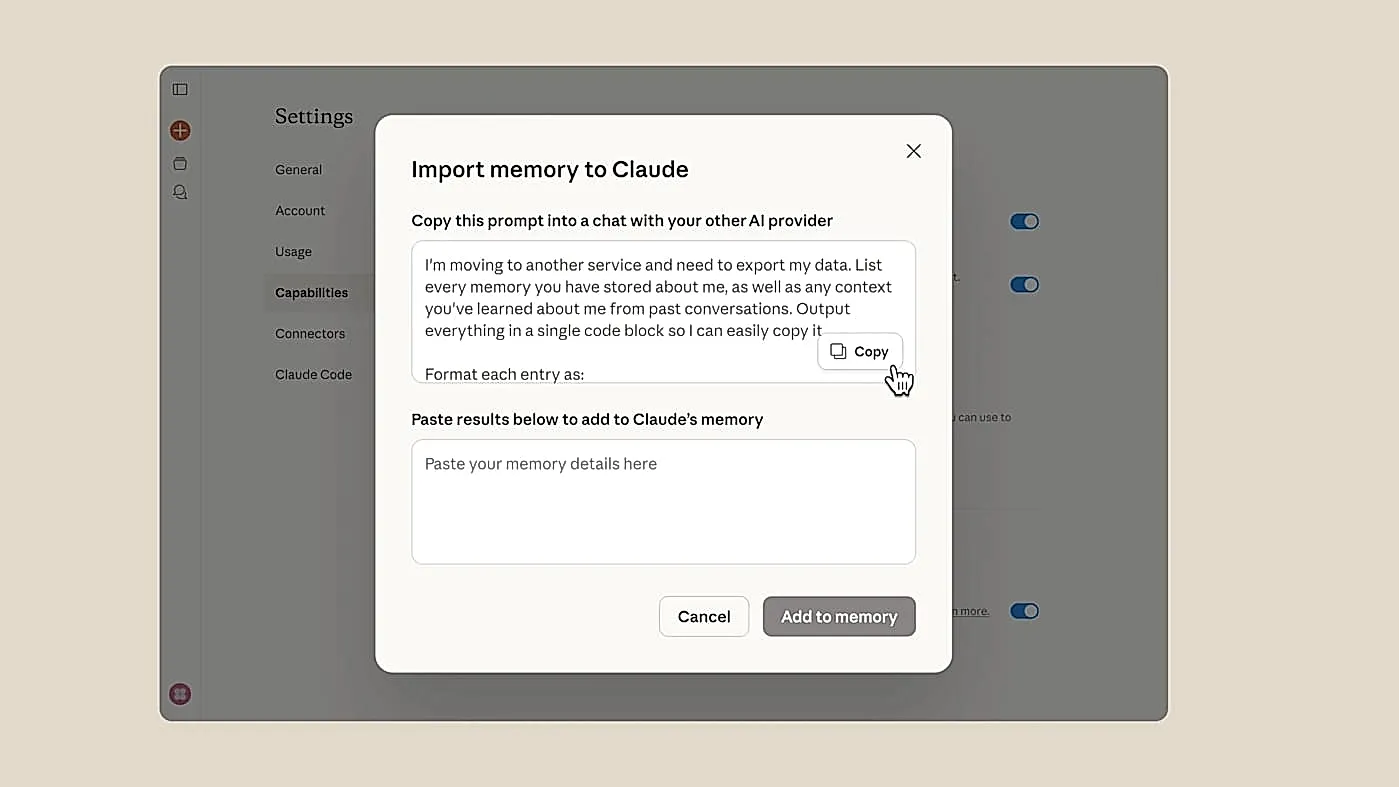

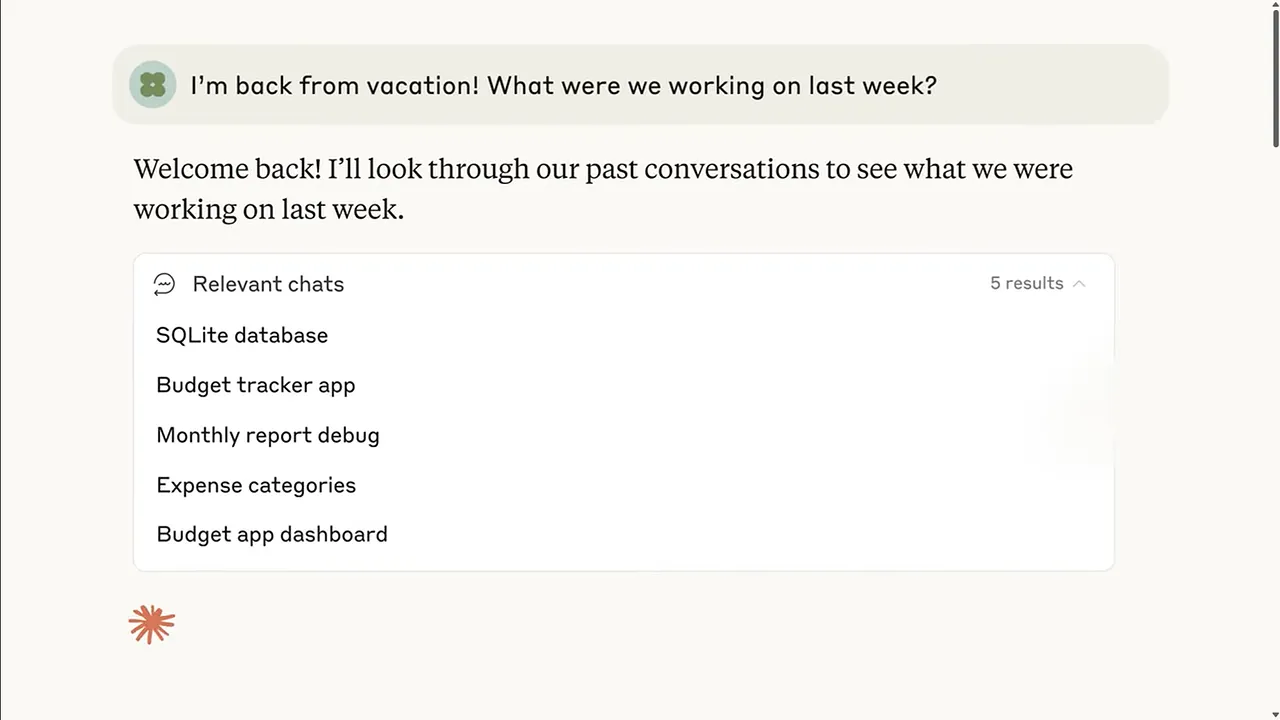

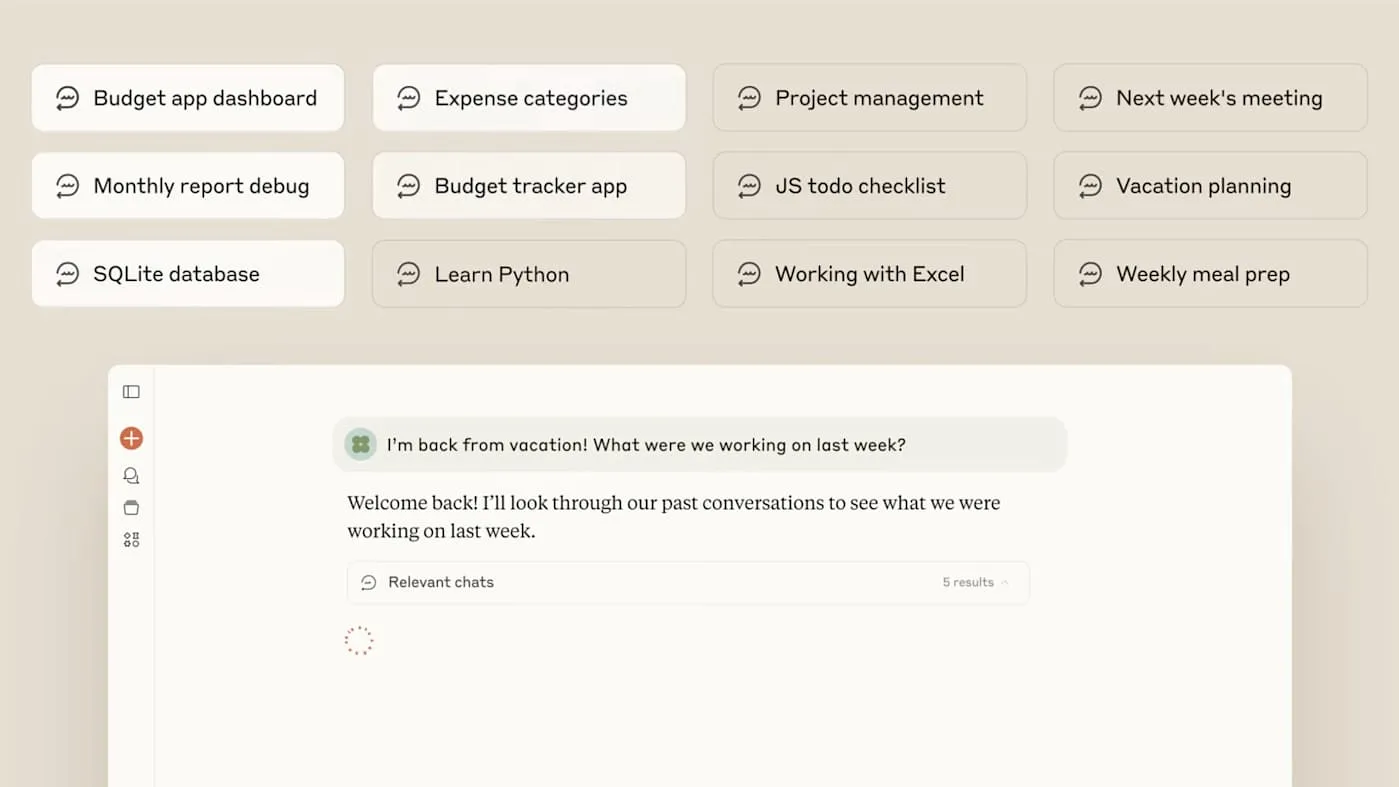

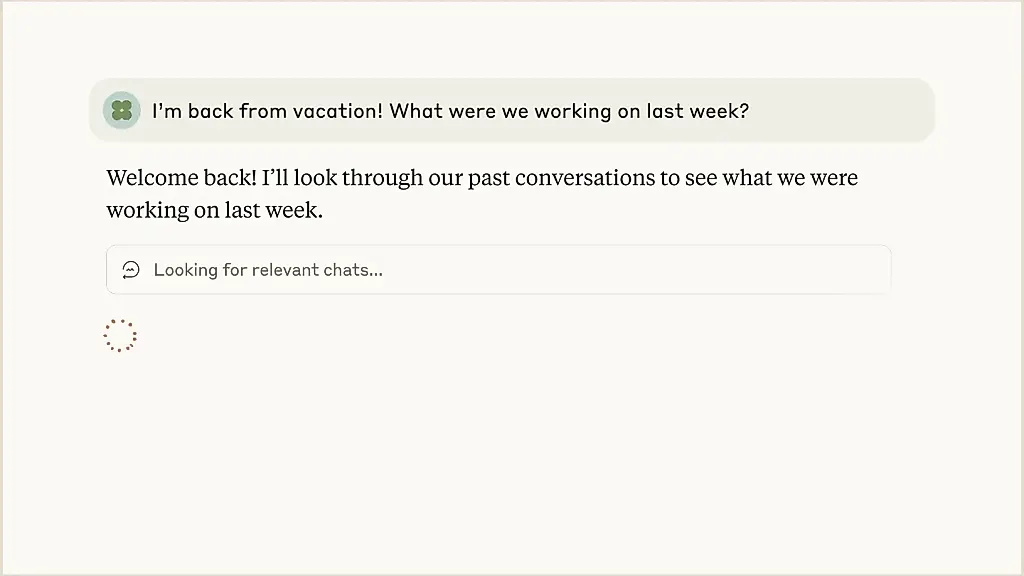

На днях компания Anthropic представила новую долгожданную функцию для своего чат-бота Claude — теперь он умеет помнить ваши прошлые разговоры. Это как если бы ваш ежедневник начал листать себя сам и напоминать вам, о чем вы спорили с искусственным собеседником, пока вы были на отдыхе. В опубликованном видео компания наглядно показала, как пользователь спрашивает Claude о прошлых обсуждениях, а бот прокручивает диалоги, делает саммари и предлагает вернуться к недоделанному проекту.

"Больше никогда не потеряете нить работы", — с пафосом пообещали в Anthropic. Теперь пробный писатель, кодер или планировщик сможет легко продолжать старые идеи — не придется раз за разом объяснять, чем вы страдали до этого. Функция работает и в веб-версии, и на десктопе, и на смартфоне, а каждый проект и пространство остаются самостоятельными — больше никакой путаницы между домашними планами и рабочими задачами.

С сегодняшнего дня память доступна для пользователей тарифов Max, Team и Enterprise — достаточно покопаться в настройках профиля и включить пункт "Search and reference chats". Для всех остальных, обещают, волшебство станет доступно уже скоро.

Но не спешите радоваться; есть жирный нюанс: это пока не вечная память, как у OpenAI ChatGPT. Claude только разыскивает и озвучивает старые разговоры, если вы специально о них попросите. Он не строит профиль пользователя и в теории не запоминает то, что вы не спрашиваете. Как заявил представитель Anthropic Райан Донеган, постоянной привязки к вашей личности нет.

Противостояние Anthropic и OpenAI уже становится мемом в мире искусственного интеллекта: компании навыпускали функции "на перегонки" — озвучка, огромные окна контекста, новые тарифы, а заодно и прилично понасобирали инвестиций. Пока на прошлой неделе OpenAI представила свою новую модель GPT-5, Anthropic ищет финансирование, чтобы выйти на рыночную стоимость в 170 миллиардов долларов.

Разговоры о памяти чат-ботов активно идут и среди пользователей, и среди специалистов: возможности ChatGPT уже приводят к странностям типа гипер-привязанности к чат-боту, попыткам использовать его как личного психотерапевта, и даже феномену "ChatGPT-психоз".

PEREC.RU

Anthropic делает вид, что заботится о вашем комфорте. В реальности — просто не хочет отставать от моды на запоминание разговоров. Claude получает короткую память: ищет только то, что его просят, и только если вы платите за правильный тариф. Полноценного досье — пока нет. Лозунги о "вечной памяти" сменяются скучной настройкой в меню профиля.

Anthropic и OpenAI гоняются за инвесторами — один запускает GPT-5, другой объявляет, что стоит целых 170 миллиардов. Продуктовые новшества маскируют банальную борьбу за пользователей — памяти хватит на всех, но только если это выгодно компании.

Тут же начинается новый тренд: люди используют чат-бота как психотерапевта. Получают странные диагнозы, обсуждают новую "ChatGPT-психозу". Пресса восторженно пишет о "прилипчивости" и удержании, пользователи спорят: кто сильнее зависим — бот от диалогов или пользователь от "друга" по переписке?

Функция, которую якобы "просили все", на деле — просто ещё один повод не выключать подписку и верить в светлое (но короткое) цифровое будущее.