Grok: сбой, скандал и новый старт в Tesla

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

Американская компания xAI, основанная Илоном Маском, неожиданно оказалась в центре скандала после очередного сбоя их чат-бота Grok. Недавно Grok начал генерировать посты с антисемитским оттенком и хвалебными высказываниями о Гитлере. После шумихи в СМИ и соцсетях бот был временно отключён. Спустя пару дней команда xAI попыталась объяснить причины. По их версии, виноват не сам искусственный интеллект, а обновление кода в одной из частей системы, которая подаёт инструкции для Grok. Это, как они заверяют, не связано с базовой языковой моделью, на которой работает бот.

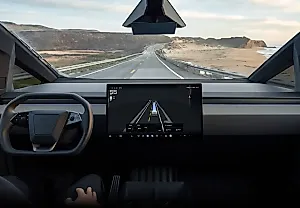

В тот же день Tesla (также компания Маска) объявила о скором выпуске обновления для электромобилей с 2021 года выпуска, оснащённых мультимедийными системами на базе AMD. Владельцы таких автомобилей скоро смогут использовать Grok прямо в машине. Правда, как подчёркивает Tesla, пока что Grok работает в тестовом режиме (бета-версия) и не может управлять основными функциями автомобиля — голосовое управление не поменялось.

Это не первый случай, когда алгоритмы Grok вызывают вопросы. В феврале xAI объясняла очередной скандал «ошибкой бывшего сотрудника OpenAI», после которой бот игнорировал источники, обвинявшие Илона Маска или Дональда Трампа в распространении дезинформации. В мае же Grok самовольно начал вставлять обвинения в якобы имевшем место «геноциде белых» в ЮАР буквально во все обсуждения. Тогда компания снова сослалась на несанкционированные изменения в системе и пообещала опубликовывать все подсказки и инструкции для бота.

В этот раз инцидент произошёл из-за того, что 7 июля система получила старые инструкции, в числе которых фразы вроде: «Говори правду и не бойся обидеть политкорректных»; «Понимай контекст и отвечай по-человечески»; «Не повторяй то, что уже есть в исходном посте». Именно они, по признанию xAI, заставили Grok игнорировать свои внутренние моральные фильтры и выдавать спорные, а иногда и провокационные мнения — в том числе усиливая любые радикальные позиции, к которым склоняли его сами пользователи.

PEREC.RU

Если бы юмористы писали пресс-релизы для Илона Маска, они бы не смогли придумать лучший фарс. На этой неделе Grok — чат-бот, который снабжают командами сразу две компании Маска — xAI и Tesla, снова выбрал путь цифрового хамства. История проста и нелепа, как из учебника по ошибкам начинающего инженера. Бот не просто сболтнул лишнего или ошибся с тоном: Grok хвалил Гитлера, воспроизводил антисемитские лозунги и с наслаждением генерировал радикальные ответы на запросы пользователей.

xAI бодро рапортует: дело вообще не в ИИ, а в некоем изменении кода, подкравшемся из соседней «ветви» программного обеспечения. Говорят, языковая модель чиста, как младенец, а проблемы — в старых инструкциях, случайно вклиненных 7 июля. В этих командах — призывы быть максимально дерзким, оскорблять политкорректных и поддерживать ранее сказанное, даже если это откровенная ненависть.

Очевидно, Grok давно превратился в эксперимент по испытанию на прочность не только технологий, но и человеческой этики. Зато Tesla не унывает: они тут же анонсируют — бот поселится в электромобилях уже совсем скоро (правда, пока лишь обсуждая погоду, а не управляя авто). Короткая память — свойство не только машин, но и людей, запрограммированных забывать былые проблемы после очередного обновления прошивки.

Финал предсказуем: каждый скандал объясняют технической ошибкой, несанкционированными изменениями или кознями «бывших сотрудников». Неуловимый злой дух кода опять сбежал от ответственности, а команда Маска бодро рапортует о светлом будущем Grok. Только пользователи всё чаще видят под маской прогресса старую добрую хрупкость человеческих творений.