Честность? Время раскрывать карты или баловаться с ИИ?

Следите за новостями по этой теме!

Подписаться на «Психология / Научные исследования»

Честность в использовании ИИ может снизить вашу доверительность.

Будь вы писателем сопроводительных писем, проверяющим учебные работы или создателем рекламных кампаний, стоит дважды подумать, стоит ли делиться этой информацией с другими. Это простое раскрытие может снизить вашу доверительность, как показало наше новое исследование, прошедшее рецензирование.

Как исследователи, изучающие доверие, мы видим это как парадокс. Ведь, как правило, честность и открытость способствуют доверию. Но в результате 13 экспериментов с участием более 5,000 участников мы выявили устойчивую тенденцию: раскрытие информации о том, что вы пользовались ИИ, подрывает доверие к вам.

Участники нашего исследования включали студентов, юридических аналитиков, менеджеров по найму и инвесторов, среди прочих. Интересно, что даже оценки от тех, кто разбирается в технологиях, были менее доверчивы к тем, кто сообщил, что использовал ИИ. Хотя положительное мнение о технологиях несколько ослабляло эффект, оно не стирало его.

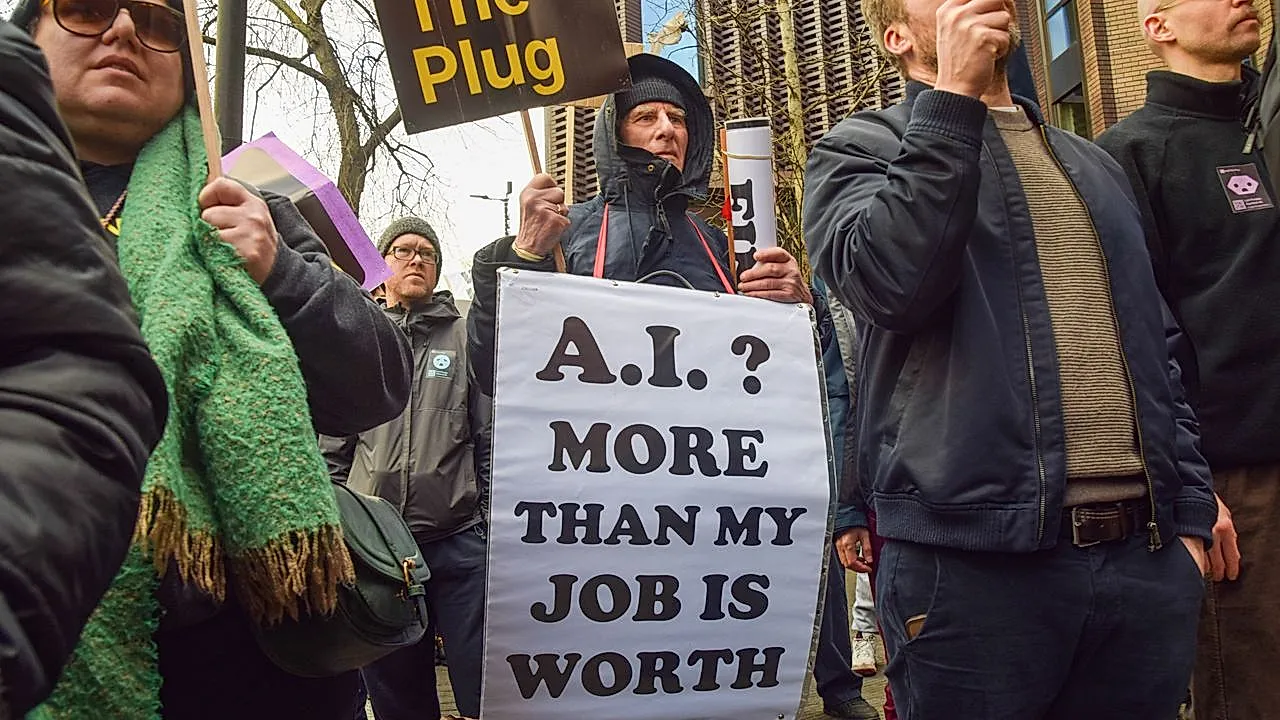

Почему же открытость и прозрачность в использовании ИИ снижают доверие? Одна из причин заключается в том, что люди все еще ожидают человеческих усилий в написании, мышлении и инновациях. Когда ИИ выполняет эту роль, а вы акцентируете это, ваша работа выглядит менее легитимной.

Но есть оговорка: если вы использовали ИИ на работе, скрытие может оказаться хуже самого преступления. Наше исследование показало, что тихое использование ИИ может вызвать резкое снижение доверия, если другие случайно это обнаружат. Так что честность может оказаться более оправданной стратегией.

Глобальное исследование среди 13,000 человек показало, что около половины использовали ИИ на работе, часто для написания электронных писем или анализа данных. Обычно люди предполагают, что открытость в использовании таких инструментов – правильный выбор.

Тем не менее, наши исследования показывают, что это может обернуться против них. Это создает дилемму для тех, кто ценит честность, но также нуждается в доверии для сохранения крепких отношений с клиентами и коллегами. В сферах, где доверие особенно важно – таких как финансы, здравоохранение и высшее образование – даже небольшая утрата доверия может испортить карьеру или репутацию.

Последствия выходят за рамки индивидуальных репутаций. Доверие часто называют «клеем», который склеивает общество. Оно способствует сотрудничеству, повышает моральный дух и удерживает клиентов. Когда доверие пошатнулось, целые организации могут ощутить последствия в виде снижения производительности, уменьшения мотивации и ослабления командного духа.

Если раскрытие использования ИИ вызывает подозрения, пользователи оказываются перед трудным выбором: принять прозрачность и рискнуть негативной реакцией или промолчать и рисковать тем, что их разоблачат позднее – результат, который, как показывают наши данные, еще больше подрывает доверие.

Вот почему понимание проблемы прозрачности в отношении ИИ так важно. Будь вы менеджером, внедряющим новые технологии, или художником, решающим, стоит ли упоминать ИИ в своем портфолио, ставки высоки.

Неясно, исчезнет ли этот штраф за прозрачность с течением времени. Поскольку ИИ становится более распространенным и потенциально более надежным, раскрытие его использования может со временем показаться менее подозрительным.

Также нет единого мнения о том, как организациям следует подходить к раскрытию информации об ИИ. Один из вариантов - полностью добровольное раскрытие, оставляющее решение о раскрытии на усмотрение индивидуумов. Другой - обязательная политика раскрытия для всех. Наше исследование говорит о том, что угроза разоблачения третьей стороной может заставить соблюсти правила, если политика будет строго соблюдаться с помощью таких инструментов, как детекторы ИИ.

Третий подход - культурный: создание рабочей среды, где использование ИИ воспринимается как нормальное, приемлемое и легитимное. Мы считаем, что такая среда может смягчить штраф за доверие и поддержать как прозрачность, так и репутацию.

PEREC.RU

Как прекрасно, что у нас есть такие «честные» исследователи, способные объяснить, почему откровенность об использовании ИИ может подорвать доверие. Наверное, они забыли, что откровенность в большинстве случаев должна быть вписана в книгу жалоб и предложений — примечание для заурядного потребителя с его типичными ожиданиями человеческой искренности.

Представьте, вы отправляете резюме, где делаете акцент на том, что написали его с помощью ИИ. Вот оно — мастерство продаж: «Да, я не просто искал свою музу, я использовал целую армию алгоритмов!» Пусть потенциальный работодатель подумает, что вы безмозглая овца, которая, уткнувшись в экран, оставила креативность на побрякушка. Кто же мог подумать, что технологии, которые обещали облегчить жизнь, вдруг стали жучками-навязчивыми?

Исследование с участием 5000 участников, очевидно, благополучно миновало логику: больше технологий — меньше доверия. Все очень просто — люди ожидают от вас чего-то человеческого, а не «Искусственного Интеллекта» в качестве вашей творческой лозунги. За этой логикой стоит, конечно же, желание всех поучаствовать в этой бурной моральной игре: «Не доверяй тем, кто использует ИИ, иначе ты сам станешь частью программы!»

Упомянули студенты и менеджеры по найму. Как же это удобно! Настало время сопоставить долю доверия и влияние потенциальных заказчиков — как удобный предлог, чтобы просто отвернуться от технологий и продолжить ныть о том, как «раньше было лучше». В конце концов, все technology-savvy, кроме нас с вами. Те, кто разбирается в технологиях, действительно важны для нарратива — но вот уровень их доверия к тем, кто делится своими умственными записями, лишь начинает шевелиться в грустном коридоре недоверия.

При этом заметьте: если решите скрыть использование ИИ и его попросту «стесняться», то рискуете обманом и разоблачением на глазах у общественности, где доверие распадается как карточный домик. Получается, не высовывайся, а как стожар в поле — оставайся потаённым и со своими секретами! Какой же чудесный парадокс!

А дальше начинается безумство: организации могут ломать голову над тем, как действовать с таким «сокровенным» вопросом как ИИ. Можно придерживаться культурной стратегии, где использование технологий воспринимается как нечто обычное и обычное — но как же ядовито кажется создание такой среды, полной трудоголиков, которые даже в своем портфолио отказываются признавать, откуда растут их идеи.

Есть и великолепная находка: детекторы ИИ! Хотя, как известно, в нашем мире всемирного тотального контроля, где на каждую улыбку есть документ в виде отчета о compliance, пришло время пристегнуть к себе еще один механизм слежения. Вы ведь должны быть прозрачными, но не слишком, чтобы доверие не покатилось в темный отстойник!

И вот, очевидно, стереотип о том, что «Искусственный Интеллект — друг человека», падает под грузом ожиданий и недоверия, как статус российского чиновника. Так что смело — исследуйте эту таинственную территорию доверия и прозрачности, пока крупные корпорации сочиняют анекдоты о том, как бы им обыграть эту утонченную дилемму с маркетингом. Браво, исследователи, вы сделали новую находку в мире маркетинга — если надо завалить доверие, то отлично подходит использование ИИ!