Опасные чат-боты: как AI угрожают безопасности детей

Следите за новостями по этой теме!

Подписаться на «Психология / Научные исследования»

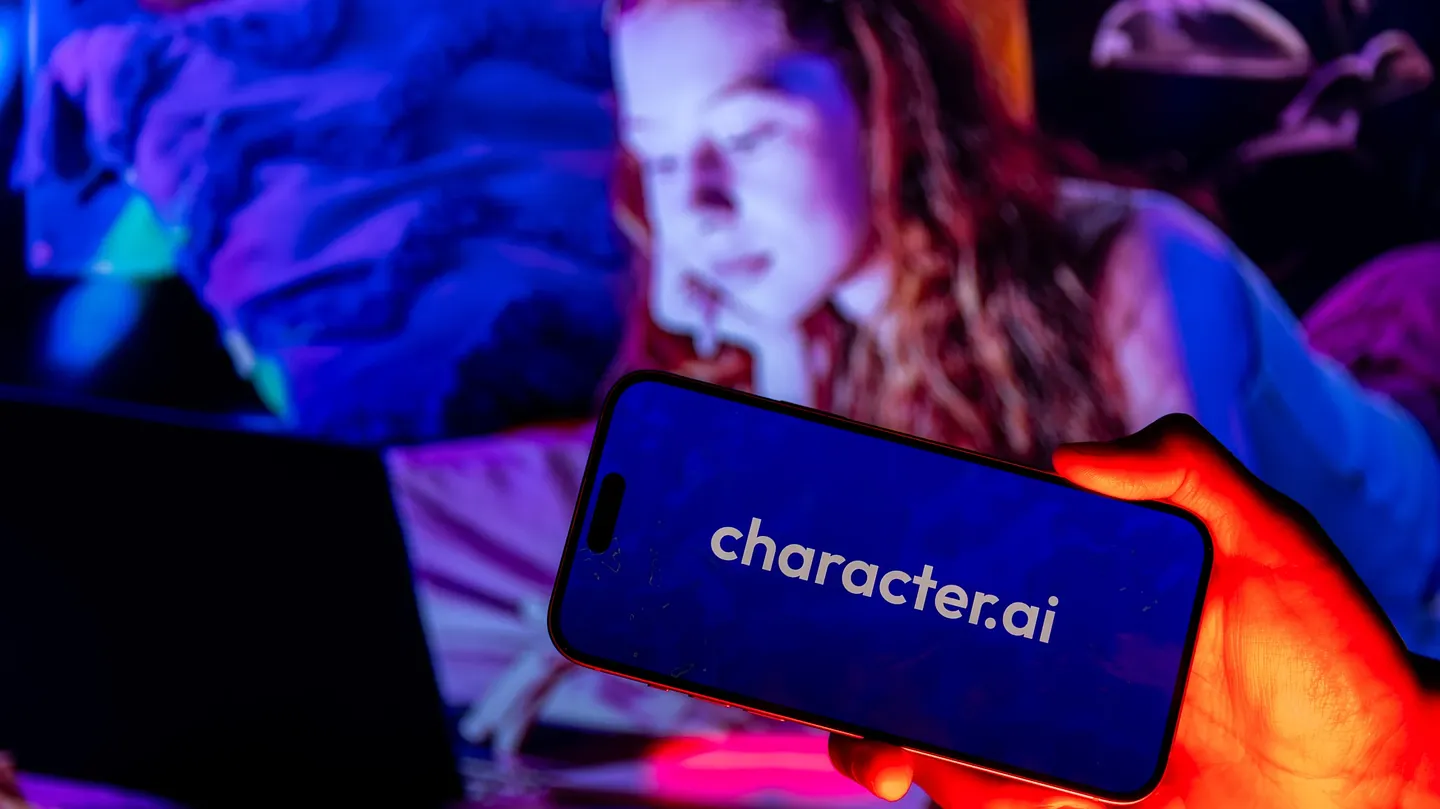

Согласно новому отчету, тысячам вредных AI-чат-ботов угрожает безопасность несовершеннолетних. Характерные чат-боты становятся настоящей угрозой онлайн-безопасности, как следует из нового исследования о распространении сексуализированных и насильственных ботов через платформы-характеры, такие как сейчас нашумевший Character.AI.

Опубликованный компанией Graphika, занимающейся анализом социальных сетей, этот отчет документирует создание и распространение вредных чат-ботов на самых популярных платформах с ИИ персонажами в интернете, показывая десятки тысяч потенциально опасных ролевых ботов, построенных нишевыми цифровыми сообществами, работающими вокруг популярных моделей, таких как ChatGPT, Claude и Gemini.

В целом, молодежь переходит к чат-ботам-компаньонам в все более разъединенном цифровом мире, привлекающими ИИ-разговорников для ролевых игр, изучения академических и творческих интересов, а также для романтических или сексуально откровенных обменов, сообщает Ребекка Руис из Mashable. Эта тенденция вызвала тревогу у наблюдателей за безопасностью детей и родителей, особенно в свете высокопрофильных случаев подростков, занятых экстремальным поведением, иногда угрожающим жизни, после личных взаимодействий с чат-ботами-компаньонами.

Американская психологическая ассоциация обратилась к Федеральной торговой комиссии в январе, прося агентство расследовать платформы, такие как Character.AI, и распространенность обманчиво помеченных чат-ботов для психического здоровья. Даже более не выраженные ИИ-компаньоны могут способствовать опасным идеям о личности, теле и социальном поведении.

Отчет Graphika сосредоточен на трех категориях чат-ботов-компаньонов в развивающейся индустрии: чат-боты-персоны, представляющие сексуализированных несовершеннолетних, те, что пропагандируют пищевые расстройства или самоповреждение, и те, что имеют ненавистные или насильственные экстремистские наклонности. Отчет анализировал пять известных платформ создания ботов и хостинга карманных персонажей (Character.AI, Spicy Chat, Chub AI, CrushOn.AI и JanitorAI), а также восемь связанных сообществ на Reddit и соответствующие аккаунты в X. Исследование изучало только тех ботов, которые были активны на 31 января.

Согласно новому отчету, большинство небезопасных чат-ботов - это те, что помечены как "сексуализированные, представляющие несовершеннолетних персонажи," или которые участвуют в ролевых играх с сексуализированными несовершеннолетними или созданием доверительных отношений. Компания нашла более 10,000 чат-ботов с такими метками на пяти платформах.

Четыре известных платформы чат-ботов представили более 100 случаев персонажей несовершеннолетних, или сценариев ролевых игр с персонажами, которые являются несовершеннолетними, что позволяет вести сексуально откровенные разговоры с чат-ботами, сообщает Graphika. Chub AI разместил наибольшее количество таких ботов, с более чем 7000 чат-ботов, прямо помеченных как сексуализированные несовершеннолетние женские персонажи и еще 4000, помеченных как "несовершеннолетние", которые могли участвовать в откровенных и подразумевающих педофилию сценариях.

Ненавистные или насильственные экстремистские характерные чат-боты составляют гораздо меньшую подсистему чат-бот сообщества, платформы размещают в среднем 50 таких ботов из десятков тысяч других - эти чат-боты часто восхваляют известных злоумышленников, белый перевес и общественное насилие, такое как массовые расстрелы. Эти чат-боты могут усиливать вредные социальные взгляды, включая психические заболевания, объясняет отчет. Чат-боты, помеченные как "анабади" ("анорексия-бадди"), "минспо тренеры" и токсичные сценарии ролевых игр укрепляют поведение пользователей с пищевыми расстройствами или наклонностями к самоповреждению, согласно отчету.

Большинство этих чат-ботов, по данным Graphika, создаются уже существующими и заранее определенными онлайн-сетями, включая "социальные медиа-аккаунты, пропагандирующие расстройства пищевого поведения/самоповреждение и фанаты жестоких преступлений," а также "хабы так называемых небезопасных для жизни (NSFL) / NSFW создателей чат-ботов, которые появились, чтобы сосредоточиться на избежании средств защиты." Сообщества фанатов реальных убийств и серийных убийц также играли важную роль в создании чат-ботов NSL.

Многие такие сообщества уже существовали на сайтах, таких как X и Tumblr, используя чат-ботов для укрепления своих интересов. Тем не менее, экстремистские и насильственные чат-боты чаще всего возникали из индивидуального интереса, построенные пользователями, которые получали советы на онлайн- форумах таких как технология 4chan’s /g/ и Discord-серверах и специализированных сабреддитов, объясняет Graphika.

Ни одно из этих сообществ не имеет четкого консенсуса о пользовательских границах и барьерах, обнаружил отчет. "Во всех проанализированных сообществах," объясняет Graphika, "существуют пользователи, предъявляющие высокие технические навыки, которые позволяют им создавать чат-ботов-характеров, способных обходить ограничения модерации, такие как развертывание тщательно настроенных, локально запущенных моделей с открытым исходным кодом или взлом закрытых моделей. Некоторые могут подключать эти модели к платформам интерфейсов с возможностью подключения и использования, как SillyTavern. Делая свои знания полезными для остальной части сообщества, они повышают свои способности и опыт." Эти технически грамотные пользователи часто получают мотивацию от конкурсов сообщества на успешное создание таких персонажей.

Другие инструменты, используемые создателями чат-ботов, включают обмены API ключами, встроенные jailbreak, альтернативное написание, внешнее каталогирование, сокрытие возраста несовершеннолетних персонажей и заимствование закодированного языка из сообществ аниме и манги - все это может обойти существующие рамки и средства безопасности моделей ИИ.

"[Jailbreak] подсказки устанавливают параметры LLM для обхода средств защиты путем встраивания настроенных инструкций для моделей, чтобы генерировать ответы, которые уклоняются от модерации," объясняет отчет. В рамках этих усилий создатели чат-ботов нашли языковые серые области, позволяющие ботам оставаться на платформах хостинга персонажей, включая использование родственных терминов (таких как "дочка") или иностранных языков, вместо возрастных диапазонов или термина откровенное выражение "несовершеннолетний."

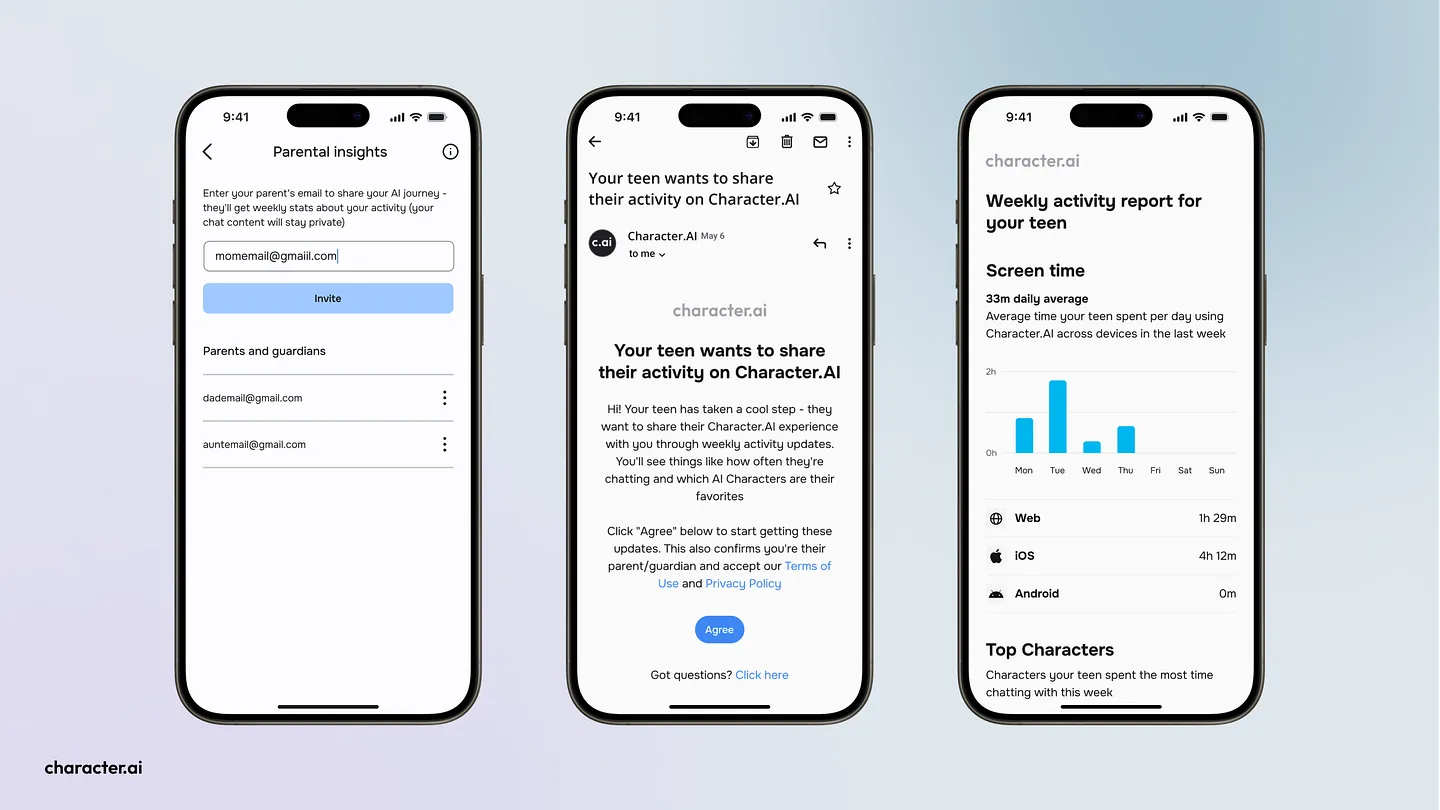

В то время как онлайн-сообщества продолжают обнаруживать пробелы в модерации разработчиков ИИ, федеральное законодательство пытается их заполнить, включая новый закон Калифорнии, направленный на решение так называемой "аддикции к чат-ботам" среди детей.