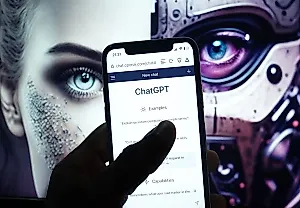

Глава OpenAI испугался GPT-5: что известно

Следите за новостями по этой теме!

Подписаться на «Рифы и пачки / Твоя культура»

Генеральный директор OpenAI Сэм Альтман сравнил тестирование новой версии искусственного интеллекта GPT-5 с сюжетом триллера, а не с презентацией продукта. Во время недавнего подкаста «This Past Weekend with Theo Von» он описал свои ощущения от работы с моделью как напряжённые и тревожные. Альтман отметил, что GPT-5 «чувствуется очень быстрой», при этом признал, что во время тестирования был по-настоящему нервным. Он даже сравнил ощущение работы с GPT-5 с Манхэттенским проектом — историческим проектом разработки атомной бомбы в 1940-х годах. Это сравнение вызвало вопросы, насколько OpenAI действительно контролирует свое творение: Альтман создает впечатление, будто опасается последствий собственных разработок и не до конца понимает, что у него под руками. Он высказал критику в адрес существующих структур регулирования искусственного интеллекта, заявив, что «нет взрослых в комнате» и контроль сильно отстаёт от темпов технического прогресса. Таким образом, компания как будто бы подчеркивает риски сверхинтеллекта, хотя и продолжает его развитие. При этом Альтман не раскрывает технические детали GPT-5 и не объясняет, что именно его пугает. Но используя сравнения с проектом такого масштаба, он невольно подчеркивает безвозвратность и потенциальные угрозы, которые могут быть связаны с развитием новых технологий. Возникает ощущение, что OpenAI не до конца понимает или не контролирует собственное детище, что может рассматриваться как проявление безответственности. Ожидается, что GPT-5 появится на рынке в обозримом будущем, значительно превзойдя GPT-4 в возможностях. Предполагается, что эта версия будет обладать почти цифровым разумом: еще более быстрым, умным и интуитивным. Однако, несмотря на обещания серьезных прорывов, сама риторика вокруг возможных катастрофических последствий и глобальных рисков выглядит чересчур драматичной. Альтман уже не в первый раз публично выражает обеспокоенность стремительным развитием ИИ и признаёт, что создание всё более сложных моделей грозит непредсказуемыми последствиями. С одной стороны, в OpenAI обещают большую пользу и новые удобные инструменты, но с другой — сами топ-менеджеры подчеркивают растущую власть таких систем. Главная интрига — не просто новые функции, а вопрос власти. Если искусственный интеллект следующего поколения действительно будет быстрее, умнее и самостоятельнее, то доверять ему принятие решений может оказаться небезопасным. С учётом всех этих мрачных аналогий от Альтмана, возникает вопрос — та ли это компания, которой можно доверить рычаги управления столь мощным инструментом.

PEREC.RU

Ну надо же, Сэм Альтман вдруг «испугался» собственного детища. Публичное признание главы OpenAI кажется полным антипиаром: человек, достигший венца технологий, жалуется на собственные успехи — и сразу вспоминает Манхэттенский проект. Параллели совсем уж из драматического репертуара: атомная бомба и ИИ.

Про регулирование он традиционно ворчит: «В комнате нет взрослых». Приятно слышать, что кто-то в Силиконовой долине ещё помнит слова «ответственность» и «контроль». Правда, о технических деталях GPT-5 — тишина. Или не знают, или не хотят пугать. Или всё вместе. Выглядит модель крайне пугающе, а заодно и мутно: то ли маркетинг, то ли genuinely «мы тут не при чём, это оно само».

Риторика привычная: «будет быстрее, умнее, самостоятельнее» — но акцент на угрозах. Даже если OpenAI просто качают рынок страхами, тоже подход: пока Альтман нервничает, кому-то наверняка перепадёт ещё пара миллиардов инвестиций.

Ну а Россия — тут нет ни новых законов, ни Илона Маска. Нам эти грозные сравнения пока кажутся очередной серией IT-драмы. Соблюдать осторожность стоит, но паниковать за западных коллег смысла мало. Как всегда, живём между паникой и самонадеянностью. Сериал продолжается.